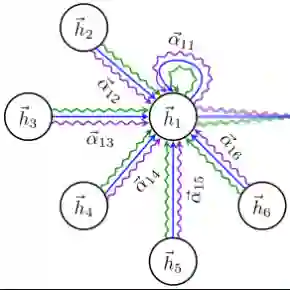

注意力机制(AttentionMechanism)最初在机器翻译模型中被引入并使用,现在已经成 为自然语 言 处 理 (NaturalLanguageProcessing,NLP)、计 算 机 视 觉 (ComputerVision, CV)、语音识别(SpeechRecognition,SR)领域中神经网络模型的重要组成部分。近年来,有 些研究人员将注意力机制应用到图神经网络模型中,取得了很好的效果。本章聚焦于图注意力网络模型,依次介绍注意力机制的概念、图注意力网络的分类,以及四个典型的注意力模型: 图注意力 网 络 模 型(GraphAttentionNetworks,GAT)、异 质 图 注 意 力 网 络(Heterogeneous GraphAttentionNetworks,HAN)、门控注意力网络(GatedAttentionNetworks,GaAN)和层 次图注意力网络(HierarchicalGraphAttentionNetworks,HGAT)

成为VIP会员查看完整内容