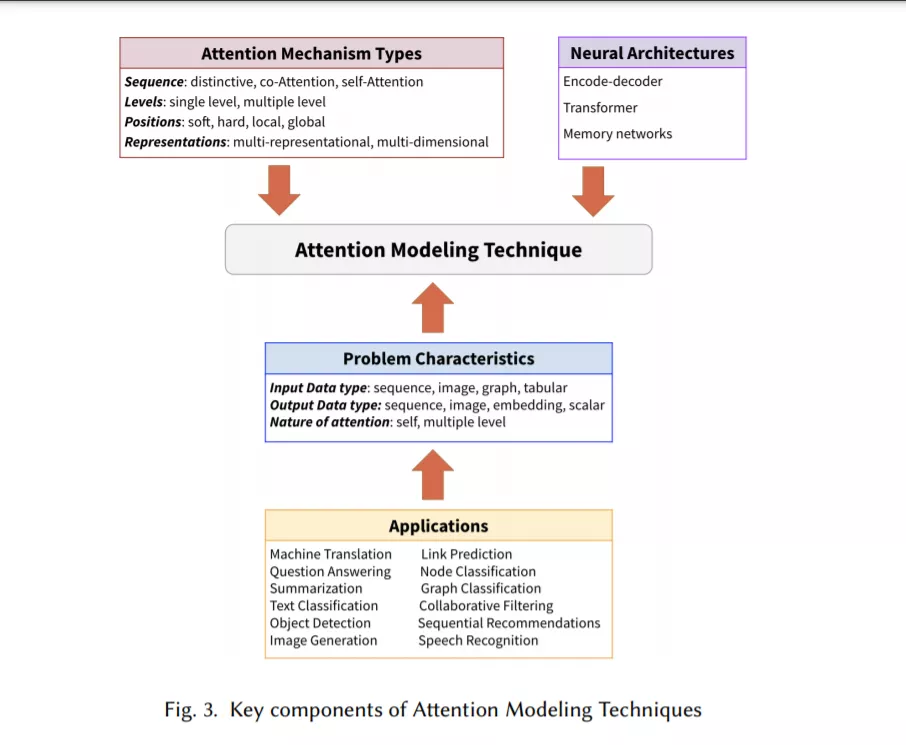

注意力模型已经成为神经网络中的一个重要概念,在不同的应用领域得到了广泛的研究。本综述提供了一个关于注意力建模的结构化的和全面的概述。特别地,我们提出了一种分类法,将现有的注意力技术分组到一致类别中。我们回顾了显著的注意力融入的神经结构,并讨论了建模注意力已显示出重大影响的应用。最后,我们还描述了如何使用注意力来提高神经网络的可解释性。我们希望这个调查能提供一个关于注意力模型的简明介绍,并在为其应用开发方法时指导从业者。

注意力模型(AM)首先被引入到机器翻译中[Bahdanau et al. 2015],现在已经成为神经网络文献中的一个主导概念。在人工智能(AI)领域,注意力作为神经架构的重要组成部分,在自然语言处理(Galassi et al. 2020)、语音(Cho et al. 2015)和计算机视觉(Wang and Tax 2016)等大量应用中非常受欢迎。

注意力背后的直觉可以用人类生物系统来最好地解释。例如,我们的视觉处理系统倾向于选择性地关注图像的某些部分,而忽略其他可以帮助感知的无关信息[Xu et al. 2015]。同样地,在涉及语言、言语或视觉的问题中,输入的某些部分比其他部分更重要。例如,在翻译和总结任务中,只有输入序列中的特定单词可能与预测下一个单词相关。同样,在图像字幕问题中,输入图像的某些区域可能与生成标题中的下一个单词更相关。AM通过允许模型动态地只关注帮助有效执行手头任务的输入的某些部分来合并相关性的概念。使用AM对Yelp评论进行情感分类的例子[Yang et al. 2016]如图1所示。在这个例子中,AM了解到在五个句子中,第一个和第三个句子更相关。此外,这些句子中的delicious和amazing这两个词更有意义,更能决定评论的情绪。

目录内容:

- 注意力基础知识

- 注意力模型

- 注意力分类法

- 注意力网络架构

- 应用

- 注意力可解释