近日,北邮GAMMA Lab发布的图基础模型观点性文章被CCF-A类期刊TPAMI接收。该论文首次提出了图基础模型的概念,对其进行了深入讨论,并展望了其未来发展方向。

![]() 标题:Graph Foundation Models: Concepts, Opportunities and Challenges 作者:Jiawei Liu*, Cheng Yang*, Zhiyuan Lu, Junze Chen, Yibo Li, Mengmei Zhang, Ting Bai, Yuan Fang, Lichao Sun, Philip S. Yu, and Chuan Shi 链接:https://ieeexplore.ieee.org/document/10915556 摘要:基础模型已成为多种人工智能应用中的关键组件,并在自然语言处理及其它多个领域展示了显著的成功。同时,图机器学习领域正在经历从浅层方法到更为复杂的深度学习方法的范式转变。基础模型在泛化和适应能力方面的表现激励了图机器学习的研究者讨论开发新图学习范式的可能性。这种新范式设想模型能够在大量的图数据上进行预训练,并能够适应各种图任务。尽管对此兴趣日益增长,但在这一新兴领域中,明显缺乏明确的定义和系统的分析。为此,本文介绍了图基础模型(Graph Foundation Models, GFMs)的概念,并对其关键特性和底层技术进行了详尽的解释。我们根据现有工作对图神经网络和大型语言模型的依赖程度,将其分类为三个不同的类别。除了对GFMs当前状态提供一个全面的回顾之外,本文还展望了在这个快速发展的领域中未来研究的潜在方向。 图1展示了深度图学习与图基础模型之间的区别。二者的区别在于:深度图学习通过对特定数据集进行端到端的训练来解决特定任务。相比之下,图基础模型(GFMs)是在广泛的图数据上进行预训练的,并能够适应各种下游图任务,预期能够展示出涌现和同质化的能力。

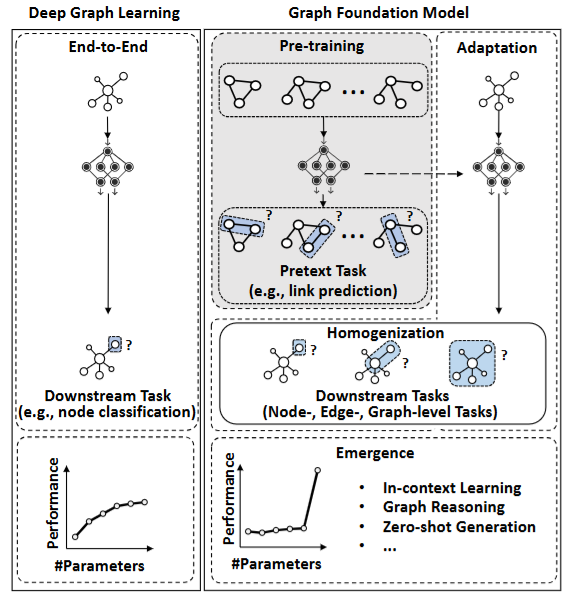

标题:Graph Foundation Models: Concepts, Opportunities and Challenges 作者:Jiawei Liu*, Cheng Yang*, Zhiyuan Lu, Junze Chen, Yibo Li, Mengmei Zhang, Ting Bai, Yuan Fang, Lichao Sun, Philip S. Yu, and Chuan Shi 链接:https://ieeexplore.ieee.org/document/10915556 摘要:基础模型已成为多种人工智能应用中的关键组件,并在自然语言处理及其它多个领域展示了显著的成功。同时,图机器学习领域正在经历从浅层方法到更为复杂的深度学习方法的范式转变。基础模型在泛化和适应能力方面的表现激励了图机器学习的研究者讨论开发新图学习范式的可能性。这种新范式设想模型能够在大量的图数据上进行预训练,并能够适应各种图任务。尽管对此兴趣日益增长,但在这一新兴领域中,明显缺乏明确的定义和系统的分析。为此,本文介绍了图基础模型(Graph Foundation Models, GFMs)的概念,并对其关键特性和底层技术进行了详尽的解释。我们根据现有工作对图神经网络和大型语言模型的依赖程度,将其分类为三个不同的类别。除了对GFMs当前状态提供一个全面的回顾之外,本文还展望了在这个快速发展的领域中未来研究的潜在方向。 图1展示了深度图学习与图基础模型之间的区别。二者的区别在于:深度图学习通过对特定数据集进行端到端的训练来解决特定任务。相比之下,图基础模型(GFMs)是在广泛的图数据上进行预训练的,并能够适应各种下游图任务,预期能够展示出涌现和同质化的能力。![]() 图1 深度图学习与图基础模型之间的区别图2展示了语言基础模型和图基础模型的相似性和差异性,并将差异分为内部差异和外部差异。

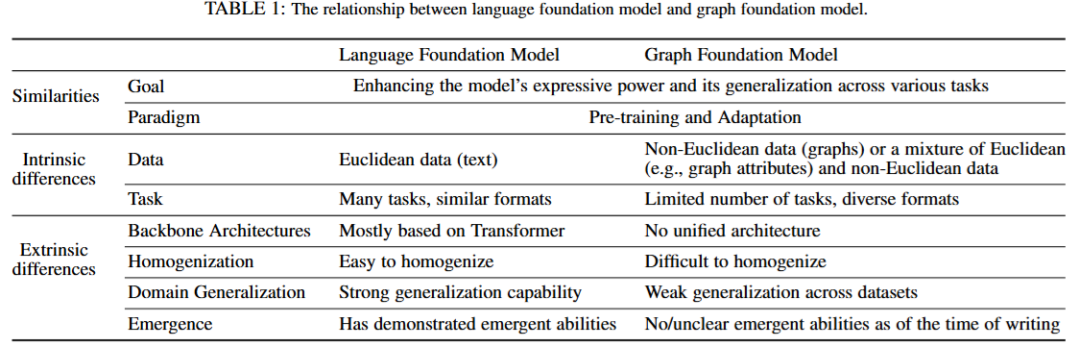

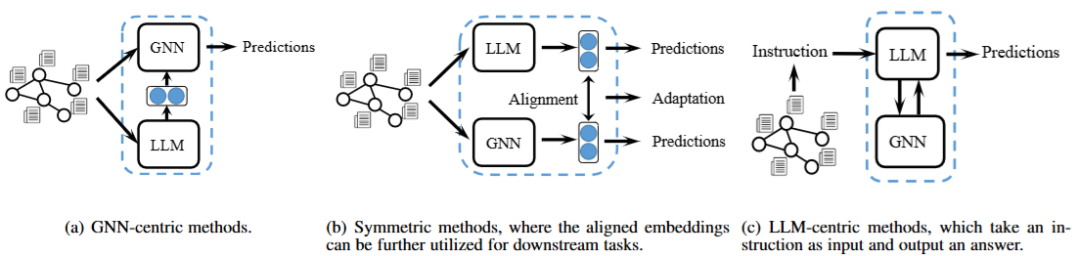

图1 深度图学习与图基础模型之间的区别图2展示了语言基础模型和图基础模型的相似性和差异性,并将差异分为内部差异和外部差异。![]() 图2 语言基础模型和图基础模型的相似性和差异性图3到图5展示了三种图基础模型范式:基于GNN的方法、基于LLM的方法和基于GNN+LLM的方法。

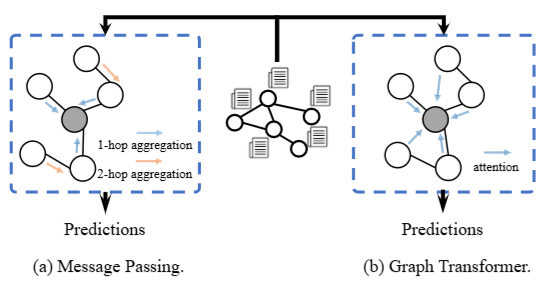

图2 语言基础模型和图基础模型的相似性和差异性图3到图5展示了三种图基础模型范式:基于GNN的方法、基于LLM的方法和基于GNN+LLM的方法。![]() 图3 基于GNN的方法

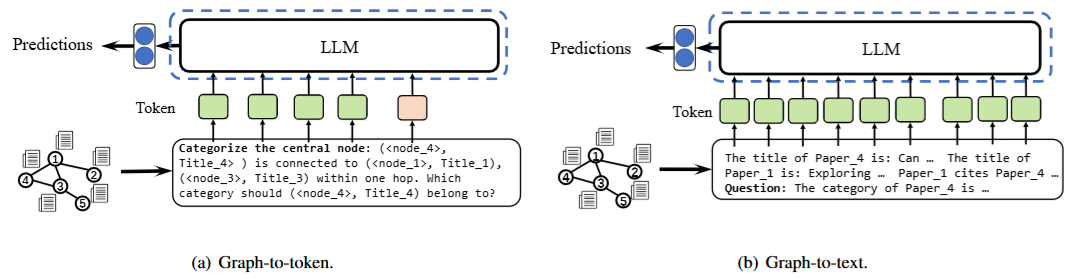

图3 基于GNN的方法![]() 图4 基于LLM的方法

图4 基于LLM的方法![]()

图5 基于GNN+LLM的方法相比于之前在arXiv发布的版本(题目:Towards Graph Foundation Models: A Survey and Beyond),TPAMI的正式版本(称为V4版本)有以下新亮点:

- 标题修改为“Graph Foundation Models: Concepts, Opportunities and Challenges”。

- 在2.1.1节,进一步解释了非欧式数据的定义、特性和挑战。

- 在第4到6章,新增了十余篇最新顶会上有关GFM的论文,他们来自KDD2024, NeurIPS2024, EMNLP2024, WWW2024, SIGIR2024, KDD2025和AAAI2025。

- 在4.4、5.4和6.4节,我们讨论了有关时序图、超图和异质图的研究。

- 在第7章,我们增加了有关GFM处理跨域数据的方法讨论。

- 在7.3.2节,我们增加了有关处理噪声、数据不平衡、数据不完整、多模态特征等问题作为未来方向。

- 我们对论文的引用进行了全面更新,arXiv上的论文比例已从20/222(9.0%)降至8/230(3.5%),确保了引用的质量和时效性。

附件:更新日志

版本时间主要更新内容V12023年10月18日初始版本,引用相关论文152篇。V22023年12月2日引用相关论文增至183篇。对图表和文字质量进行了全方位的提升,修正了部分细节错误。V32024年7月1日引用相关论文增至222篇,收录了近半年顶会发表的相关论文。结合最新观点对未来研究方向进行补充,对参考文献格式进行了全方位的更新。V42025年3月10日引用相关论文增至230篇,收录了近半年顶会发表的相关论文。结合最新观点对时序图、超图、异质图、跨域数据、处理噪声、数据不平衡、数据不完整、多模态特征等问题进行讨论。