【泡泡图灵智库】非监督深度学习单应性:一种快速稳健的单应性估计模型

泡泡图灵智库,带你精读机器人顶级会议文章

标题:Unsupervised Deep Homoraphy: A Fast and Robust Homography Estimation Model

作者:Ty Nguyen∗, Steven W. Chen∗, Shreyas S. Shivakumar, Camillo J. Taylor, Vijay Kumar

来源:IEEE Robotics and Automation Letters paper

播音员:四姑娘

编译:尹双双

审核:杨健博

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——非监督深度学习单应性:一种快速稳健的单应性估计模型,该文章发表于2018 IEEE International Conference on Robotics and Automation (ICRA)。

多重航空影像的单应性估计可以为自动探索和监控获取相对位姿估计,用于机器人系统的单应性估计算法必须是快速和稳健的。本文提出一种非监督学习算法,通过训练一个深度卷积神经网络来估计平面单应性。与传统的基于特征、直接比较,我们的实验结果表明非监督算法可以针对光照变化实现相同或更好的准确度和稳健性。另外与监督深度学习算法相比,本文方法有更优越的适应性和效果。本文影像数据集和TensorFlow实现已公开:https//github.com/tynguyen/unsupervisedDeepHomographyRAL2018

介绍

单应性是指一个平面在两张影像之间的变换关系,在机器人和计算机视觉应用中起着重要作用,像影像拼接、单目SLAM、3D相机位姿重建和虚拟漫游等。例如,随意一个移动相机在很远的距离拍摄场景就可以利用单应性,UAV影像就属于这种情况。但是要在航空的多机器设置下实现好效果,要求估计算法可靠和快速。

本文建立一个非监督,端对端,深度学习算法来估计单应性。

主要贡献有:

1、融合了深度学习、传统的直接法和基于特征方法的优点于一体。

2 、最下化像素级强度误差度量,不用像先前传统的和监督的方法一样需要地面真实数据。

3 、模型适应并且易学习不同场景集的特征,不需要手动提取特征或监督方法那样耗时地标识。

4、框架具有高度的并行性,从而推断快,适用于像UAV影像拼接等真实世界机器人任务。

算法流程

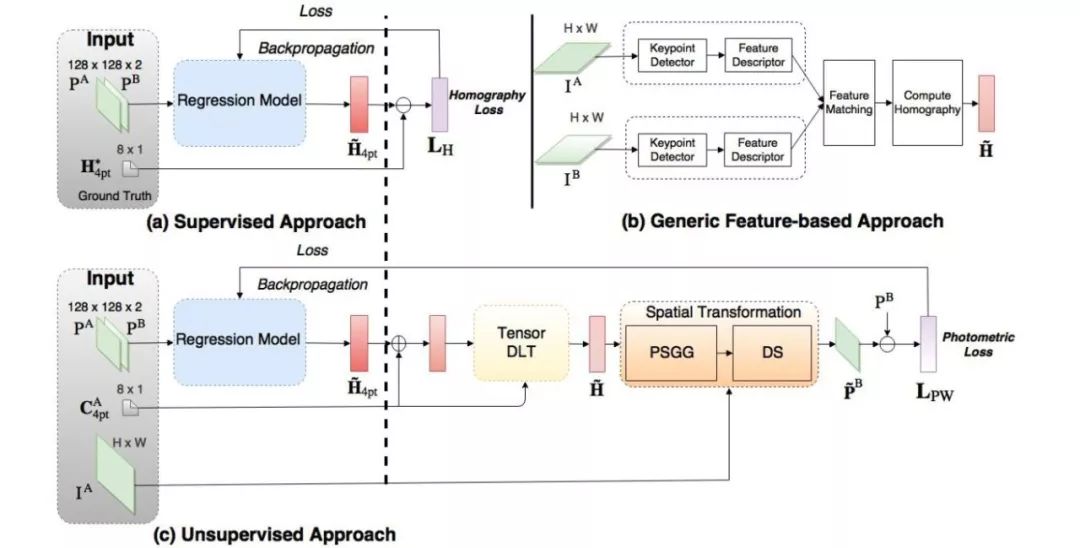

图1 单应性估计算法概览;(a)标准的监督深度学习方法;(b)基于特征的方法;(c)本文监督方法;DLT:直接线性变换;PSGG:参数化采样网格生成器;DS:差分采样。

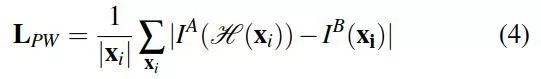

非监督深度学习单应性模型:定义一种与直接法类似的损失函数来估算。有一个影像对IA(x)和IB(x),以及用齐次坐标表示的离散像素坐标{xi=(xi,yi,1)},让网络输出4点单应参数化矩阵,最小化平均L1像素级光度损失:

模型输入包含三个部分:第一部分是一个2通道的影像,大小为128x128x2,从IA和IB裁剪的PA和PB影像块的堆栈。第二部分是影像IA的四个角点,影像IA也是输入的一部分。

张量的直接线性变换:提出一个张量直接线性变换(Tensor DLT)层来计算一个差分变换。有了4个相关点,我们可以建立一个等式系统来求解单应矩阵。

利用伪逆可以求解出H。这个操作很简单且关于坐标xi和xi'可微。另外,为SVD计算梯度更容易。

空间变换层:将估计的单应举证应用到影像IA上的像素坐标来得到变换的坐标H(xi),进一步用来计算方程(4)的光度损失函数,然后训练我们的神经卷积网络。此层采用一个逆变换来避免在变换后的影像上产生空洞,包含3个步骤:

正则化估计的单应矩阵的逆

参数化采样网格生成器

第二步的PSGG构建了一个和影像IB同样大小的格网G={Gi},每个格网单元Gi=(ui',vi')和第二张影像IB上的像素相关。将单应矩阵的逆用在这些格网坐标上来得到第一张影像IA上像素的格网。

差分采样,在采样点Hinv(Gi)的基础上得到一个采样的变化后影像V,大小为H'*W',C个通道,则V(xi)=IA(H(xi))。应用在网格Hinv(Gi)上的采样核k(.)和结果影像V定义如下:

利用双线性插值的方法将方程(10)化成下式:

为了得到损失函数的后向传播,用于双线性插值的I和G梯度定义如下:

主要结果

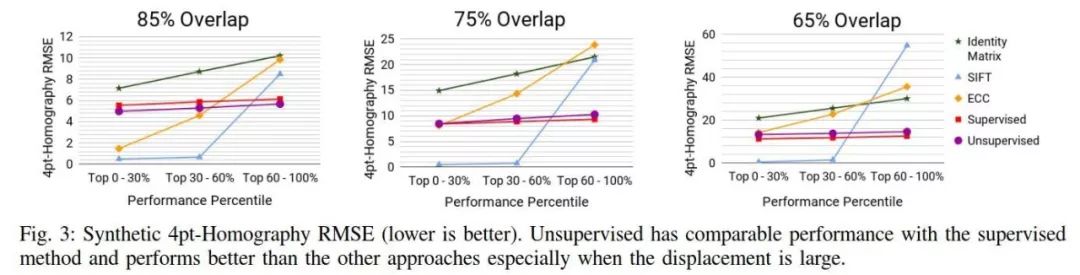

我们的算法的预期用例是为空中多机器人系统估计单应性,如图像拼接和避免碰撞。所以展示了对比SIFT,ORB,ECC和监督深度学习方法,我们非监督算法的准确度,推断速度和对于光照变化的稳健性。

合成数据结果

图2 合成的4点-单应RMSE(越小越好)。非监督和监督方法有着相近的实验效果,但是比其他方法好,尤其在重叠度小的大位移时。

图3 速度和性能的权衡,左下角是更好的。后缀GPU和CPU表示计算资源。所有基于特征的方法都是用CPU算的,在GPU上运行的无监督网络优于其他所有方法,具有最高的吞吐量和最佳性能。

2.航空数据结果

图4 在空中数据集上估计方法的定性可视化。左:困难情况,右:中等情况。当位移小时ECC效果比SIFT好,但在位移大时就差了,而非监督网络总是比它们好。监督网络被忽略是因为空间有限和在本数据集上效果差。

图5 在航空影像上的4点-单应性RMSE(越小越好)。非监督的方法明显比其他方法都好。

Abstract

Homography estimation between multiple aerial

images can provide relative pose estimation for collaborative autonomous exploration and monitoring. The usage on a robotic system requires a fast and robust homography estimation algorithm. In this study, we propose an unsupervised learning algorithm that trains a Deep Convolutional Neural Network to estimate planar homographies. We compare the proposed algorithm to traditional feature-based and direct methods, as well as a corresponding supervised learning algorithm. Our empirical results demonstrate that compared to traditional approaches, the unsupervised algorithm achieves faster inference speed, while maintaining comparable or better accuracy and robustness to illumination variation. In addition, our unsupervised method has superior

adaptability and performance compared to the corresponding supervised deep learning method. Our image dataset and a Tensorflow implementation of our work are available at htt ps://github.com/tynguyen/unsupervisedDeepHomographyRAL2018.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com