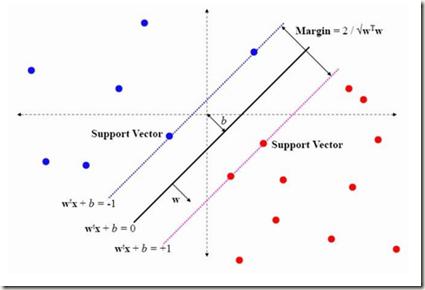

Relevance Vector Machine (RVM) is a supervised learning algorithm extended from Support Vector Machine (SVM) based on the Bayesian sparsity model. Compared with the regression problem, RVM classification is difficult to be conducted because there is no closed-form solution for the weight parameter posterior. Original RVM classification algorithm used Newton's method in optimization to obtain the mode of weight parameter posterior then approximated it by a Gaussian distribution in Laplace's method. It would work but just applied the frequency methods in a Bayesian framework. This paper proposes a Generic Bayesian approach for the RVM classification. We conjecture that our algorithm achieves convergent estimates of the quantities of interest compared with the nonconvergent estimates of the original RVM classification algorithm. Furthermore, a Fully Bayesian approach with the hierarchical hyperprior structure for RVM classification is proposed, which improves the classification performance, especially in the imbalanced data problem. By the numeric studies, our proposed algorithms obtain high classification accuracy rates. The Fully Bayesian hierarchical hyperprior method outperforms the Generic one for the imbalanced data classification.

翻译:相关性矢量机(RVM)是一种基于贝耶斯宽度模型的支持矢量机(SVM)的监督下学习算法。 与回归问题相比, RVM的分类很难进行, 因为重量参数子外表没有封闭式的解决方案。 原始 RVM 分类算法使用了牛顿的优化方法, 以获得重力参数的外表模式, 然后用拉普特方法以高斯分配法进行近似。 它会起作用, 只是在巴伊西亚框架中应用频率方法。 本文为RVM分类提出了一种通用的贝耶斯法。 我们推测, 我们的算法与原始RVM分类算法的非对等性估计相比, 利息数量达到了一致的估计数。 此外, 提议采用全巴伊西亚方法, 其等级结构超亮度结构用于RVM 分类, 从而改进分类性能, 特别是在不平衡的数据问题中。 通过数字研究, 我们提议的算法获得了高分类精确率。 我们推测, 完全贝伊等级高质高质高质方法将数据解算出一种数据。