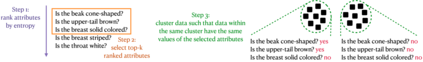

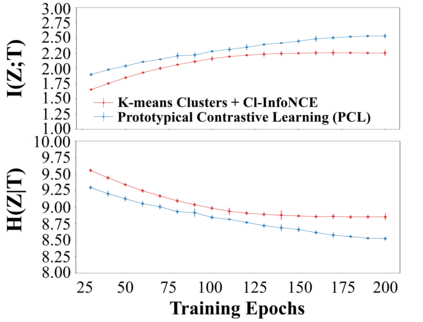

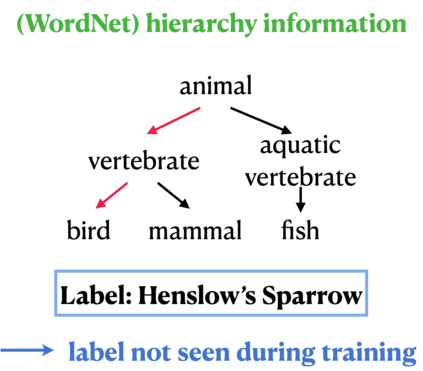

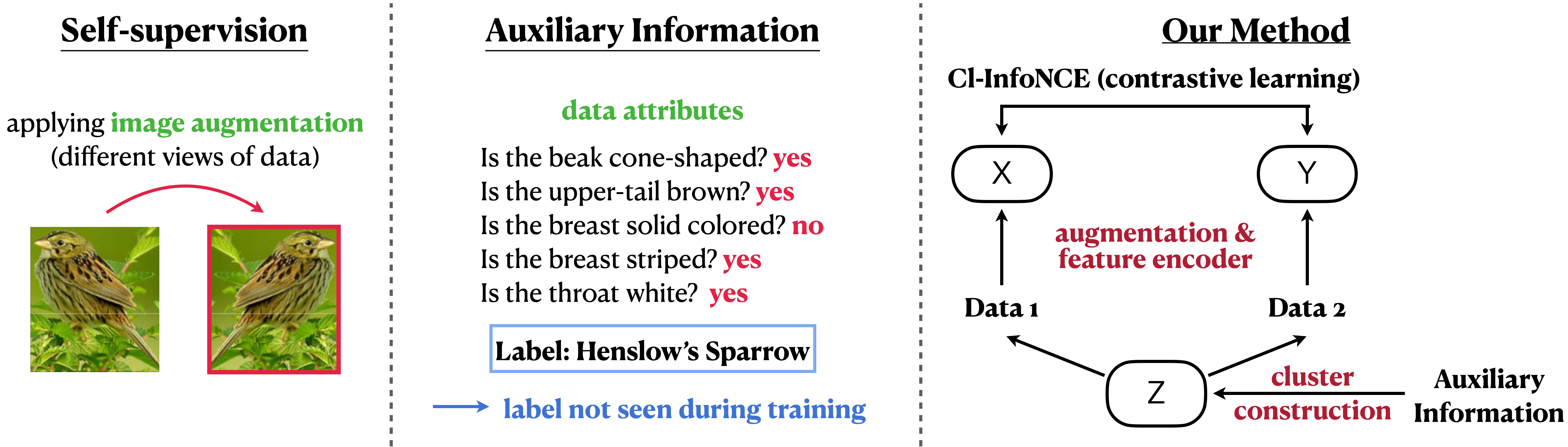

We argue that a form of the valuable information provided by the auxiliary information is its implied data clustering information. For instance, considering hashtags as auxiliary information, we can hypothesize that an Instagram image will be semantically more similar with the same hashtags. With this intuition, we present a two-stage weakly-supervised contrastive learning approach. The first stage is to cluster data according to its auxiliary information. The second stage is to learn similar representations within the same cluster and dissimilar representations for data from different clusters. Our empirical experiments suggest the following three contributions. First, compared to conventional self-supervised representations, the auxiliary-information-infused representations bring the performance closer to the supervised representations, which use direct downstream labels as supervision signals. Second, our approach performs the best in most cases, when comparing our approach with other baseline representation learning methods that also leverage auxiliary data information. Third, we show that our approach also works well with unsupervised constructed clusters (e.g., no auxiliary information), resulting in a strong unsupervised representation learning approach.

翻译:我们争论说,辅助信息提供的宝贵信息的一种形式是其隐含的数据组合信息。例如,将标签作为辅助信息,我们可以假设Instagram图像在语义上与同一标签更加相似。用这种直觉,我们呈现出一种两阶段的薄弱监督对比学习方法。第一阶段是根据其辅助信息对数据进行分组;第二阶段是在同一组群中学习相似的表述,不同组群数据的不同表述。我们的经验实验表明有以下三种贡献。首先,与传统的自我监督的表述相比,辅助信息输入的表述使业绩更接近监督的表述,后者使用直接的下游标签作为监督信号。第二,我们的方法在多数情况下表现最佳,将我们的方法与其他基线代表学习方法进行比较,后者也利用辅助数据信息。第三,我们表明,我们的方法也与非超强的构建组群集体(例如,没有辅助信息)运作良好。导致一种强大的非超导代表学习方法。