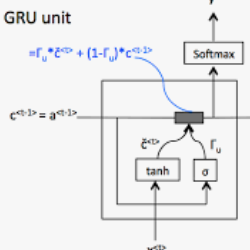

Session-based recommendation (SBR) aims to predict the user next action based on the ongoing sessions. Recently, there has been an increasing interest in modeling the user preference evolution to capture the fine-grained user interests. While latent user preferences behind the sessions drift continuously over time, most existing approaches still model the temporal session data in discrete state spaces, which are incapable of capturing the fine-grained preference evolution and result in sub-optimal solutions. To this end, we propose Graph Nested GRU ordinary differential equation (ODE), namely GNG-ODE, a novel continuum model that extends the idea of neural ODEs to continuous-time temporal session graphs. The proposed model preserves the continuous nature of dynamic user preferences, encoding both temporal and structural patterns of item transitions into continuous-time dynamic embeddings. As the existing ODE solvers do not consider graph structure change and thus cannot be directly applied to the dynamic graph, we propose a time alignment technique, called t-Alignment, to align the updating time steps of the temporal session graphs within a batch. Empirical results on three benchmark datasets show that GNG-ODE significantly outperforms other baselines.

翻译:以会话为基础的建议( SBR) 旨在预测用户在进行中的会议基础上的下一步行动。 最近,人们越来越有兴趣模拟用户偏好的变化,以捕捉细微的用户兴趣。 尽管会话背后的潜在用户偏好随时间而不断飘移,但大多数现有办法仍然在离散的状态空间模拟时间会话数据,这些空间无法捕捉细微偏好的变化,因此无法产生亚最佳的解决方案。 为此,我们提议了Nested GRU普通差异方程(ODE)图,即GNG-ODE,这是一个新的连续性连续模式,将神经观察器的概念扩展至连续的时间会话图。 拟议的模式保留动态用户偏好的持续性质,将项目转换的时间和结构模式编码为连续的动态动态动态嵌入。 由于现有的 ODODS 解析器不考虑图形结构的变化,因此无法直接应用于动态图表,我们提议了时间调整技术,称为t-Agrement, 以将时间会话图的更新时间步骤与分批调。 三个基准数据集的 Epicalalal结果显示GNG-ODE明显超出其他基线。