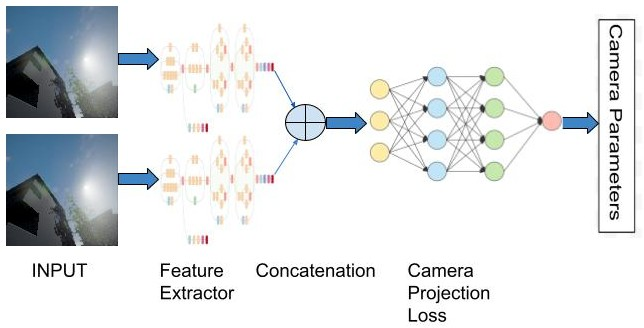

Camera calibration is a necessity in various tasks including 3D reconstruction, hand-eye coordination for a robotic interaction, autonomous driving, etc. In this work we propose a novel method to predict extrinsic (baseline, pitch, and translation), intrinsic (focal length and principal point offset) parameters using an image pair. Unlike existing methods, instead of designing an end-to-end solution, we proposed a new representation that incorporates camera model equations as a neural network in multi-task learning framework. We estimate the desired parameters via novel \emph{camera projection loss} (CPL) that uses the camera model neural network to reconstruct the 3D points and uses the reconstruction loss to estimate the camera parameters. To the best of our knowledge, ours is the first method to jointly estimate both the intrinsic and extrinsic parameters via a multi-task learning methodology that combines analytical equations in learning framework for the estimation of camera parameters. We also proposed a novel dataset using CARLA Simulator. Empirically, we demonstrate that our proposed approach achieves better performance with respect to both deep learning-based and traditional methods on 7 out of 10 parameters evaluated using both synthetic and real data. Our code and generated dataset will be made publicly available to facilitate future research.

翻译:在这项工作中,我们提出一种新的方法,用图像组合来预测外部(基线、投球和翻译)、内在(焦距长度和主点偏移)参数。与现有方法不同,我们建议采用新的表述方式,将相机模型方程式作为神经网络纳入多任务学习框架中,在多任务学习框架中作为神经网络。我们通过新颖的 emph{camera投影损失(CPL) 来估计理想的参数,利用相机模型神经网络重建3D点并利用重建损失来估计相机参数。我们最了解的是,我们是通过多任务学习方法共同估计固有参数和外部参数的第一个方法,该方法将分析方程式结合到用于估计相机参数的学习框架中。我们还提议使用CARLA Simpula投影仪(CPL)来估计所需的参数。我们提议的方法在深度学习基础和传统方法方面都取得了更好的性能,并利用重建损失来估计相机参数参数参数参数参数。根据我们的知识,我们的第一个方法是通过多任务学习方法共同估计内在参数和外部生成的10项参数,我们将用我们现有的实际和合成数据来评估。