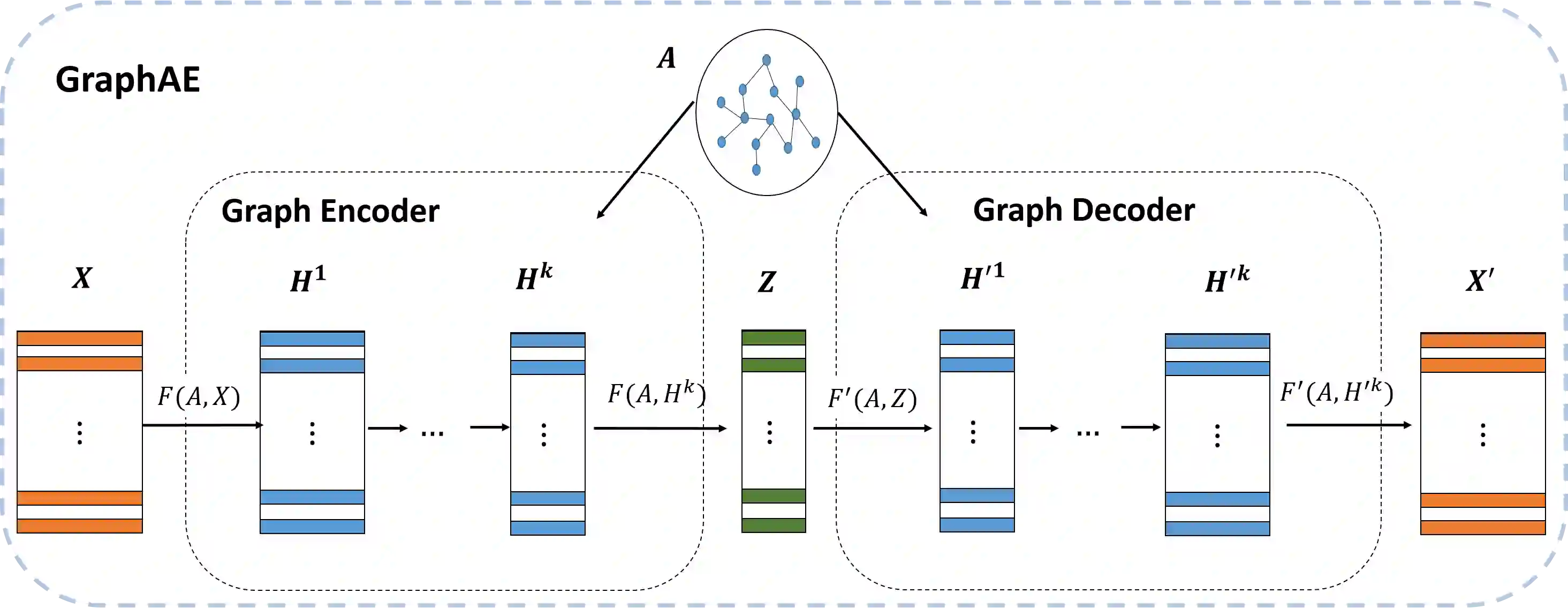

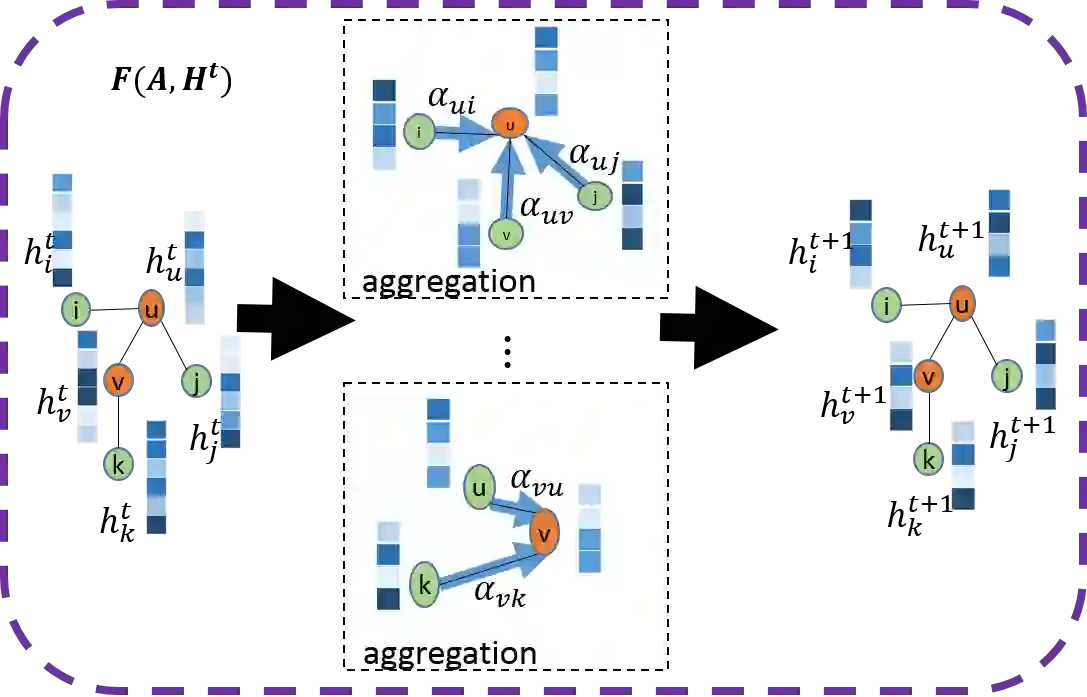

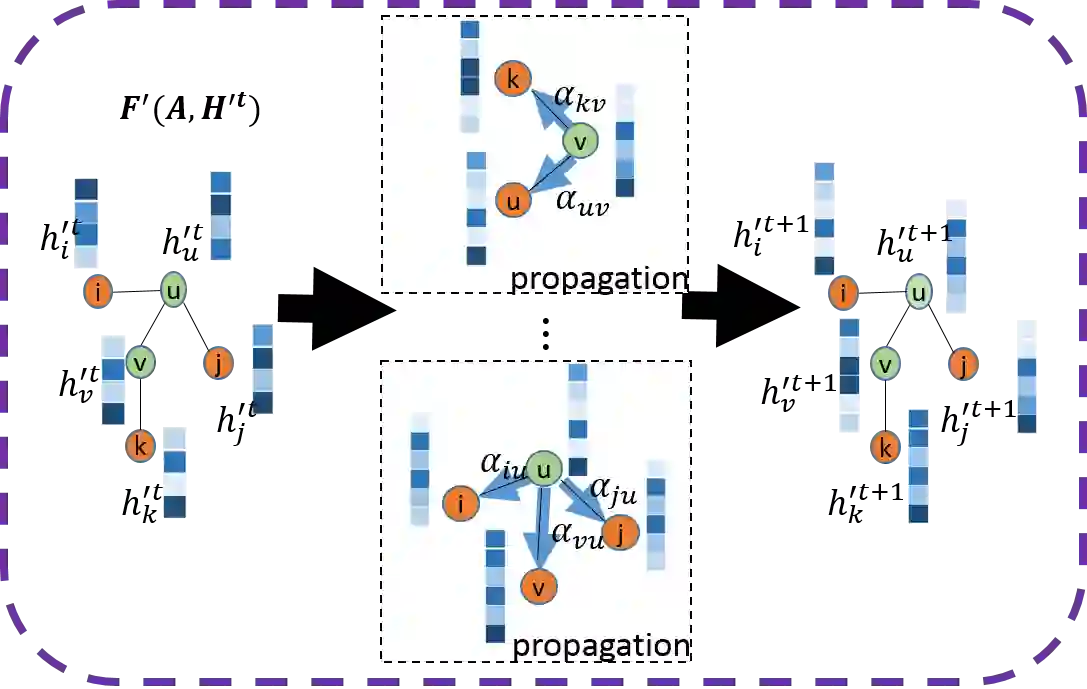

Attributed network embedding aims to learn low-dimensional node representations from both network structure and node attributes. Existing methods can be categorized into two groups: (1) the first group learns two separated node representations from network structure and node attribute respectively and concatenating them together; (2) the other group obtains node representations by translating node attributes into network structure or vice versa. However, both groups have their drawbacks. The first group neglects the correlation between these two types of information, while the second group assumes strong dependence between network structure and node attributes. In this paper, we address attributed network embedding from a novel perspective, i.e., learning representation of a target node via modeling its attributed local subgraph. To achieve this goal, we propose a novel graph auto-encoder framework, namely GraphAE. For a target node, GraphAE first aggregates the attribute information from its attributed local subgrah, obtaining its low-dimensional representation. Next, GraphAE diffuses its representation to nodes in its local subgraph to reconstruct their attribute information. Our proposed perspective transfroms the problem of learning node representations into the problem of modeling the context information manifested in both network structure and node attributes, thus having high capacity to learn good node representations for attributed network. Extensive experimental results on real-world datasets demonstrate that the proposed framework outperforms the state-of-the-art network approaches at the tasks of link prediction and node classification.

翻译:嵌入网络的属性包含网络结构和节点属性的低维节点表示方式。现有方法可以分为两类:(1) 第一类组分别从网络结构和节点属性中学习两个分隔节点表示方式,并将其混为一体;(2) 另一组组通过将节点属性转换成网络结构或反之,获得节点表示方式。但是,两组都有它们的缺点。第一类组忽略了这两类信息之间的相互关系,而第二类组则在网络结构和节点属性之间有着很强的依赖性。在本文件中,我们处理从新角度对嵌入的网络进行分级,即通过对所属本地子集进行建模来学习目标节点表示方式。为实现这一目标,我们提议了一个新颖的图形自动编码框架框架,即图AE。对于一个目标节点,GreagAE首先汇总了其所属本地子组的属性信息,获得其低维度表示方式。第二组则将其表示方式分散到节点,以重建其属性信息。我们提议的视角是从不理解对高端网络结构进行交叉分析的问题,因此将高端网络显示为良好的模型。