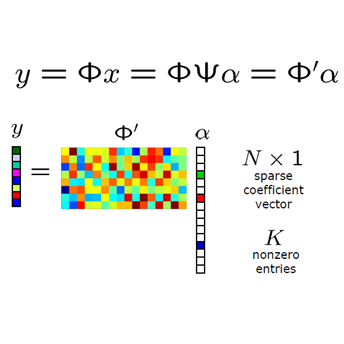

The plug-and-play priors (PnP) and regularization by denoising (RED) methods have become widely used for solving inverse problems by leveraging pre-trained deep denoisers as image priors. While the empirical imaging performance and the theoretical convergence properties of these algorithms have been widely investigated, their recovery properties have not previously been theoretically analyzed. We address this gap by showing how to establish theoretical recovery guarantees for PnP/RED by assuming that the solution of these methods lies near the fixed-points of a deep neural network. We also present numerical results comparing the recovery performance of PnP/RED in compressive sensing against that of recent compressive sensing algorithms based on generative models. Our numerical results suggest that PnP with a pre-trained artifact removal network provides significantly better results compared to the existing state-of-the-art methods.

翻译:插图和剧本前置( PnP) 和通过分解( RED) 实现正规化的方法已被广泛用于解决反向问题, 利用预先训练的深深深低沉积器作为图像前置。 虽然对这些算法的经验成像性能和理论趋同特性进行了广泛调查, 但这些算法的恢复特性以前从未进行过理论分析。 我们通过假设这些方法的解决方案接近深神经网络的固定点, 来展示如何为PnP/ RED建立理论回收保障, 从而弥补这一差距。 我们还提供了数字结果, 比较了PnP/ RED在压缩感测与最近基于基因模型的压缩感测算法的恢复性能。 我们的数字结果表明, 与经过预先训练的文物清除网络相比, PnP提供了显著更好的结果。