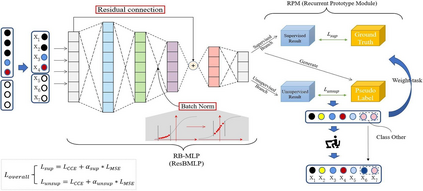

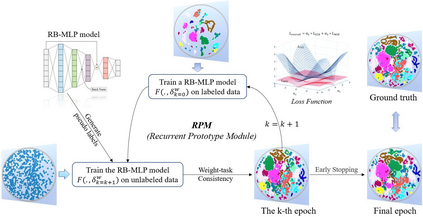

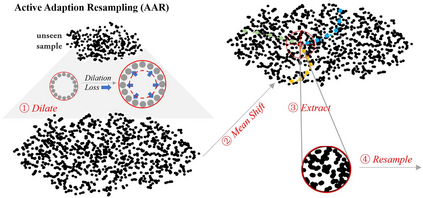

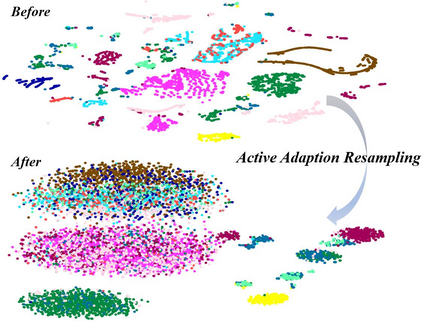

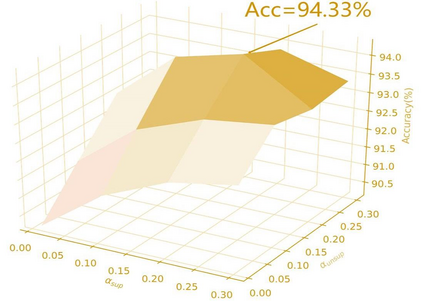

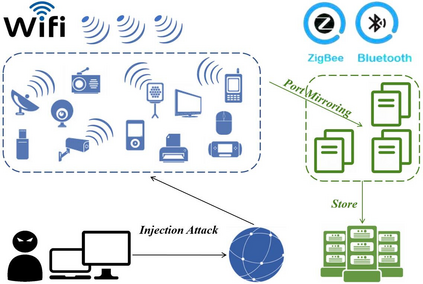

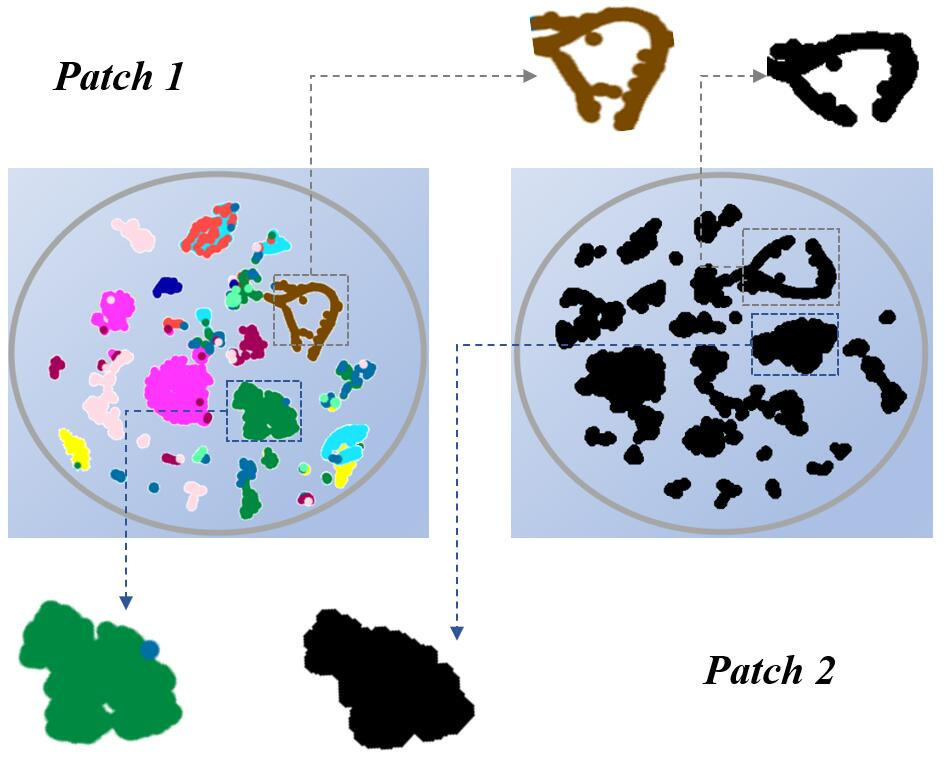

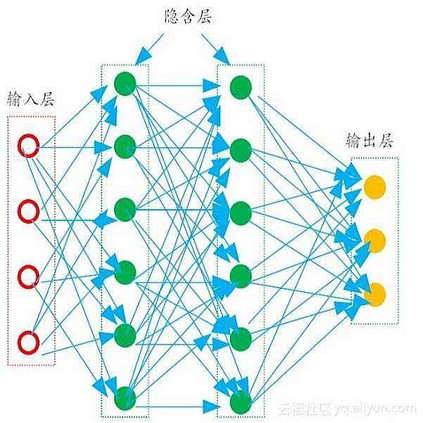

Supervised learning has been widely used for attack detection, which requires large amounts of high-quality data and labels. However, the data is often imbalanced and sufficient annotations are difficult to obtain. Moreover, these supervised models are subject to real-world deployment issues, such as defending against unseen artificial attacks. We propose a semi-supervised fine-grained attack categorization framework consisting of an encoder and a two-branch structure to integrate information from labeled and unlabeled data to tackle these practical challenges. This framework can be generalized to different supervised models. The multilayer perceptron with residual connection and batch normalization is used as the encoder to extract features and reduce the complexity. The Recurrent Prototype Module (RPM) is proposed to train the encoder effectively in a semi-supervised manner. To alleviate the problem of data imbalance, we introduce the Weight-Task Consistency (WTC) into the iterative process of RPM by assigning larger weights to classes with fewer samples in the loss function. In addition, to cope with new attacks in real-world deployment, we further propose an Active Adaption Resampling (AAR) method, which can better discover the distribution of the unseen sample data and adapt the parameters of the encoder. Experimental results show that our model outperforms the state-of-the-art semi-supervised attack detection methods with a general 5% improvement in classification accuracy and a 90% reduction in training time.

翻译:监视性学习被广泛用于攻击检测,这需要大量高质量的数据和标签。然而,数据往往不平衡,难以获得足够的说明。此外,这些受监督模型还存在真实世界部署问题,例如防范隐蔽的人工攻击。我们提议采用半监督的细微攻击分类框架,其中包括一个编码器和一个双分队结构,将标签和未贴标签数据中的信息整合在一起,以应对这些实际挑战。这个框架可以推广到不同的监督模型。剩余连接和批次正常化的多层感应器被用作提取特征和降低复杂性的编码器。经常的原型模块(RPM)建议以半监督的方式有效培训编码器。为缓解数据不平衡问题,我们将Weight-Task Consisticle (WTC) 引入RPM的迭接程序,将较大的重量分配给损失功能中样本较少的班级。此外,为了应对现实世界部署中的新攻击,我们进一步提议采用“积极调整”式的精确度模块,在50级级级的测试中采用一种测试模型,以更好的方法来改进我们的实验性测试结果。