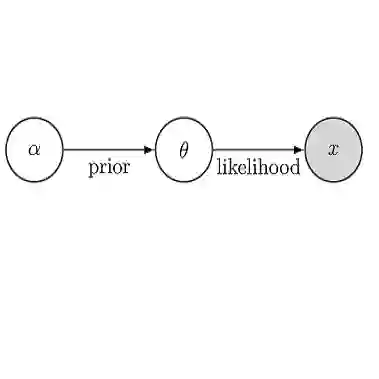

We introduce a methodology for robust Bayesian estimation with robust divergence (e.g., density power divergence or {\gamma}-divergence), indexed by a single tuning parameter. It is well known that the posterior density induced by robust divergence gives highly robust estimators against outliers if the tuning parameter is appropriately and carefully chosen. In a Bayesian framework, one way to find the optimal tuning parameter would be using evidence (marginal likelihood). However, we numerically illustrate that evidence induced by the density power divergence does not work to select the optimal tuning parameter since robust divergence is not regarded as a statistical model. To overcome the problems, we treat the exponential of robust divergence as an unnormalized statistical model, and we estimate the tuning parameter via minimizing the Hyvarinen score. We also provide adaptive computational methods based on sequential Monte Carlo (SMC) samplers, which enables us to obtain the optimal tuning parameter and samples from posterior distributions simultaneously. The empirical performance of the proposed method through simulations and an application to real data are also provided.

翻译:我们引入了一种方法,用一个单一调试参数作为索引,进行稳健的贝叶斯估计(例如,密度功率差异或 ~伽马}-引力),并用一个单一调试参数作为索引。众所周知,如果调试参数选择得当和谨慎,则由强力差异引发的后方密度会给外部线带来非常强的测算器。在一个贝叶斯框架,找到最佳调试参数的一种方法就是利用证据(边缘可能性)。然而,我们用数字来说明,由于将强力差异不视为统计模型,由密度功率差异引起的证据无法选择最佳调控参数。为了克服问题,我们将强力差异的指数视为非正常化的统计模型,我们通过尽量减少Hyvarinen分数来估计调控参数。我们还提供了基于连续的蒙特卡洛(SMC)取样器的适应性计算方法,使我们能够同时从远端分布中获取最佳调参数和样本。还提供了通过模拟和真实数据应用的方法的经验性表现。