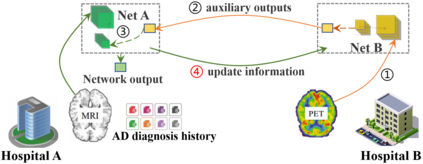

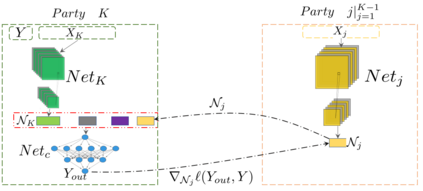

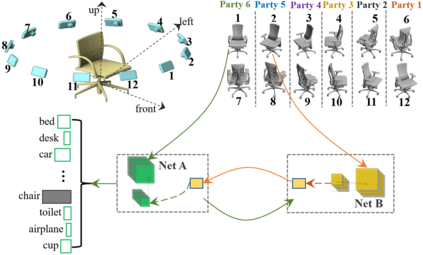

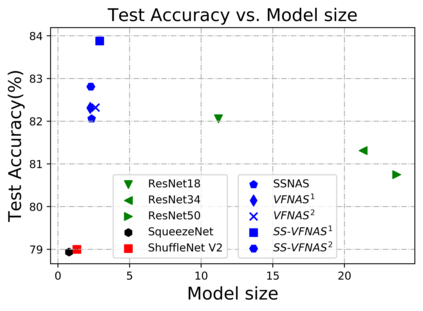

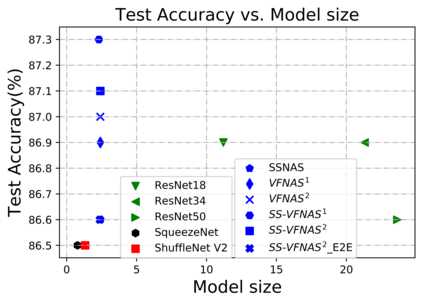

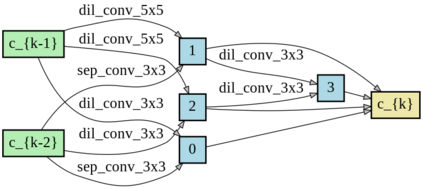

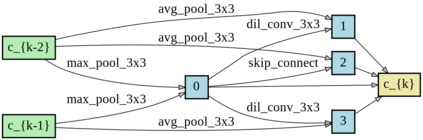

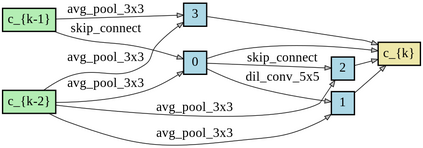

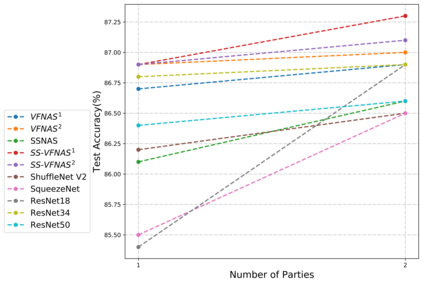

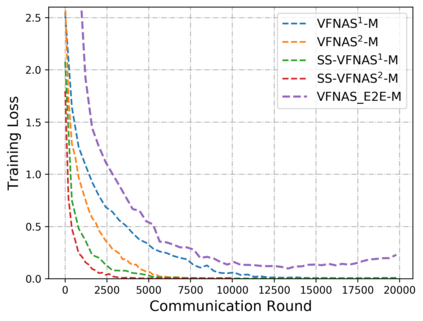

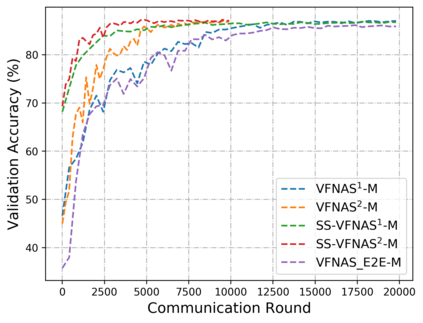

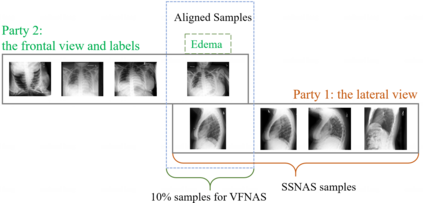

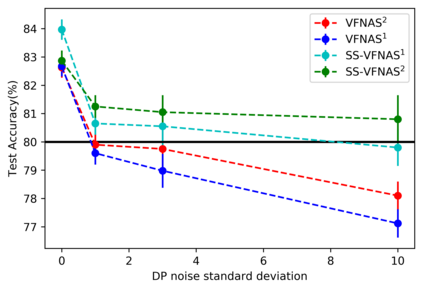

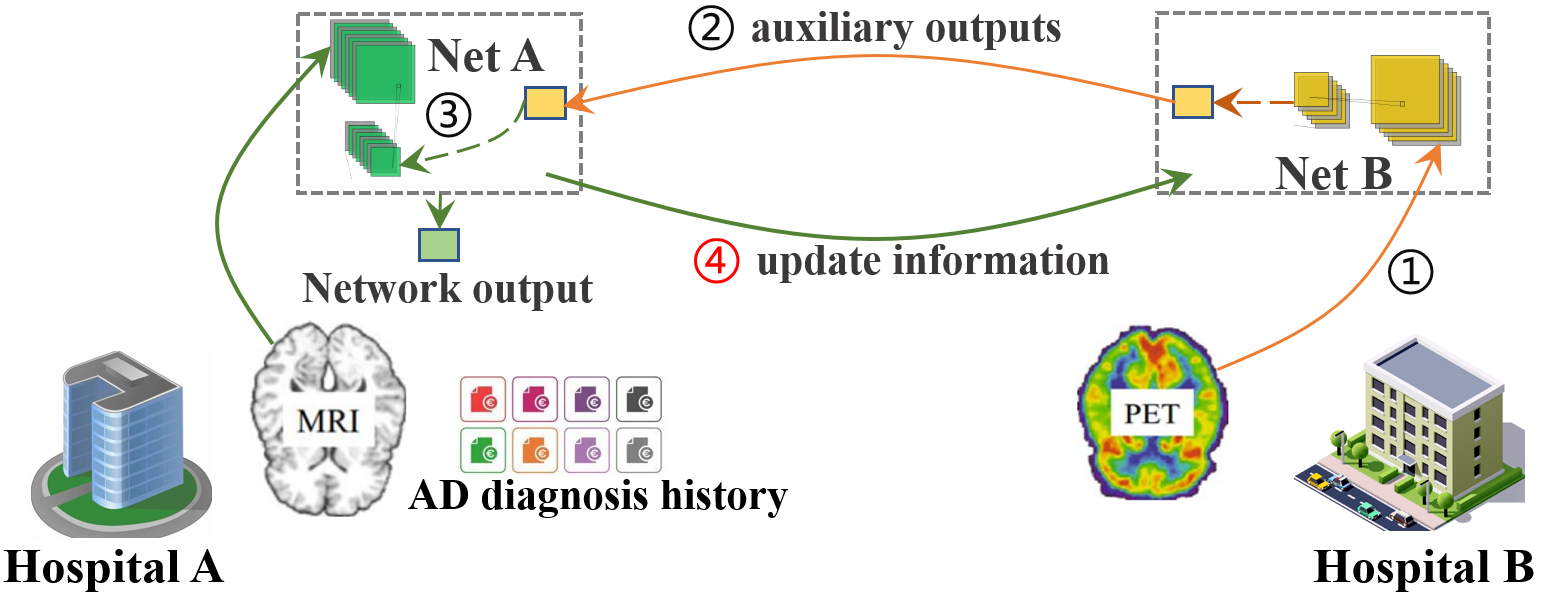

Federated Learning (FL) provides both model performance and data privacy for machine learning tasks where samples or features are distributed among different parties. In the training process of FL, no party has a global view of data distributions or model architectures of other parties. Thus the manually-designed architectures may not be optimal. In the past, Neural Architecture Search (NAS) has been applied to FL to address this critical issue. However, existing Federated NAS approaches require prohibitive communication and computation effort, as well as the availability of high-quality labels. In this work, we present Self-supervised Vertical Federated Neural Architecture Search (SS-VFNAS) for automating FL where participants hold feature-partitioned data, a common cross-silo scenario called Vertical Federated Learning (VFL). In the proposed framework, each party first conducts NAS using self-supervised approach to find a local optimal architecture with its own data. Then, parties collaboratively improve the local optimal architecture in a VFL framework with supervision. We demonstrate experimentally that our approach has superior performance, communication efficiency and privacy compared to Federated NAS and is capable of generating high-performance and highly-transferable heterogeneous architectures even with insufficient overlapping samples, providing automation for those parties without deep learning expertise.

翻译:联邦学习联合会(FL)为不同缔约方之间分配样本或特征的机器学习任务提供示范性业绩和数据隐私。在FL的培训过程中,没有一个缔约方对其他缔约方的数据分配或模型结构具有全球观点。因此,手工设计的建筑可能不是最佳的。过去,对FL应用神经结构搜索(NAS)来解决这一关键问题。然而,现有的联邦NAS(NAS)方法需要令人望而却步的通信和计算努力以及高质量的标签。在这项工作中,我们提出自我监督的垂直联邦神经结构纵向纵向搜索(SS-VFUNAS),用于将FL自动化,因为参与者持有地段数据或其它缔约方的模型结构或模型结构。因此,手工设计的建筑可能不是最佳的。在过去,神经结构搜索(NAS)已经应用到FLS(NAS)系统(NAS)系统(NAS)系统(NAS)系统(NAS)系统(NAS)系统(NAS)系统(NAS)系统,以自我监督的方式寻找地方最佳架构。然后,各方合作改进VFLLFL框架中的当地最佳架构。我们实验性地表明,我们的方法比UFRS(SS(SS(SS)系统)系统)系统(SS(SS(SS-VFL-VFL)系统)系统)系统(SS-S)系统(SS-VD-VD-FL)系统)系统(SS-VD-FL)系统(SS-S)系统)系统(SS(SS(SS)系统)系统)系统(SS(SS(SS-S)系统)具有更高的性能性能性、通信效率和和私隐性能性能性能性能性能性能性能和性能性能性能性能性能性能,不高,不高,不高,不进行高的现代化,不进行高的现代化,且不进行高的现代化,不高的现代化,不高的现代化的模型,不高的升级)和不具有高的现代化的现代化的现代化,不具有高度交。