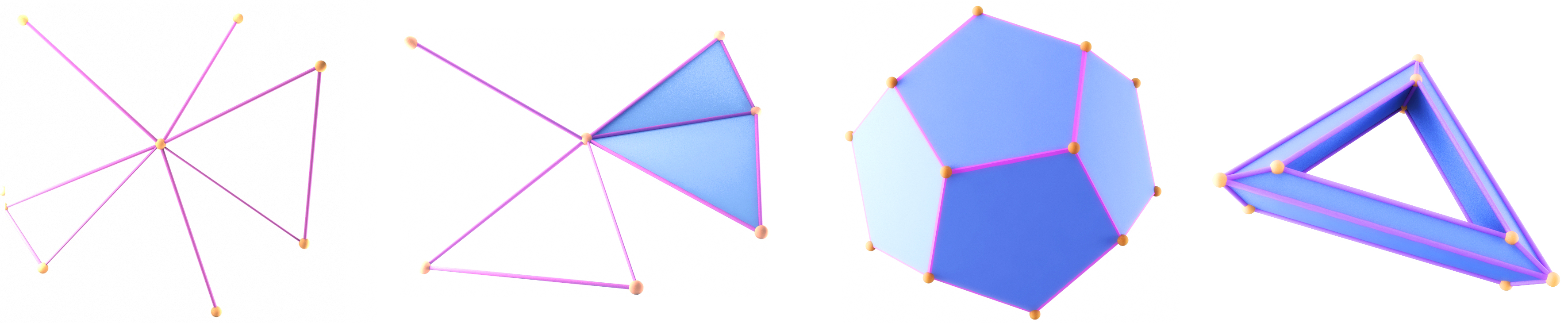

Cell complexes are topological spaces constructed from simple blocks called cells. They generalize graphs, simplicial complexes, and polyhedral complexes that form important domains for practical applications. They also provide a combinatorial formalism that allows the inclusion of complicated relationships of restrictive structures such as graphs and meshes. In this paper, we propose \textbf{Cell Complexes Neural Networks (CXNs)}, a general, combinatorial and unifying construction for performing neural network-type computations on cell complexes. We introduce an inter-cellular message passing scheme on cell complexes that takes the topology of the underlying space into account and generalizes message passing scheme to graphs. Finally, we introduce a unified cell complex encoder-decoder framework that enables learning representation of cells for a given complex inside the Euclidean spaces. In particular, we show how our cell complex autoencoder construction can give, in the special case \textbf{cell2vec}, a generalization for node2vec.

翻译:细胞综合体是用简单块块(称为细胞)构造的表层空间。 它们一般化图形、 简易综合体和多元综合体, 形成重要的实用应用领域 。 它们也提供组合式形式主义, 允许包含像图形和 meshes 等限制性结构的复杂关系 。 在本文中, 我们提议 \ textbf{ Cell Complex CynalNetworks (CXNs)}, 用于在细胞综合体上进行神经网络类型计算的一般、 组合和统一构造 。 我们在细胞综合体上引入一个细胞间信息传递方案, 将基础空间的表层学考虑在内, 并将信息传递方案概括到图表中 。 最后, 我们引入一个统一的细胞综合编码- 解码- 框架, 使得在 Euclidean 空间内某个给定的复合体能学习细胞的表达方式。 具体地说, 我们展示我们的细胞复杂自动电解构造在特殊情况下, \ textf{cell2vec} 能够给Notde2vec 带来什么一般化 。