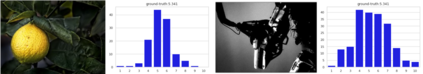

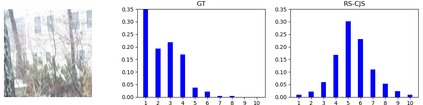

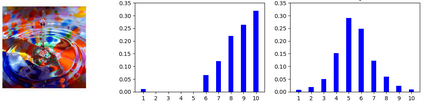

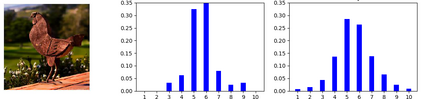

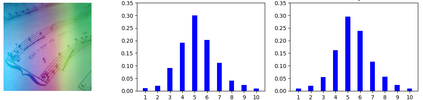

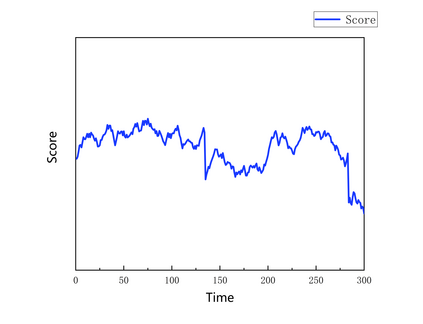

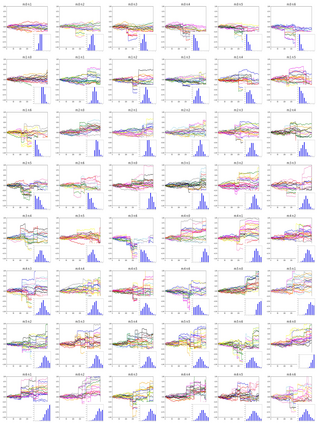

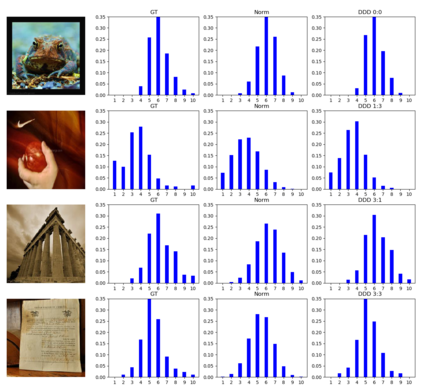

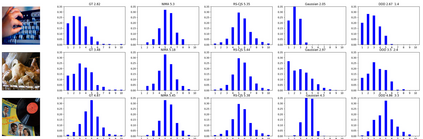

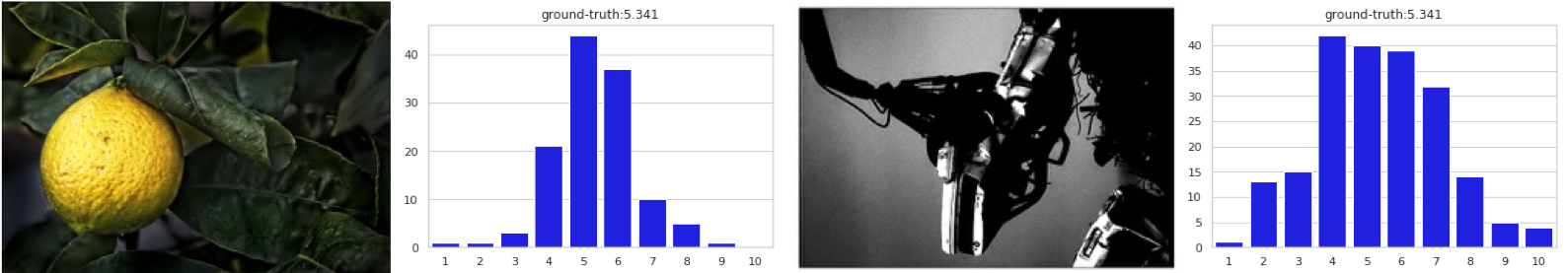

The task of aesthetic quality assessment is complicated due to its subjectivity. In recent years, the target representation of image aesthetic quality has changed from a one-dimensional binary classification label or numerical score to a multi-dimensional score distribution. According to current methods, the ground truth score distributions are straightforwardly regressed. However, the subjectivity of aesthetics is not taken into account, that is to say, the psychological processes of human beings are not taken into consideration, which limits the performance of the task. In this paper, we propose a Deep Drift-Diffusion (DDD) model inspired by psychologists to predict aesthetic score distribution from images. The DDD model can describe the psychological process of aesthetic perception instead of traditional modeling of the results of assessment. We use deep convolution neural networks to regress the parameters of the drift-diffusion model. The experimental results in large scale aesthetic image datasets reveal that our novel DDD model is simple but efficient, which outperforms the state-of-the-art methods in aesthetic score distribution prediction. Besides, different psychological processes can also be predicted by our model.

翻译:审美质量评估的任务由于其主观性而复杂。 近年来,图像审美质量的目标表示已经从一维二进制分类标签或数字分数变为多维分分布。 根据目前的方法,地面真相分数分布是直截了当的倒退。然而,没有考虑到审美的主观性,也就是说,人类的心理过程没有被考虑,这限制了任务的绩效。在本文中,我们提议了由心理学家启发的深漂移(DDDD)模型,以预测图像的审美分分布。DDD模型可以描述审美感的心理过程,而不是传统的评估结果模型模型。我们使用深演进神经网络来重新研究漂移模型的参数。大规模审美图像数据集的实验结果显示,我们的新DDDD模型简单但有效,这超过了审美分分布预测中的最新方法。此外,不同的心理过程也可以由我们的模型预测。