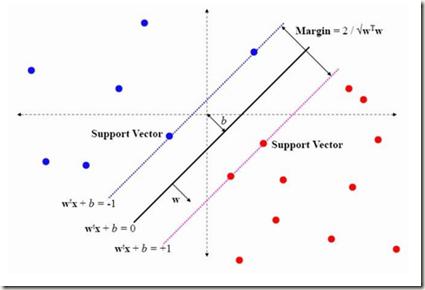

In recent years, feature selection has become a challenging problem in several machine learning fields, such as classification problems. Support Vector Machine (SVM) is a well-known technique applied in classification tasks. Various methodologies have been proposed in the literature to select the most relevant features in SVM. Unfortunately, all of them either deal with the feature selection problem in the linear classification setting or propose ad-hoc approaches that are difficult to implement in practice. In contrast, we propose an embedded feature selection method based on a min-max optimization problem, where a trade-off between model complexity and classification accuracy is sought. By leveraging duality theory, we equivalently reformulate the min-max problem and solve it without further ado using off-the-shelf software for nonlinear optimization. The efficiency and usefulness of our approach are tested on several benchmark data sets in terms of accuracy, number of selected features and interpretability.

翻译:近年来,在诸如分类问题等若干机械学习领域,地物选择已成为一个具有挑战性的难题。支持矢量机(SVM)是用于分类任务的一种众所周知的技术。文献中提出了各种方法来选择SVM中最相关的特征。不幸的是,所有这些方法要么处理线性分类设置中的地物选择问题,要么提出在实践中难以执行的临时性方法。相比之下,我们提议基于微量最大优化问题的嵌入性地物选择方法,在模型复杂性和分类准确性之间求得平衡。我们利用双重性理论,将微量轴问题进行等同重新配置,并在不使用现成软件进一步进行非线性优化的情况下加以解决。我们的方法的效率和有用性在精确性、选定特征的数量和可解释性等几个基准数据集上进行了测试。