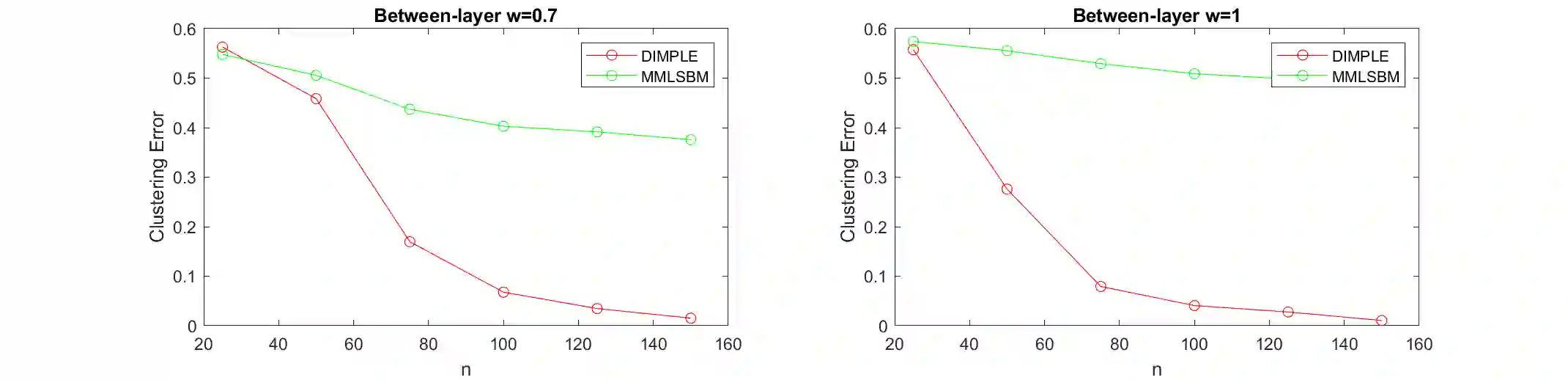

The paper introduces the DIverse MultiPLEx Generalized Dot Product Graph (DIMPLE-GDPG) network model where all layers of the network have the same collection of nodes and follow the Generalized Dot Product Graph (GDPG) model. In addition, all layers can be partitioned into groups such that the layers in the same group are embedded in the same ambient subspace but otherwise all matrices of connection probabilities can be different. In a common particular case, where layers of the network follow the Stochastic Block Model (SBM), this setting implies that the groups of layers have common community structures but all matrices of block connection probabilities can be different. We refer to this version as the DIMPLE model. While the DIMPLE-GDPG model generalizes the COmmon Subspace Independent Edge (COSIE) random graph model developed in \cite{JMLR:v22:19-558}, the DIMPLE model includes a wide variety of SBM-equipped multilayer network models as its particular cases. In the paper, we introduce novel algorithms for the recovery of similar groups of layers, for the estimation of the ambient subspaces in the groups of layers in the DIMPLE-GDPG setting, and for the within-layer clustering in the case of the DIMPLE model. We study the accuracy of those algorithms, both theoretically and via computer simulations. The advantages of the new models are demonstrated using real data examples.

翻译:本文引入了多元广义点积图网络模型 DIMPLE-GDPG,其中所有层次的网络具有相同的节点集,并遵循广义点积图 GDPG 模型。此外,所有层次可以被分为群组,使得在同一群组中的层次嵌入相同的环境子空间,但是除此之外所有连接概率矩阵都可以不同。在一个常见的具体情况下,网络层遵循随机块模型(SBM),这意味着层组具有常见的社区结构,但所有块连通概率矩阵都可能不同。我们将这个版本称为 DIMPLE 模型。虽然 DIMPLE-GDPG 模型推广了在文献 [1] 中开发的 COSIE 随机图模型,DIMPLE 模型包括一系列 SBM 多层网络模型作为其特殊情况。在本文中,我们介绍了相似层次群组恢复的新算法,DIMPLE-GDPG 设置中群组内环境子空间的估计算法,以及在 DIMPLE 模型情况下的层内聚类算法。我们从理论和计算机模拟两个方面研究了这些算法的准确性。新模型的优点通过真实数据示例得到证明。