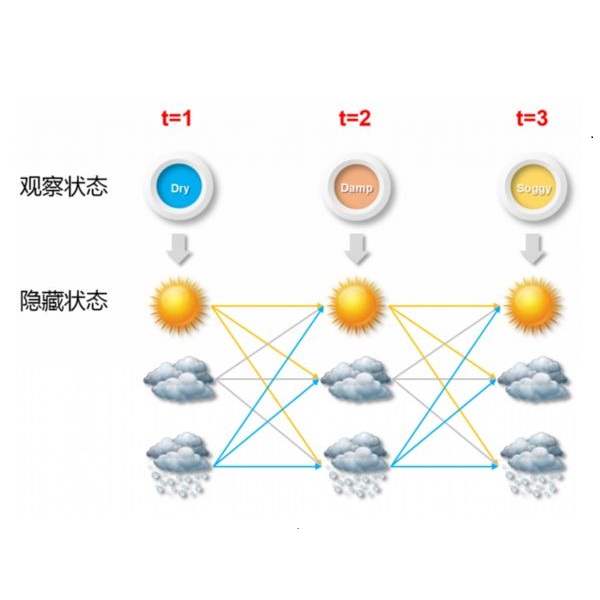

The study of animal behavioural states inferred through hidden Markov models and similar state switching models has seen a significant increase in popularity in recent years. The ability to account for varying levels of behavioural scale has become possible through hierarchical hidden Markov models, but additional levels lead to higher complexity and increased correlation between model components. Maximum likelihood approaches to inference using the EM algorithm and direct optimisation of likelihoods are more frequently used, with Bayesian approaches being less favoured due to computational demands. Given these demands, it is vital that efficient estimation algorithms are developed when Bayesian methods are preferred. We study the use of various approaches to improve convergence times and mixing in Markov chain Monte Carlo methods applied to hierarchical hidden Markov models, including parallel tempering as an inference facilitation mechanism. The method shows promise for analysing complex stochastic models with high levels of correlation between components, but our results show that it requires careful tuning in order to maximise that potential.

翻译:通过隐蔽的Markov模型和类似的状态转换模型对动物行为状态的研究近年来出现了显著的受欢迎程度。通过等级隐蔽的Markov模型,可以对不同程度的行为规模进行核算,但更多的等级导致模型各组成部分之间的复杂程度和相关性的提高。使用EM算法和直接优化可能性的最大可能性方法被更频繁地使用,而由于计算需求,巴伊西亚方法不那么受欢迎。鉴于这些需求,在选择Bayesian方法时必须制定高效的估算算法。我们研究在Markov链中采用多种方法来改进汇合时间和混合Monte Carlo方法以适用于等级隐蔽的Markov模型,包括作为推论促进机制的平行调节。该方法显示了分析复杂的随机模型和不同组成部分之间高度关联的可能性,但我们的结果表明,为了最大限度地发挥这一潜力,需要仔细调整。