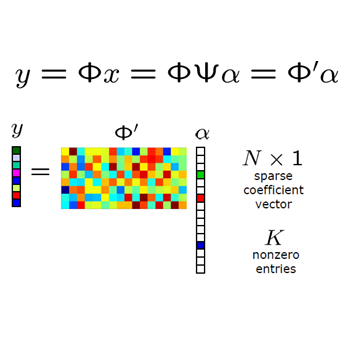

Incorporating deep neural networks in image compressive sensing (CS) receives intensive attentions in multimedia technology and applications recently. As deep network approaches learn the inverse mapping directly from the CS measurements, the reconstruction speed is significantly faster than the conventional CS algorithms. However, for existing network based approaches, a CS sampling procedure has to map a separate network model. This may potentially degrade the performance of image CS with block-wise sampling because of blocking artifacts, especially when multiple sampling rates are assigned to different blocks within an image. In this paper, we develop a multichannel deep network for block-based image CS by exploiting inter-block correlation with performance significantly exceeding the current state-of-the-art methods. The significant performance improvement is attributed to block-wise approximation but full image removal of blocking artifacts. Specifically, with our multichannel structure, the image blocks with a variety of sampling rates can be reconstructed in a single model. The initially reconstructed blocks are then capable of being reassembled into a full image to improve the recovered images by unrolling a hand-designed block based CS recovery algorithm. Experimental results demonstrate that the proposed method outperforms the state-of-the-art CS methods by a large margin in terms of objective metrics and subjective visual image quality. Our source codes are available at https://github.com/siwangzhou/DeepBCS.

翻译:将深心神经网络纳入图像压缩传感器(CS)最近受到多媒体技术和应用的高度关注。随着深心网络方法直接从 CS 测量中学习反向映射,重建速度大大快于常规 CS算法。然而,对于现有的基于网络的方法,CS 取样程序必须绘制一个单独的网络模型。这可能会通过屏蔽人工制品而使图像 CS 的性能降低,特别是当多个取样率被分配到图像中的不同区块时。在本文中,我们开发了一个用于块基图像 CS 的多通道深心网络,利用区块与当前最先进的性能之间的交互关系。 显著的性能改进归功于基于块的近似但完全图像的阻挡性能。 具体地说,由于我们的多声道结构,具有各种采样率的图像区块可以通过一个单一模型进行重建。 最初重建的区块随后能够重新组合成一个完整的图像来改进回收的图像,方法是将基于手设计的 CS 恢复法的区块与目前最先进的方法。 实验性结果结果显示我们所持的C/BS 的图像质量标准, 以现有的硬度标准格式,以现有的硬度标准方法显示我们现有的硬度标准。