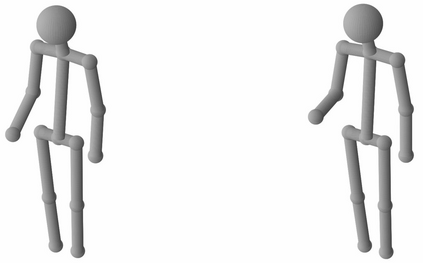

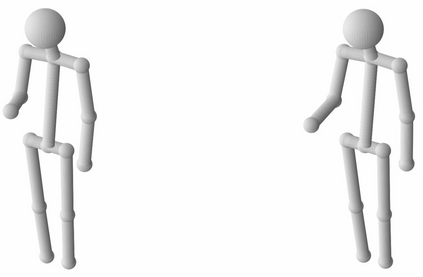

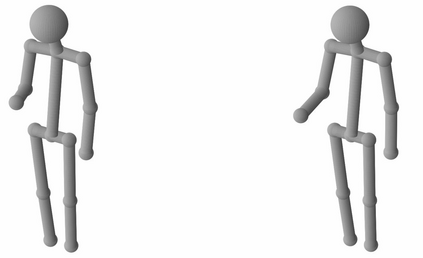

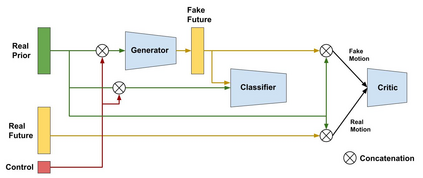

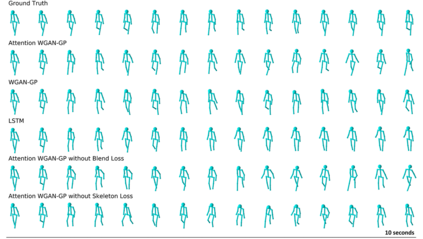

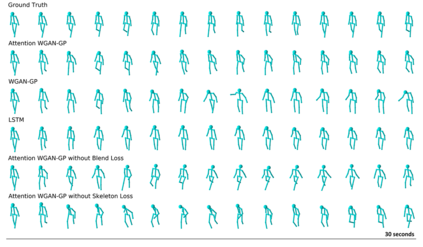

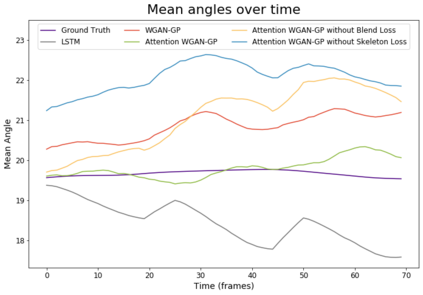

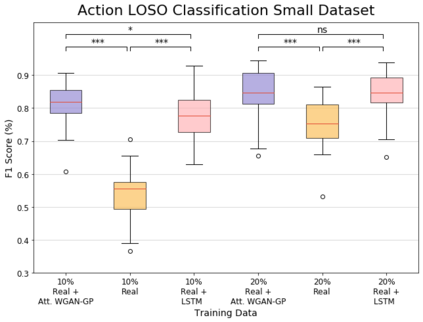

Analysing human motions is a core topic of interest for many disciplines, from Human-Computer Interaction, to entertainment, Virtual Reality and healthcare. Deep learning has achieved impressive results in capturing human pose in real-time. On the other hand, due to high inter-subject variability, human motion analysis models often suffer from not being able to generalise to data from unseen subjects due to very limited specialised datasets available in fields such as healthcare. However, acquiring human motion datasets is highly time-consuming, challenging, and expensive. Hence, human motion synthesis is a crucial research problem within deep learning and computer vision. We present a novel method for controllable human motion synthesis by applying attention-based probabilistic deep adversarial models with end-to-end training. We show that we can generate synthetic human motion over both short- and long-time horizons through the use of adversarial attention. Furthermore, we show that we can improve the classification performance of deep learning models in cases where there is inadequate real data, by supplementing existing datasets with synthetic motions.

翻译:分析人类运动是许多学科(从人类-计算机互动到娱乐、虚拟现实和保健)都感兴趣的一个核心主题。深层次的学习在实时捕捉人形方面已经取得了令人印象深刻的成果。另一方面,由于各主体之间的差异性强,人类运动分析模型往往由于在保健等领域可用的专门数据集非常有限而无法概括从无形主题获得的数据。然而,获取人类运动数据集非常耗时、富有挑战性和昂贵。因此,人类运动合成是深层次学习和计算机视野中的一个关键研究问题。我们提出了一个通过应用基于关注的深层次对抗模型进行端对端培训来控制人类运动合成的新方法。我们表明,通过使用对抗性关注,我们可以在短期和长期范围内产生合成的人类运动。此外,我们表明,在实际数据不足的情况下,我们可以改进深层学习模型的分类性能,用合成动作补充现有的数据集。