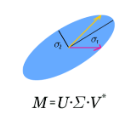

Quantum machine learning (QML) has shown great potential to produce killer applications of quantum computers by introducing the possibility of large quantum speedups for computationally intensive linear algebra tasks. The quantum singular value transformation (QSVT), introduced by Gily\'en, Su, Low and Wiebe, is a unifying framework to obtain QML algorithms. We provide a classical algorithm that matches the performance of QSVT, up to a small polynomial overhead. In particular, given a bounded matrix $A\in\mathbb{C}^{m\times n}$, a vector $b\in\mathbb{C}^{n}$, and a bounded degree-$d$ polynomial $p$, QSVT can output a measurement from the state $|p(A)b\rangle$ in $O(d\|A\|_F )$ time. We show that for any $\epsilon >0$, we can output a vector $v$ such that $\|v-p(A)b\|\le\epsilon$ in $O(d^9\|A\|_F^4/\epsilon^2)$ time after linear-time pre-processing. This improves upon the best known classical algorithm [CGL+'20], which requires $O(d^{22}\|A\|_F^6/\epsilon^6)$ time. Instantiating our algorithm with different polynomials, we obtain fast quantum-inspired algorithms for regression/matrix inversion, recommendation systems and Hamiltonian simulation. We improve upon several recent papers specialized to specific problems, including [CGL+'20,SM'21,GST'22,CCH+'22} for regression, and [Tan'19,CGL+'20,CCH+'22] for recommendation systems. Our key insight is to combine the Clenshaw recurrence, an iterative method for computing matrix polynomials, with sketching techniques to simulate QSVT classically. The tools we introduce include (a) a non-oblivious matrix sketch for approximately preserving bi-linear forms, (b) a non-oblivious asymmetric approximate matrix product sketch based on $\ell_2^2$ sampling, (c) a new stability analysis for the Clenshaw recurrence, and (d) a new technique to bound arithmetic progressions of the coefficients appearing in the Chebyshev expansion of bounded functions.

翻译:量子机器学习( QML) 展示出巨大的潜力, 通过引入在计算密集线性代数任务时使用大规模量子加速的可能性来生成量子计算机的致命应用。 由 Gily\'en、 Su、 Low 和 Wiebe 推出的量子奇值转换( QSVT) 是获取 QML 算法的统一框架 。 我们提供了一个与 QSVT 的性能匹配的经典算法, 直至一个小的多元管理。 特别是, 如果一个约束性矩阵 $A\ in\ mathb{ C\ maxxxxxxxx 美元, 一个非量级超量量量量量量量的量值超量量量量子值变换值( IML=xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx</s>