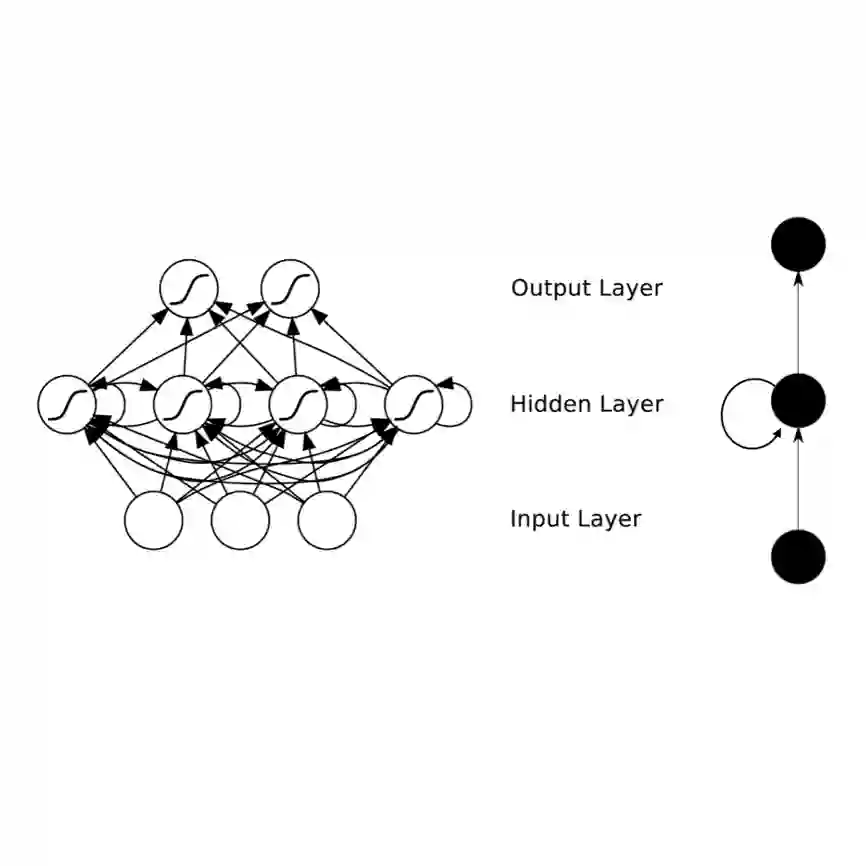

Deep neural networks are a family of computational models that are naturally suited to the analysis of hierarchical data such as, for instance, sequential data with the use of recurrent neural networks. In the other hand, ordinal regression is a well-known predictive modelling problem used in fields as diverse as psychometry to deep neural network based voice modelling. Their specificity lies in the properties of their outcome variable, typically considered as a categorical variable with natural ordering properties, typically allowing comparisons between different states ("a little" is less than "somewhat" which is itself less than "a lot", with transitivity allowed). This article investigates the application of sequence-to-sequence learning methods provided by the deep learning framework in ordinal regression, by formulating the ordinal regression problem as a sequential binary search. A method for visualizing the model's explanatory variables according to the ordinal target variable is proposed, that bears some similarities to linear discriminant analysis. The method is compared to traditional ordinal regression methods on a number of benchmark dataset, and is shown to have comparable or significantly better predictive power.

翻译:深神经网络是自然适合于分析等级数据(例如,使用经常性神经网络的顺序数据)的计算模型的组合。另一方面,正态回归是一个众所周知的预测建模问题,在诸如心理测量到深神经网络的语音建模等不同领域使用。它们的特殊性在于其结果变量的特性,通常被视为自然定序特性的绝对变量,通常允许在不同的州之间进行比较(“一小”小于“某物”,它本身比“多”少,但允许中转性)。本文章调查了由深层学习框架提供的顺序到顺序的学习方法在正态回归中的应用情况,将正态回归问题作为连续的二进制搜索。提出了一种根据正态目标变量对模型解释变量进行可视化的方法,该方法与线性对立分析有一些相似之处。该方法与一些基准数据集的传统或定态回归方法相比较,并显示其具有可比较或明显更好的预测力。