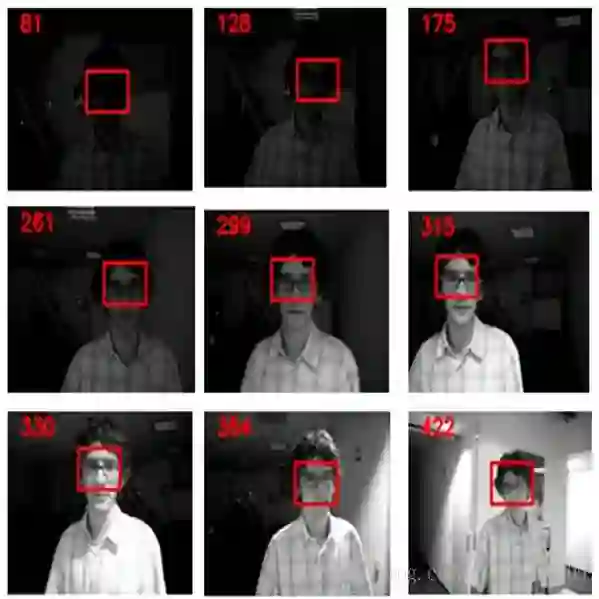

Recently, deep learning has achieved very promising results in visual object tracking. Deep neural networks in existing tracking methods require a lot of training data to learn a large number of parameters. However, training data is not sufficient for visual object tracking as annotations of a target object are only available in the first frame of a test sequence. In this paper, we propose to learn hierarchical features for visual object tracking by using tree structure based Recursive Neural Networks (RNN), which have fewer parameters than other deep neural networks, e.g. Convolutional Neural Networks (CNN). First, we learn RNN parameters to discriminate between the target object and background in the first frame of a test sequence. Tree structure over local patches of an exemplar region is randomly generated by using a bottom-up greedy search strategy. Given the learned RNN parameters, we create two dictionaries regarding target regions and corresponding local patches based on the learned hierarchical features from both top and leaf nodes of multiple random trees. In each of the subsequent frames, we conduct sparse dictionary coding on all candidates to select the best candidate as the new target location. In addition, we online update two dictionaries to handle appearance changes of target objects. Experimental results demonstrate that our feature learning algorithm can significantly improve tracking performance on benchmark datasets.

翻译:最近,深层学习在视觉物体跟踪方面取得了非常有希望的成果。在现有跟踪方法中的深神经网络需要大量培训数据来学习大量参数。然而,培训数据不足以用于视觉物体跟踪,因为目标对象的注释只在测试序列的第一个框架里提供。在本文中,我们建议通过使用基于树结构的Recursive神经网络(RNN)来学习视觉物体跟踪的等级特征,这些特征的参数比其他深神经网络(例如, Convolual Neal网络(CNN))要少。首先,我们学习了RNN参数,以便在测试序列的第一个框架里区分目标对象和背景。一个外星区域本地补丁的树木结构是随机产生的,因为使用自下而上的贪婪搜索战略。根据所学的RNNN参数,我们创建了两个目标区域词典,并根据从多个随机树的顶部和叶部结点学到的等级特征来相应的本地补丁。在随后的每个框中,我们对所有候选人进行稀有的字典调,以选择最佳候选人作为新的目标位置。此外,我们还可以对两个目标对象进行在线的轨迹跟踪,以测试。