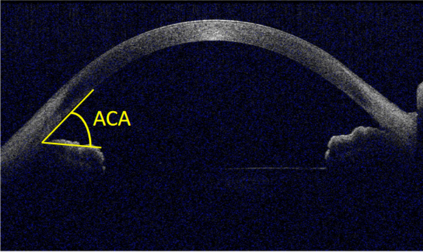

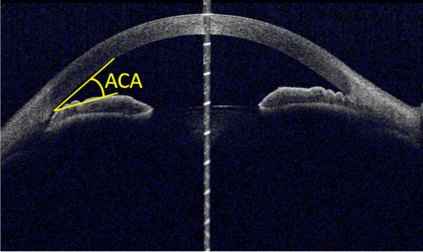

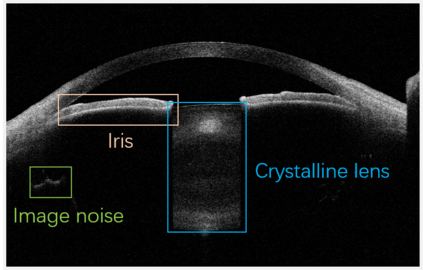

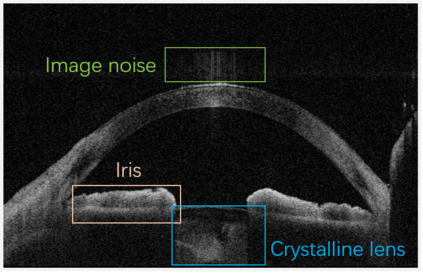

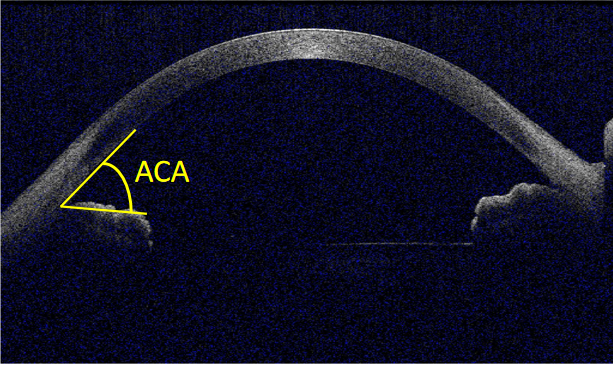

Deep learning (DL) has made significant progress in angle closure classification with anterior segment optical coherence tomography (AS-OCT) images. These AS-OCT images are often acquired by different imaging devices/conditions, which results in a vast change of underlying data distributions (called "data domains"). Moreover, due to practical labeling difficulties, some domains (e.g., devices) may not have any data labels. As a result, deep models trained on one specific domain (e.g., a specific device) are difficult to adapt to and thus may perform poorly on other domains (e.g., other devices). To address this issue, we present a multi-target domain adaptation paradigm to transfer a model trained on one labeled source domain to multiple unlabeled target domains. Specifically, we propose a novel Multi-scale Multi-target Domain Adversarial Network (M2DAN) for angle closure classification. M2DAN conducts multi-domain adversarial learning for extracting domain-invariant features and develops a multi-scale module for capturing local and global information of AS-OCT images. Based on these domain-invariant features at different scales, the deep model trained on the source domain is able to classify angle closure on multiple target domains even without any annotations in these domains. Extensive experiments on a real-world AS-OCT dataset demonstrate the effectiveness of the proposed method.

翻译:深层学习( DL) 在角闭合分类方面取得了显著进展, 侧端部分光学一致性断层成像( AS- OCT) 图像( AS- OCT) 获得了显著的进展。 这些 AS- OCT 图像往往被不同的成像装置/ 条件所获取, 导致基础数据分布( 称为“ 数据域 ” ) 发生巨大变化。 此外, 由于实际标签困难, 一些领域( 如设备) 可能没有任何数据标签 。 因此, 在一个特定领域( 例如, 一个特定装置) 的深层模型难以适应, 从而可能在其他领域( 如其他装置) 表现不佳。 为了解决这个问题, 我们提出了一个多目标域适应模式的调整模式, 将一个在标签源域上受过培训的模型转换到多个未标的域域域( ) 。 具体来说, 我们提出了一个新的多尺度多目标的多目标 Adversarial 网络( M2DAN), 为提取域内变量特性, 开发一个用于采集AS- OC 模型图像( 如其他装置) 的多级模型的多尺度模块 。 在这些域域域域内, 上, 任何经过深层域域域域域域域域内经过训练的、 的、 的、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、 级、