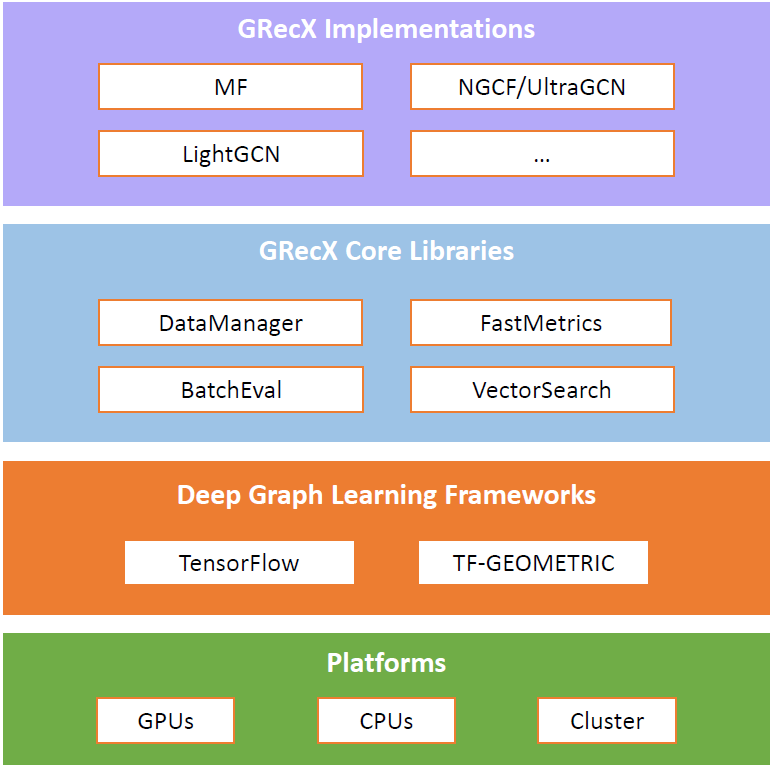

In this paper, we present GRecX, an open-source TensorFlow framework for benchmarking GNN-based recommendation models in an efficient and unified way. GRecX consists of core libraries for building GNN-based recommendation benchmarks, as well as the implementations of popular GNN-based recommendation models. The core libraries provide essential components for building efficient and unified benchmarks, including FastMetrics (efficient metrics computation libraries), VectorSearch (efficient similarity search libraries for dense vectors), BatchEval (efficient mini-batch evaluation libraries), and DataManager (unified dataset management libraries). Especially, to provide a unified benchmark for the fair comparison of different complex GNN-based recommendation models, we design a new metric GRMF-X and integrate it into the FastMetrics component. Based on a TensorFlow GNN library tf_geometric, GRecX carefully implements a variety of popular GNN-based recommendation models. We carefully implement these baseline models to reproduce the performance reported in the literature, and our implementations are usually more efficient and friendly. In conclusion, GRecX enables uses to train and benchmark GNN-based recommendation baselines in an efficient and unified way. We conduct experiments with GRecX, and the experimental results show that GRecX allows us to train and benchmark GNN-based recommendation baselines in an efficient and unified way. The source code of GRecX is available at https://github.com/maenzhier/GRecX.

翻译:在本文中,我们介绍GRecX,这是以高效和统一的方式将基于GNN的基于GNN的建议模式作为基准的开放源码的TensorForFlow框架。GNN建议基准的核心图书馆由建立基于GNN的建议基准的核心图书馆组成,以及执行基于GNN的流行建议模式。核心图书馆为建立高效和统一的基准提供了必不可少的组成部分,包括快速计量(高效计量图书馆)、VectorSearch(基于密度病媒的高效相似搜索图书馆)、BatchEval(高效的小型批量评估图书馆)和数据管理员(统一的数据集管理图书馆)。特别是为公平比较基于GNNN的各种不同复杂的基于GNN的建议模式提供一个统一基准,我们设计一个新的衡量基准矩阵MF-X,将其纳入到快计量部分。基于TensorFlow GNNNT图书馆 tf_geoormormation, GRecX仔细执行各种基于GNNE的建议模式。我们仔细应用这些基准模型,以复制文献中报告的绩效,我们的执行通常更加高效和友好。最后,GREX试验允许以GNC方式将GNC/rec用于基准和GC的测试结果,我们用一个基准和基准使用。