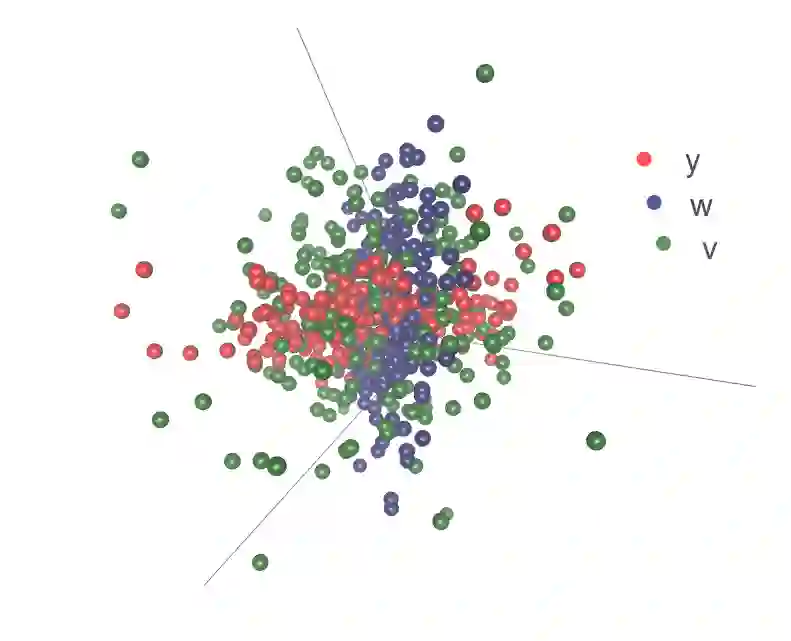

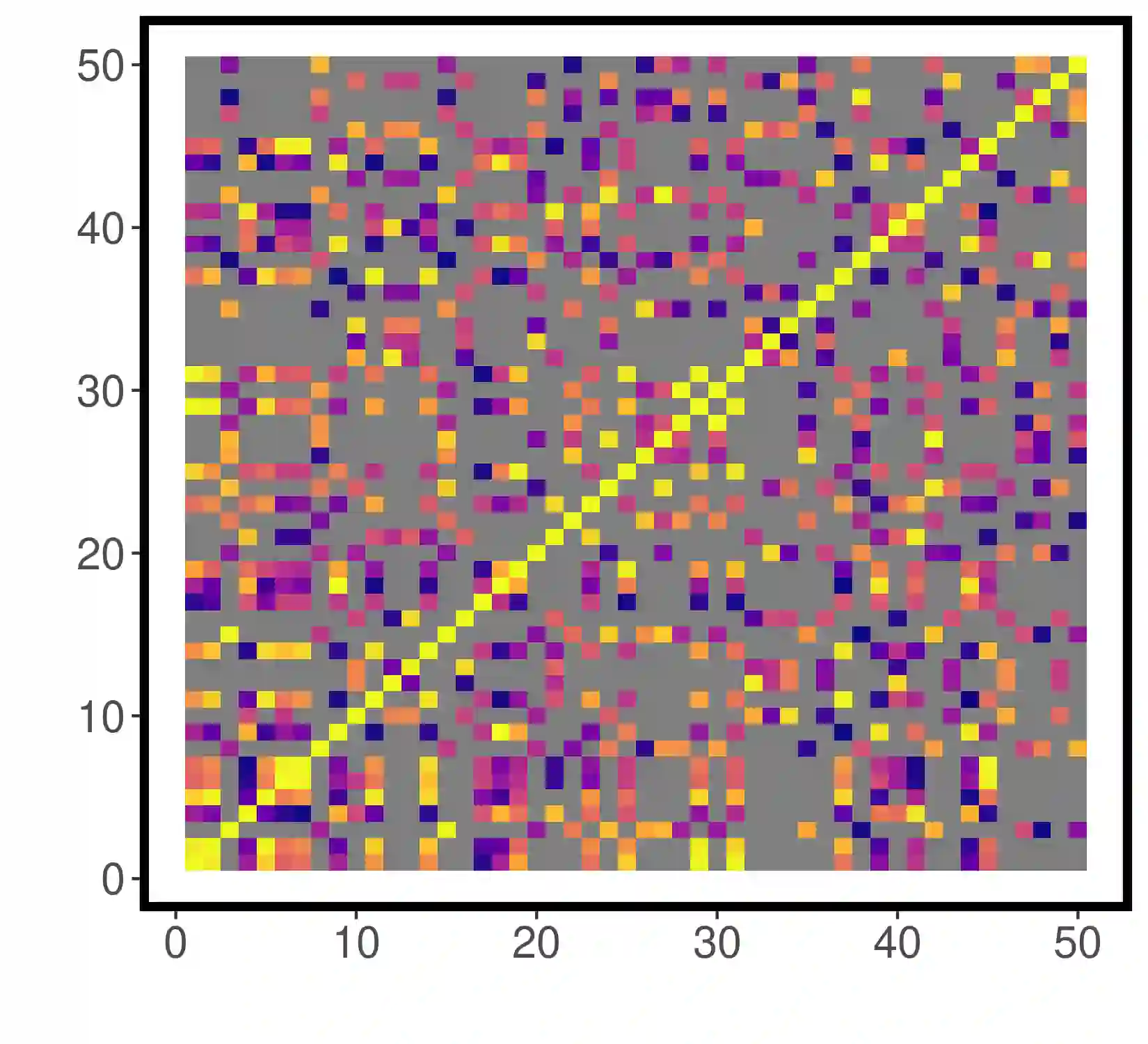

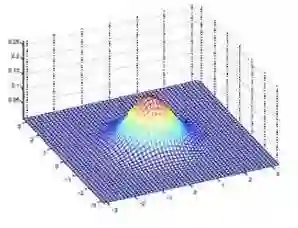

We propose a novel approach to estimating the precision matrix of multivariate Gaussian data that relies on decomposing them into a low-rank and a diagonal component. Such decompositions are very popular for modeling large covariance matrices as they admit a latent factor based representation that allows easy inference. The same is not true for precision matrices, due to the lack of computationally convenient representation, which restricts the use to low to moderate dimensional problems. We address this remarkable gap in the literature by introducing a novel latent variable representation for such decomposition for precision matrices as well. The construction leads to an efficient Gibbs sampler that scales very well to high-dimensional problems far beyond the limits of the current state-of-the-art. The ability to efficiently explore the full posterior space allows the model uncertainty to be easily assessed. The decomposition also crucially allows us to adapt sparsity inducing priors to shrink the insignificant entries of the precision matrix toward zero, making the approach adaptable to high-dimensional small-sample-size sparse settings. Exact zeros in the matrix encoding the underlying conditional independence graph are then determined via a novel posterior false discovery rate control procedure. We evaluate the method's empirical performance through synthetic experiments and illustrate its practical utility in data sets from two different application domains.

翻译:我们建议一种新颖的方法来估计多变量高斯数据的精确矩阵,该方法依靠将其分解成低位和对角部分。这种分解对于模拟大型共变矩阵非常流行,因为它们承认潜在的因子代表,容易推断。对于精确矩阵来说,情况并非如此,因为缺乏计算方便的表达方式,这限制了对低至中度的维度问题的使用。我们通过对精确矩阵的分解也引入一种新颖的潜在变量代表方式来解决文献中的这一显著差距。构造导致一个高效的Gibs采样器,该采样器的大小远远超过目前艺术状态的极限。高效探索整个远为远超过高度的远为高度的共变异矩阵,能够使模型的不确定性易于被评估。这种分解还使我们能够调整松动性,从而将精确矩阵的微小条目缩缩缩缩到零,从而将精确矩阵的偏移到高位小的稀薄环境。构建一个高效的Gibs采样器将基础性独立图表转换成高度的问题,远远超出目前状态状态的极限。有效探索整个后,通过新版的合成实用化工具测试程序将基础独立图表用于两个领域。