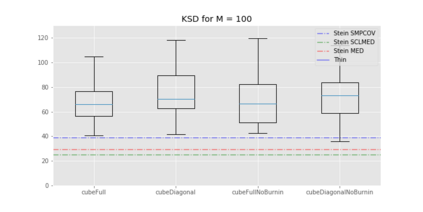

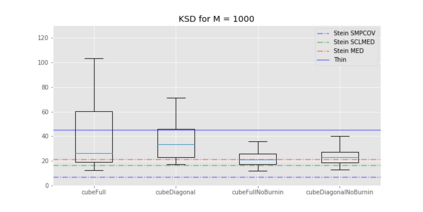

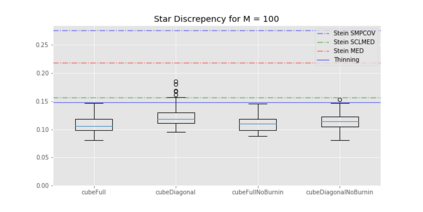

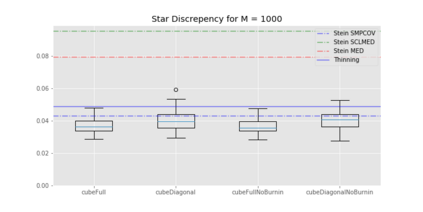

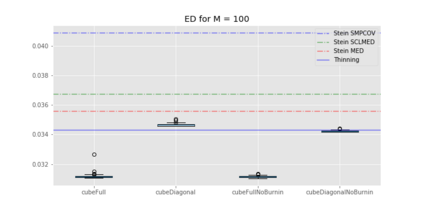

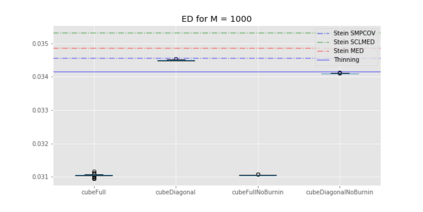

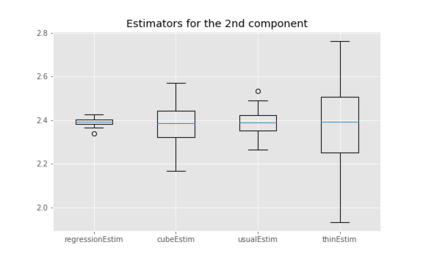

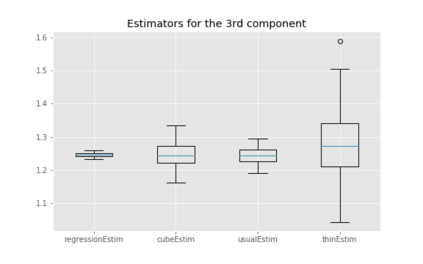

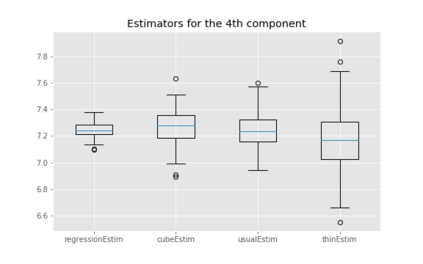

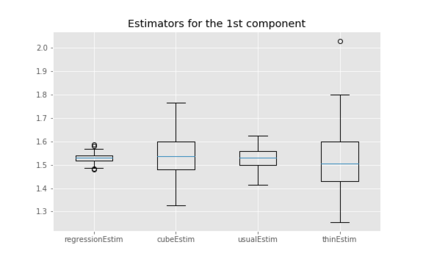

We propose cube thinning, a novel method for compressing the output of a MCMC (Markov chain Monte Carlo) algorithm when control variates are available. It amounts to resampling the initial MCMC sample (according to weights derived from control variates), while imposing equality constraints on averages of these control variates, using the cube method of [1]. Its main advantage is that its CPU cost is linear in N, the original sample size, and is constant in M, the required size for the compressed sample. This compares favourably to Stein thinning [2], which has complexity OpNM2q, and which requires the availability of the gradient of the target log-density (which automatically implies the availability of control variates). Our numerical experiments suggest that cube thinning is also competitive in terms of statistical error.

翻译:我们提出立方体稀释(立方体稀释),这是在有控制变异的情况下压缩MCMC(Markov链 Monte Carlo)算法(MMC ) 输出的新方法。它相当于对最初的MCMC样本(根据控制变异产生的重量)进行再取样,同时使用立方体法[1] 对这些控变异物的平均值实行平等限制。其主要优势在于其CPU成本在N(原样本大小)为线性,在M(压缩样本所需大小)为常数。这比Stein 稀释[2]有利,因为它具有OpNM2q的复杂性,需要目标日志密度的梯度(这自动意味着有控制变异物的可用性 ) 。 我们的数字实验表明,立方体稀释在统计错误方面也具有竞争力。