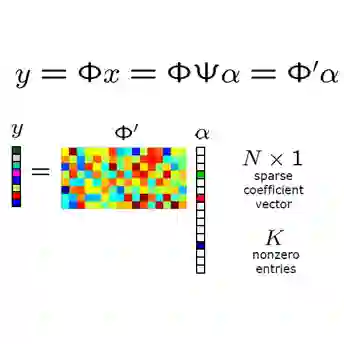

Plug-and-Play (PnP) is a non-convex optimization framework that combines proximal algorithms, for example, the alternating direction method of multipliers (ADMM), with advanced denoising priors. Over the past few years, great empirical success has been obtained by PnP algorithms, especially for the ones that integrate deep learning-based denoisers. However, a key challenge of PnP approaches is the need for manual parameter tweaking as it is essential to obtain high-quality results across the high discrepancy in imaging conditions and varying scene content. In this work, we present a class of tuning-free PnP proximal algorithms that can determine parameters such as denoising strength, termination time, and other optimization-specific parameters automatically. A core part of our approach is a policy network for automated parameter search which can be effectively learned via a mixture of model-free and model-based deep reinforcement learning strategies. We demonstrate, through rigorous numerical and visual experiments, that the learned policy can customize parameters to different settings, and is often more efficient and effective than existing handcrafted criteria. Moreover, we discuss several practical considerations of PnP denoisers, which together with our learned policy yield state-of-the-art results. This advanced performance is prevalent on both linear and nonlinear exemplar inverse imaging problems, and in particular shows promising results on compressed sensing MRI, sparse-view CT, single-photon imaging, and phase retrieval.

翻译:Plug- Play (PnP) 是一个非clug- Play (PnP) 优化框架, 将准成像量算法(例如, 倍数的交替方向法( ADMM) ) 与先进的分解前科相结合。 过去几年来, PnP 算法取得了巨大的实证成功, 特别是整合了深层学习的低层测量器。 然而, PnP 方法的一个关键挑战在于需要手工调整参数, 因为在成像条件和不同场景内容的高度差异中, 获得高质量的结果至关重要。 在这项工作中, 我们提出了一类无调制成的 PnP pnP proximal 算法, 可以自动确定诸如分解强度、 终止时间和其他优化特定参数等参数。 我们的方法的一个核心部分是自动参数搜索政策网络, 可以通过无模型和基于模型的深度强化学习战略的混合来有效学习。 我们通过严格的数字和视觉实验, 所学的政策可以将参数定制到不同的背景环境, 并且往往比现有精细的精细精细的精细的精细的精细的精细的M- prial- prial- prial- prial- prial- prial- pal- pal- ass- pal- pal- pal- pal- pal- pal- pal- pal- pres- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- lemental- pal- pal- pal- pal- pal- pal- pal- pal- la- pal- pal- la- le- le- le- la- la- le- le- le- la- lemental- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal- pal-