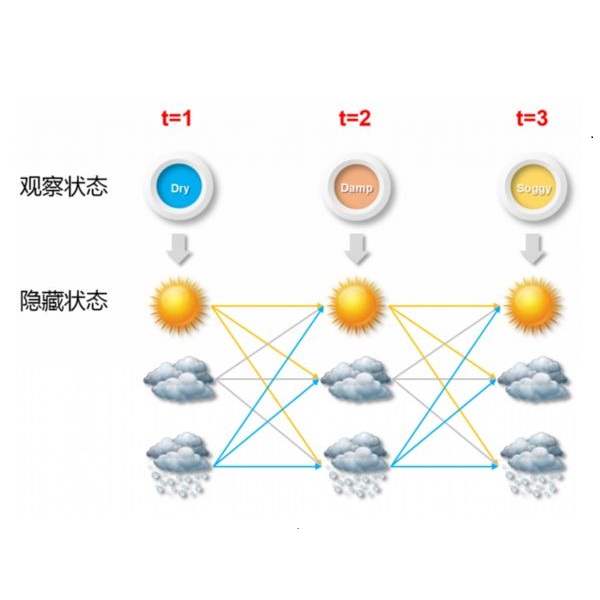

Performing model selection for coupled hidden Markov models (CHMMs) is highly challenging, owing to the large dimension of the hidden state process. Whilst in principle the hidden state process can be marginalized out via forward filtering, in practice the computational cost of doing so increases exponentially with the number of coupled Markov chains, making this approach infeasible in most applications. Monte Carlo methods can be utilized, but despite many remarkable developments in model selection methodology, generic approaches continue to be ill-suited for such high-dimensional problems. Here we develop specialized solutions for CHMMs with weak inter-chain dependencies. Specifically we construct effective proposal distributions for the hidden state process that remain computationally viable as the number of chains increases, and that require little user input or tuning. This methodology is particularly applicable to individual-level infectious disease models characterized as CHMMs, in which each chain represents an individual, and the coupling represents contact between individuals. Since the only significant contacts are between susceptible and infectious individuals, and since multiple infection pathways are often possible, the resulting CHMMs naturally have low inter-chain dependencies. We demonstrate the utility of our methodology with an application to a study of highly pathogenic avian influenza in chickens.

翻译:由于隐蔽的隐蔽马可夫模型(CHMMs)的庞大层面,执行模型选择极具挑战性,因为隐藏的隐蔽国家进程具有很大层面的隐蔽国家进程。虽然原则上,隐藏的国家进程可以通过前方过滤法被排挤出去,但实际上,随着混合的Markov链条数量的增加,这样做的计算成本会成倍增长,使这种方法在大多数应用中不可行。可以使用蒙特卡洛方法,尽管在模式选择方法方面有许多显著的发展,但通用方法仍然不适合于这种高层面的问题。我们在这里为具有薄弱链际依赖性的CHMMs制定了专门的解决办法。具体地说,我们为隐藏的状态进程制定了有效的建议分配,随着链条数量的增加,在计算上仍然可行,而且需要很少用户投入或调整。这一方法特别适用于个人层面的传染性疾病模式,即每个链条代表个人,而组合代表个人之间的接触。由于只有易受感染和传染性个人之间的重要接触,而且由于多重感染途径是可能的,因此由此产生的CHMMMMMs自然具有较低的链际依赖性。我们的方法在高度上展示了一种高性。我们的方法在研究中具有很高的病性。