题目: Attention in Natural Language Processing

摘要:

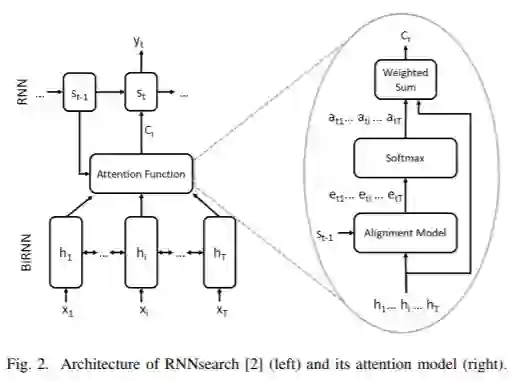

注意力是一种越来越受欢迎的机制,在广泛的神经结构中使用。该机制本身以各种格式实现。然而,由于这一领域的快速发展,仍然缺乏对注意力的系统概述。在本文中,我们为自然语言处理中的注意力架构定义了一个统一的模型,重点是那些设计用来处理文本数据的向量表示的模型。根据四个维度提出了注意力模型的分类:输入的表示、兼容性函数、分布函数和输入和输出的多样性。然后展示了如何在注意力模型中利用先验信息的例子,并讨论了该领域正在进行的研究工作和面临的挑战。

成为VIP会员查看完整内容

相关内容

专知会员服务

140+阅读 · 2020年7月10日

Arxiv

21+阅读 · 2019年2月4日