【泡泡点云时空】GPSfM:基于多视图基本矩阵的具有代数约束的全局投影SFM

泡泡点云时空,带你精读点云领域顶级会议文章

标题:GPSfM: Global Projective SFM Using Algebraic Constraints on Multi-View Fundamental Matrices

作者:Yoni Kasten* Amnon Geifman* Meirav Galun Ronen Basri Weizmann Institute of Science

来源:arxiv 2018

编译:周志

审核:徐二帅,吕佳俊

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

本文提出了从多视图设置下的基本矩阵集合中恢复投影相机矩阵的问题。本文主要有两个贡献。首先,给定由n幅图像计算的(n,2)基本矩阵,我们提供了一个完整的代数表征形式,其是恢复相机矩阵的充分必要条件。这些条件是基于将基本矩阵作为块排列在一个称为n视图基本矩阵的单个矩阵中,并根据其特征值的符号和秩结构来描述这个矩阵。其次,我们提出了一种在射影运动恢复结构中使用的具体算法。给定一个完整的或部分的测量基本矩阵集合,我们的方法寻找相机矩阵,使测量的基本矩阵的全局代数误差最小化。与现有方法相比,所提方法不需要任何初始化,我们的优化产生了一组对应相机(取决于射影帧的选择)位置的基本矩阵。实验结果表明,该方法在精度和运行时间上均达到最先进水平。

主要算法

算法中的具体公式及理论推导可参见原论文。

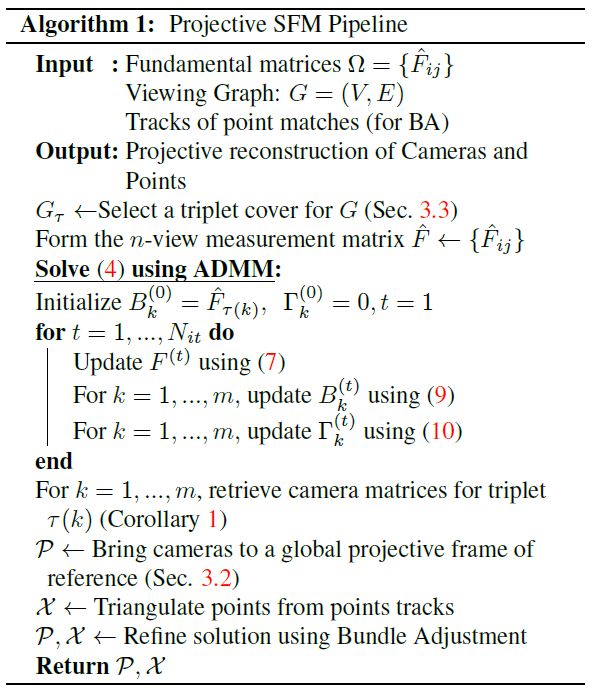

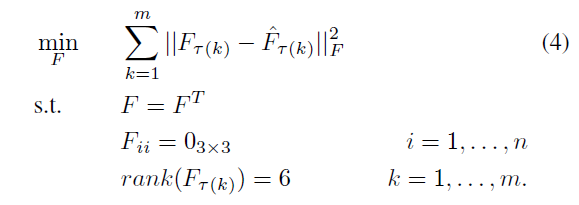

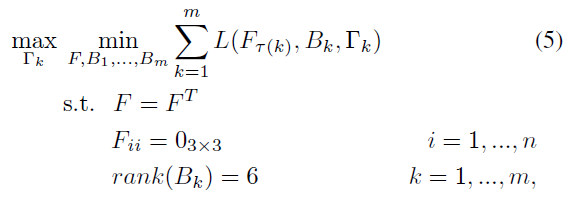

其核心算法是优化基本矩阵,即求估计的基本矩阵和测量的基本矩阵之差的累加最小值。见公式(4),其中估计的基本矩阵具有秩约束。本文采用ADMM方法求解公式(4)。为解此问题需要构造9×9辅助矩阵变量,即求解公式(5)。

该过程循环更新迭代F、B、Γ 。待求得F矩阵后,根据F矩阵恢复全局三维。

实验

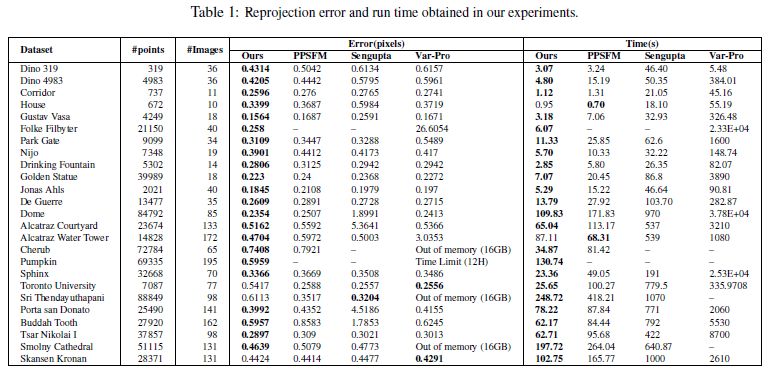

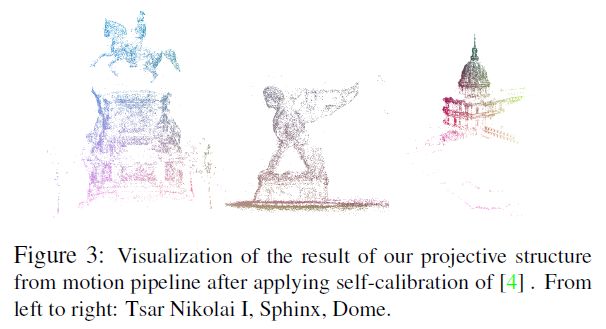

表1是与P2SfM, VarPro和Sengupta et.al等相比,我们的方法获得的所有场景点的平均重投影误差(以像素为单位)和总运行时间(以秒为单位)。可以看出,我们的方法在25个测试数据集中的22个中取得了比所有其他方法更高的精度。此外,对于某些复杂的场景结构,我们的方法成功地重建了场景,而其他所有方法都未能获得重建(我们尝试了许多不同的超参数)。在几乎所有的情况下,我们的方法也更快,在25个数据集中的22个数据集中缩短了运行时间。相比于我们的方法,最佳比较方法(分别针对每个数据集)的重投影误差的中位数差4.8%,运行时间的中位数则需要额外的74%。我们重建的质量也可以通过图3所示的恢复的三维点云来查看。

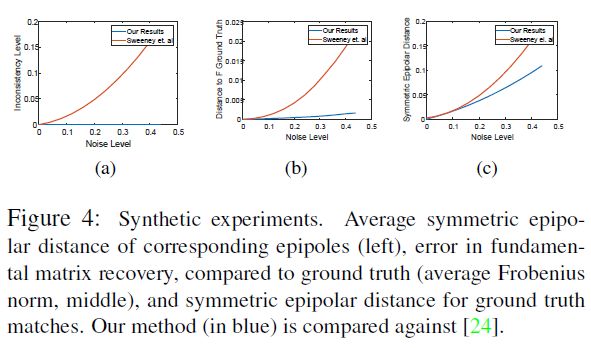

由于我们的优化只执行定理1中一致性约束的一个子集,我们接下来在合成实验中测试恢复的基本矩阵(无BA)的一致性。我们生成了10个相机矩阵和15000个三维点。然后我们投影这些点,并用高斯噪声扰动它们。最后,我们随机选择了15个匹配的三元组,并用它们来计算基本矩阵。由图4可以看出,我们的方法在所有错误级别下都保持一致性,同时实现了基本矩阵相对于真实数据的高质量恢复。

Abstract

This paper addresses the problem of recovering projective camera matrices from collections of fundamental matrices in multiview settings. We make two main contributions. First, given (n,2) fundamental matrices computed for n images, we provide a complete algebraic characterization in the form of conditions that are both necessary and sufficient to enabling the recovery of camera matrices. These conditions are based on arranging the fundamental matrices as blocks in a single matrix, called the n-view fundamental matrix, and characterizing this matrix in terms of the signs of its eigenvalues and rank structures. Secondly, we propose a concrete algorithm for projective structure-from motion that utilizes this characterization. Given a complete or partial collection of measured fundamental matrices, our method seeks camera matrices that minimize a global algebraic error for the measured fundamental matrices. In contrast to existing methods, our optimization, without any initialization, produces a consistent set of fundamental matrices that corresponds to a unique set of cameras (up to a choice of projective frame). Our experiments indicate that our method achieves state of the art performance in both accuracy and running time.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com