【泡泡点云时空】跟踪与三角测量中一种通过兴趣点网络进行多视图2D/3D刚性配准的方法

泡泡点云时空,带你精读点云领域顶级会议文章

标题:Multiview 2D/3D Rigid Registration via a Point-Of-Interest Network for Tracking and Triangulation

作者:Haofu Liao*, Wei-An Lin*, Jiarui Zhang, Jingdan Zhang, Jiebo Luo, S. Kevin Zhou

来源:arxiv 2019

编译:邹正

审核:徐二帅

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

作者利用兴趣点网络提出了一种处理多视图二维/三维刚性配准的方法(POINT2),该方法能有效的应用于跟踪和三角测量中。POINT2通过跟踪一组兴趣点(POI),在干预前和干预内的图像之间建立一种二维的点对点对应关系。干预前三维位姿是通过三角测量层计算出来的。在POINT2中,由于POI跟踪器的框架是统一的,并且利用了三角测量层,这使得学习信息丰富的二维特征和计算三维姿态信息成为可能。在和现有方法的比较中,POINT2只需要一个单一的前传信息,就能够获得一个可靠的二维/三维配准。由于POI跟踪器具有平移不变性,POINT2对于初始化三维预干预图像的位姿效果更加健壮。通过更多的实验表明,本文提出的方法在准确性、健壮性和运行时间方面都比现有的基于学习的方法效果要好。此外,当进行初始位姿估计时,本文的方法还比最先进的基于优化的方法,在稳健性和速度方面要高十倍。

主要贡献

本文的主要贡献:

1.提出了一种新颖的基于学习的多视图二维/三维刚性配准方法,该方法在X射线和DRR之间寻找点与点之间的对应关系,使得配准的速度更快,配准结果更加稳健;

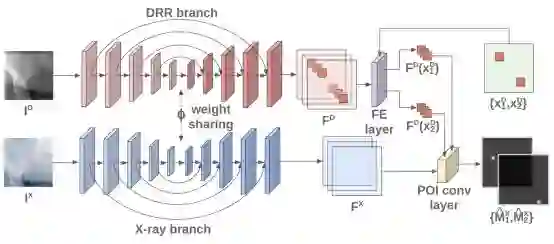

2.提出了一种新的POI跟踪网络,它是通过带有POI卷积的连体U网构建的。这种跟踪网络能够实现精细化的特征提取和有效的POI相似性度量,更重要的是它提供了一个旋转不变性的2维错位测量;

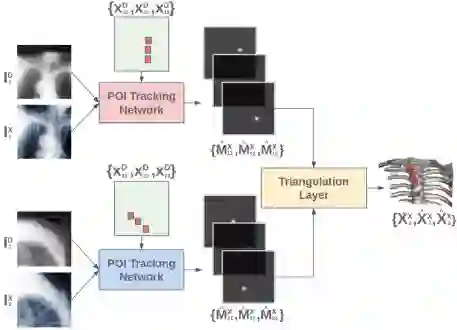

3.提出了一种POI跟踪器和三角测量图层的统一框架,它使得二维特征的端到端学习成为可能,还能够进行3维姿态的估计;

4.通过对大量的数据集进行实验表明,所提出的方法比最先进的基于学习的方法表现得更好。并且,当用作初始位姿估计器时,它的稳健性和速度比最先进得基于优化的方法提高了许多。

网络架构

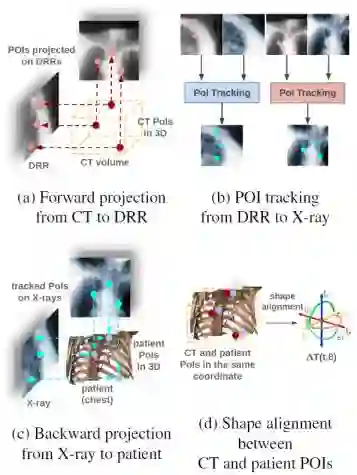

图1 POINT2方法的概述,为了更好地进行可视化,我们将不同的色彩映射应用于DRR和X射线图像并调整其对比度。

图2 POINT网络的架构

图3 POINT2的整体框架

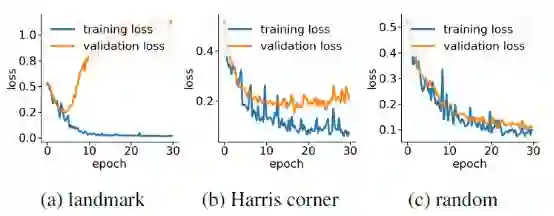

图4 不同POI选择方法的训练和验证损失

实验结果

图5 POI的跟踪结果。(a)X射线图像;(b-d)具有不同平面内偏移DRR图像;跟踪结果的热图都与X射线图像对齐并且看起来相似,显示了移位不变特性

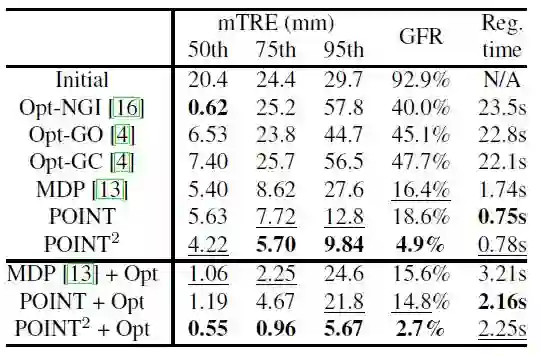

表1.与其它配准方法性能的比较,包括二维/三维的配准结果

Abstract

We propose to tackle the multiview 2D/3D rigid registration problem via a Point-Of-Interest Network for Tracking and Triangulation (POINT2). POINT2learns to establish 2D point-to-point correspondences between the preand intra-intervention images by tracking a set of pointof-interests (POIs). The 3D pose of the pre-interventionvolume is then estimated through a triangulation layer. InPOINT2, the unified framework of the POI tracker and thetriangulation layer enables learning informative 2D features and estimating 3D pose jointly. In contrast to existingapproaches, POINT2 only requires a single forward-pass toachieve a reliable 2D/3D registration. As the POI trackeris shift-invariant, POINT2is more robust to the initial poseof the 3D pre-intervention image. Extensive experimentson a large-scale clinical cone-beam computed tomographydataset show that the proposed POINT2 method outperforms the existing learning-based method in terms of accuracy, robustness and running time. Furthermore, when usedas an initial pose estimator, our method also improves therobustness and speed of the state-of-the-art optimizationbased approaches by ten folds.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com