【泡泡图灵智库】利用激光高度计修正单目视觉里程计尺度问题(IROS)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:Scale Correct Monocular Visual Odometry Using a LiDAR Altimeter

作者:Riccardo Giubilato, Sebastiano Chiodini, Marco Pertile, Stefano Debei

来源:IROS 2018

编译:杨健博

审核:尹双双

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——利用激光高度计修正单目视觉里程计尺度问题,该文章发表于IROS 2018。

单目视觉中的尺度不确定性一直以来都是一个影响多源数据融合的重要问题。而无论是二维还是三维的激光雷达或是深度相机,为了保证一定测量精度,受限于小型载体设备都会带来很大的计算负载和设备功耗需求。本文基于一个单目视觉里程计框架融合了激光测高计来恢复和保持一个正确的测量尺度。文章提出的视觉里程计方法基于关键帧进行光流追踪和建图,激光测高计数据作为关键帧到关键帧之间误差的约束。后端优化基于iSAM2,来进行轨迹和地图的修正,在不使用闭环的情况下消除尺度漂移。文章方法的精度和一些最新的立体视觉以及深度相机的方法近似。

主要贡献

1. 提出了利用激光高度计来对单目视觉中的尺度不确定性进行修正。

算法流程

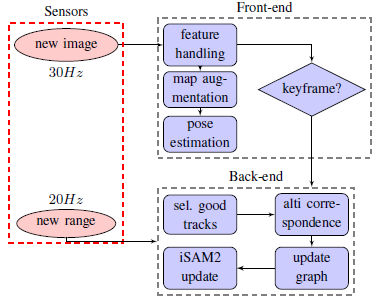

图1.算法流程图

前端:

1. 初始化采用单应矩阵或基础矩阵

2. 提取FAST特征点并在特征点周围利用光流追踪

3. 根据文章设立的多项准则选取关键帧

4. 在视差足够的情况下使用特征点进行三角化得到三维点

5. 姿态解算使用三维到二维的对应点,解算非线性最小二乘问题得到结果

后端:

1. 高度计数据联合

每次有关键帧插入的时候,最近一帧的LiDAR高度计测量值会被存储下来。测量值通过之检校得到的变换矩阵投影在影像平面之后,满足投影点到影像特征点的距离小于阈值的值会用来作为深度约束。在所有的候选地标点深度的标准差小于一个阈值的时候建立数据联合。

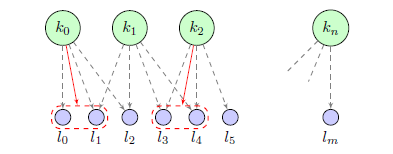

图2. 单目SLAM问题联合高度计测量数据的factor graph。绿色和蓝色的节点是关键帧和地标姿态。灰色虚线是每一个位姿可以观测到的地表点,红色实线代表了距离测量值。红色虚线包围的是高度计测量值最邻近的地标节点。

2. 后端优化

并没有使用g2o和Ceres解算器,利用iSAM2进行factor graph的优化。

主要结果

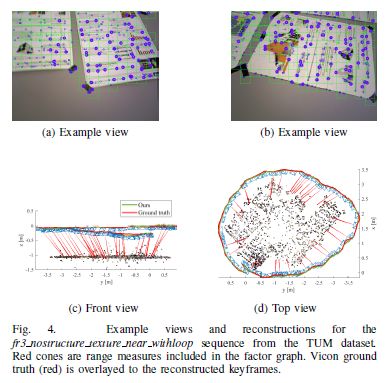

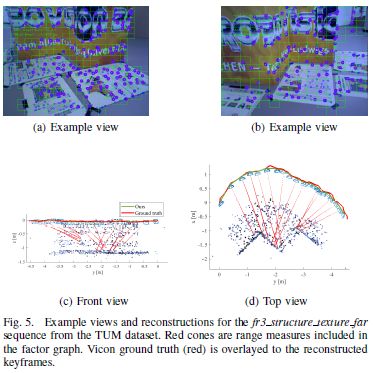

图3. TUM数据集测试结果1

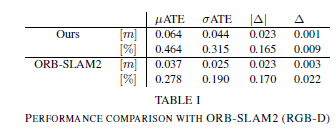

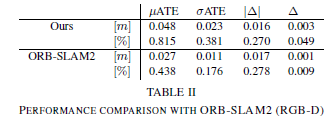

表1.TUM数据集文章方法与ORB-SLAM2效果比较1

图4.TUM数据集测试结果2

表2.TUM数据集文章方法与ORB-SLAM2效果比较2。

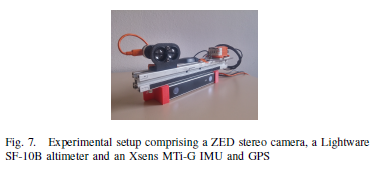

图5.文章使用的数据采集设备,立体相机,激光高度计,IMU和GPS

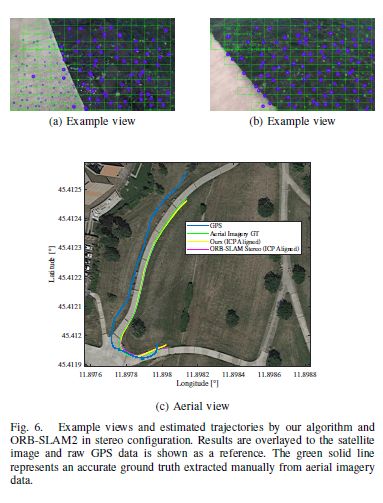

图6.示例数据和文章方法及ORB-SLAM2方法得到的轨迹对比。结果置于一张卫星影像上,原始GPS数据作为参照。绿色实线代表精确的ground truth。

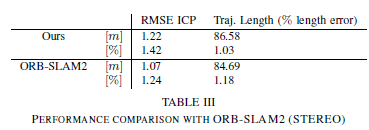

表3.文章方法与ORB-SLAM2的效果比较

Abstract

The inherent scale ambiguity in monocular vision is a well known issue that forces the integration of other sensory sources to obtain metric references. However, 2D or 3D LiDARs and RGB-D sensors, while guaranteeing metrological accuracy, impose a non negligible burden both in terms of computational load and power requirements limiting the feasibility of being implemented on small exploration vehicles. This paper presents a scale aware monocular Visual Odometry framework that fuses range data from a laser altimeter in order to recover and maintain a correct metric scale. The proposed Visual Odometry method consists of a keyframe based tracking and mapping algorithm using optical flow where range data serves as a scale constraint on a keyframe to keyframe basis. An optimization backend based on iSAM2 is employed in order to refine the trajectory and map estimates eliminating the scale drift without the need of performing loop closures. We demonstrate that our algorithm can obtain very similar performances to state of the art stereo visual SLAM and RGB-D methods.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com