【INDEMIND推广】视觉算法新引擎,INDEMIND双目视觉惯性模组再添新动力

INDEMIND双目视觉惯性模组自发布至今,受到了诸多学生、开发者及企业用户的关注与支持,已在视觉SLAM、机器人导航定位、穿戴计算、行人追踪等多个领域落地应用。为了回馈新老用户的信赖与关注,我们不仅近期做了重大更新及升级,而且即日起至6月30日,INDEMIND双目视觉惯性模组限时特惠200元,799元诚意钜惠助力新老用户视觉算法研究。

丨”视觉+IMU”融合架构,提供精准稳定数据源

作为INDEMIND旗下首款面向计算机视觉开发的产品,双目视觉惯性模组采用了视觉+IMU融合架构,搭载了两枚分辨率1280*800摄像头及最高频率1000Hz IMU传感器,视场角D:140° H:120° V:75°,帧率最高支持200 FPS,摄像头及IMU间可实现微秒级数据同步,削弱不同传感器间数据误差,支持640*400分辨率的深度输出,可为三维重建,视觉导航定位、机器智能避障等应用研发提供精准稳定的图像及IMU数据支持。

在图像方面,高分辨率摄像头结合自动曝光、全局快门、自动白平衡等算法,有效提高了系统适应性,实现在室内外不同光照条件下还原现场细节,进而为后期视觉算法处理提供稳定可靠的图像数据,具体样张如下:

室外强光环境样张

室外强光环境,双目惯性模组曝光精准,高光处黑色轿车及广告牌轮廓清晰;暗部细节保留明显,基本无噪点(详见上图左上角),并且窨井盖周围的杂草处保留了更多细节,边缘清晰。

室内高强光暗对比样张

高强光对比度室内环境,虽然窗口阳光直射的高光造成了曝光过度,但清晰拍摄了室内全部物体,且未出现物体模糊、牺牲细节的情况(详见图中画圈部分)。

在IMU数据上,INDEMIND双目视觉惯性模组搭载的高精度高频率6轴IMU传感器利用视觉与惯性传感器互补性,为载体提供精准姿态信息的同时,还为相关视觉算法提供了数据矫正,提高了系统整体鲁棒,可有效辅助开发者降低相关算法研发周期。

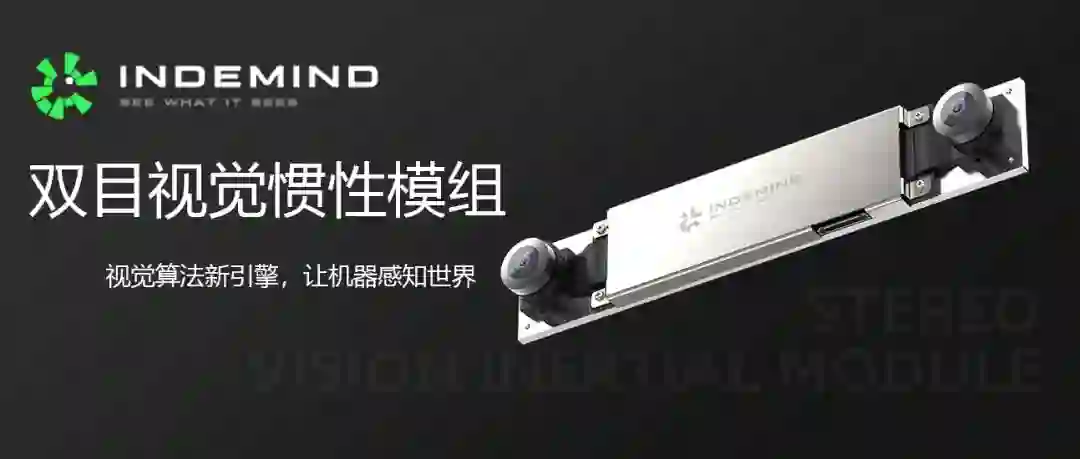

众所周知,IMU传感器属于高精度传感器,在双目视觉惯性模组中,IMU传感器易受装配、时间同步等影响,形成累计误差,影响结果精度。为了解决这一问题,INDEMIND对双目视觉惯性模组摄像头内参及外参、IMU传感器零偏、比例因子、正交误差和温度系统等参数进行了高精度标定及补偿,标定结果如下:

INDEMIND标定与KALIBR标定结果对比

INDEMIND双目惯性模组采用的标定方法是其自行设计的,与开源Kalibr标定相比,相机与IMU间的安装角误差重复性精度提升1.5倍,相机重投影误差降低0.04个像素(平均值)。

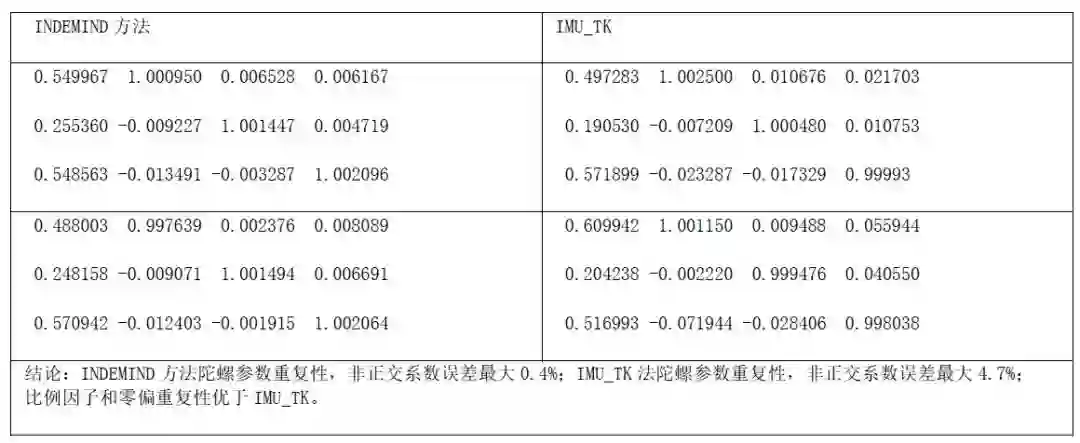

陀螺仪参数重复性对比

参数重复性对比

与IMU_TK对比,INDEMIND标定的加速度计和陀螺仪在零偏、比例因子及正交误差参数方面均有明显提升,通过加速度计参数重复性,加速度计静态测量结果与重力绝对偏差,陀螺参数重复性、静态陀螺零偏偏差、动态陀螺旋转位置角度等方面验证了标定结果均优于IMU tk方法。

综上,INDEMIND双目视觉惯性模组得益于“视觉+IMU”多传感器融合架构,可提供精准稳定的环境图像与IMU数据,有效支持视觉SLAM、机器人导航避障、穿戴计算空间定位等计算机视觉技术领域的算法开发、测试,降低研发应用周期,节省开发成本。

丨新增200帧高速信息采集,满足高速场景需求

INDEMIND双目视觉惯性模组是目前业内首款支持200FPS高速图像获取的双目惯性相机。总所周知,单位时间内的帧率越高,则其拍摄内容便更具连续性,而INDEMIND双目视觉惯性模组可以200帧/秒、0.005秒/帧的速度快速采集环境图像。为自动驾驶视觉智能分析、高速机动机器人的紧急避障应用提供间隔更短、更精细的载体位姿、分析效果。

除此之外,200帧高速数据采集也意味着双目惯性相机采集能力的巨大提升,单位时间内可采集几倍于常规传感器的数据,为环境感知、三维识别、深度解算、三维建图等应用提供更高、更丰富的图像数据支持,辅助开发者实现诸如快速紧急避障、高速导航定位等功能。

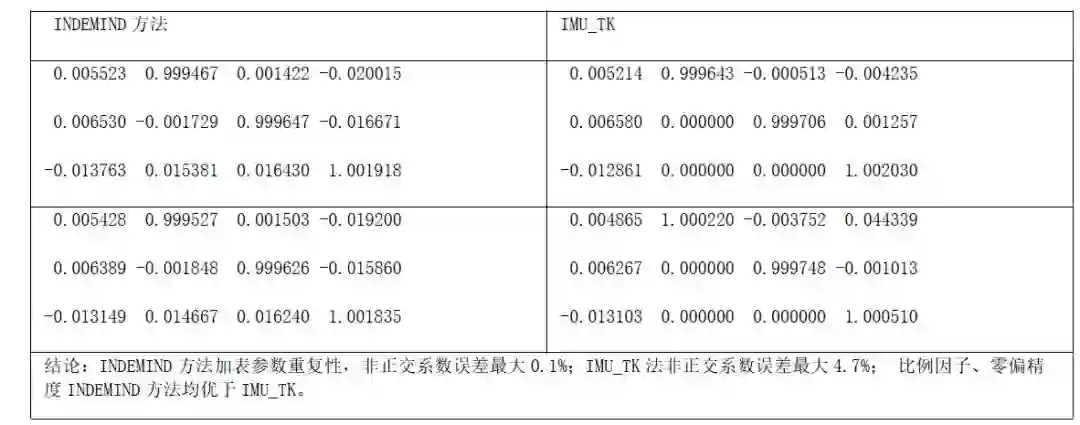

丨SDK功能完备,易上手,开发性强

入门开发者在面对不同类型、厂家的双目惯性相机时,过于复杂或完全需要自行编译的执行流程让人望而却步。针对这一问题,INDEMIND为双目惯性模组开发了支持Window、Linux的SDK。

SDK内置了高精度Vi-SLAM算法,可精准实现定位精度<1%,绝对姿态精度<1°的导航定位效果,且支持快速移动,可满足多数设备的导航定位需求。即使对SLAM不了解的开发者也可将SDK中内置的Vi-SLAM算法编译后应用到研发项目中,并在此过程中逐步培养计算机视觉算法研发能力及编译能力。

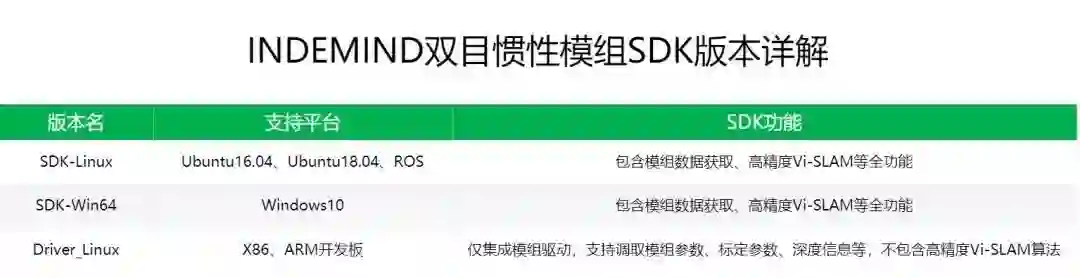

除了自研Vi-SLAM算法外,SDK还对模组的各个接口、数据回调函数做了详实的注释,确保开发者可尽快上手双目视觉惯性模组并根据SDK标注的接口、注册函数拿到自己需要的数据,加速项目的研发进程。

另外,双目视觉惯性模组还可无缝支持如ORB-SLAM2、VINS-Mono、DSO等开源算法,并且微信公众(公众号:INDEMIND)常分享一些关于开源算法的执行、解析或CV峰会论文解析,适合入门开发者学习借鉴。

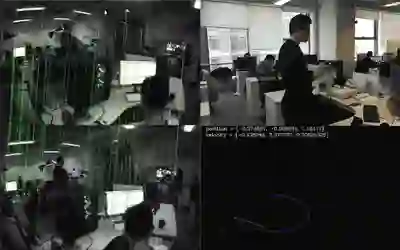

以下是双目视觉惯性模组的Demo:

ORB-SLAM2:

VINS:

丨软硬件分击合流,扩展适用性

总的来看,INDEMIND双目视觉惯性模组具备不俗的环境数据采集能力及功能完善的 SDK。在应用方面,其不仅可单独作为数据采集硬件,提供精准稳定的数据支持,辅助视觉SLAM、导航避障等算法开发,还可结合内置高精度Vi-SLAM算法充当导航定位模块,直接参与如扫地机器人、服务机器人、穿戴计算等设备的产品搭建工作,加速产品部署落地进程。

丨售价亲民,值得入手

INDEMIND双目视觉惯性模组前端获取精度高并支持分辨率及帧率调节,可适用多场景前端数据获取,为算法开发、研究提供坚实的数据基础;内置的SLAM算法精度高、系统鲁棒性强,可用于机器人、穿戴计算等设备的产品搭建,并且INDEMIND为双目惯性模组提供了完备的SDK及注释,对开发者而言,售价999元(限时特惠799元)的INDEMIND双目视觉惯性模组是一款十分值得入手的双目惯性相机产品。

PS:截至6月30日,双目惯性模组降价200元,关注INDEMIND微信公众号,添加微信助手还可额外获得可叠加的100元优惠券,到手价699元,好物好价,复制¥slqjY43qVxD¥打开淘宝了解详情。

【免责声明】本文仅代表推广公司立场,与泡泡机器人立场无关。