论文浅尝 | GEOM-GCN: Geometric Graph Convolutional Networks

论文笔记整理:毕祯,浙江大学硕士,研究方向:知识图谱、自然语言处理。

动机

消息传递神经网络(MPNN)已成功应用于现实世界中的各种应用中。但是MPNN聚合器的两个基本弱点限制了它们表示图结构数据的能力:丢失了邻域中节点的结构信息,并且缺乏捕获散布图中的长期依赖关系的能力。很少有研究从不同角度注意到这些缺点。从对经典神经网络和网络几何的观察中,该文章提出了一种新颖的图神经网络几何聚合方案,以克服这两个弱点。背后的基本思想是,图上的聚合过程可以受益于图背后的连续空间,从而达到很好的实验效果。

概念及模型

邻居结点概念的重新定义

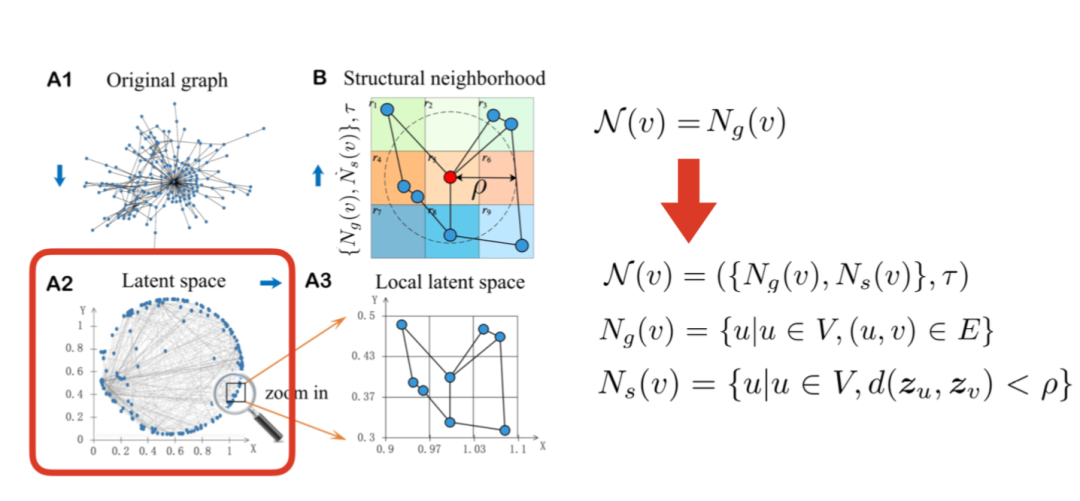

Graph level和Node level是两种层面上的邻居结点。Graph level指的是原始拓扑图上的空间,即图1中的original graph。这一层面的邻居结点指的是一个结点直接相连的结点集合。Node level指的是node embedding层面上,即先对图做一次node embedding的预处理,那么每个结点都会有对应的连续向量空间,在该空间找离该结点距离(如欧式距离)比较近的结点的集合当作邻居结点。

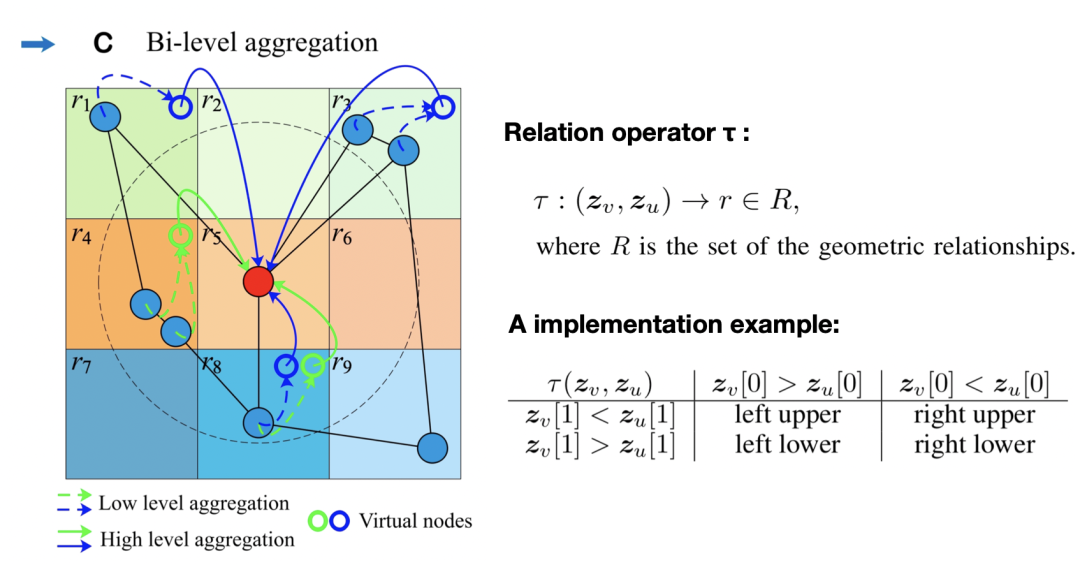

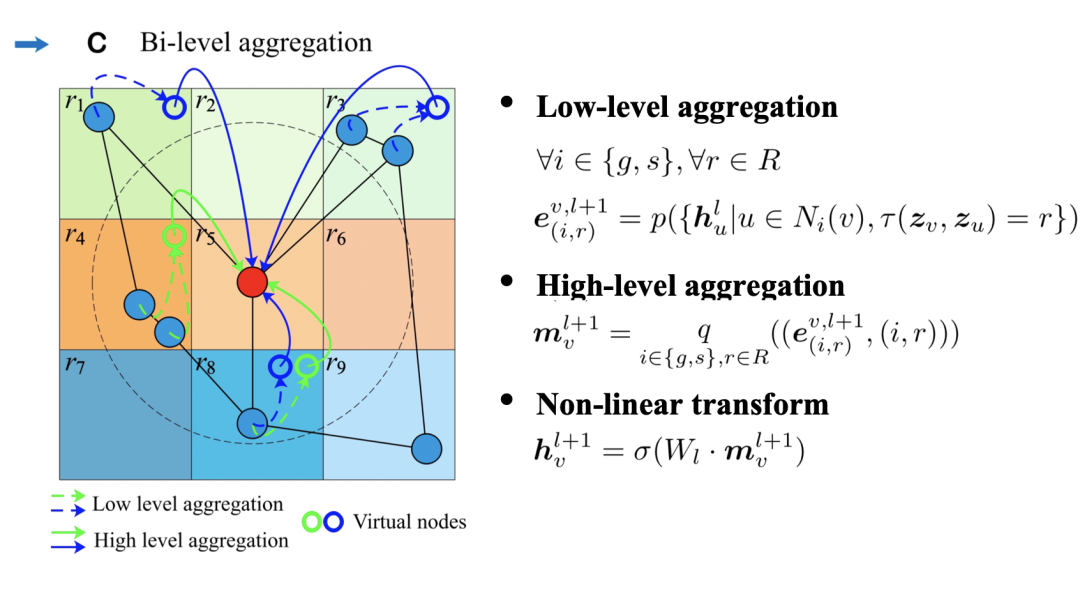

定义关系运算符 以及Aggregation。

关系运算符 的作用是对基于当前结点对其邻居结点进行几何空间的划分,这也是本文思想的最关键部分,如图2是将二维空间划分成了9个区域。这样划分的目的是对不同区域的结点的处理分而治之,如图3设计的Low-level aggregation,根据关系区域r以及邻居结点的种类分块聚集信息,在High-level aggregation中再做一次整合,最终得到所有邻居结点的信息。这样做的目的在于对不同的邻居结点会有区分,避免了GCN设计中的缺陷。

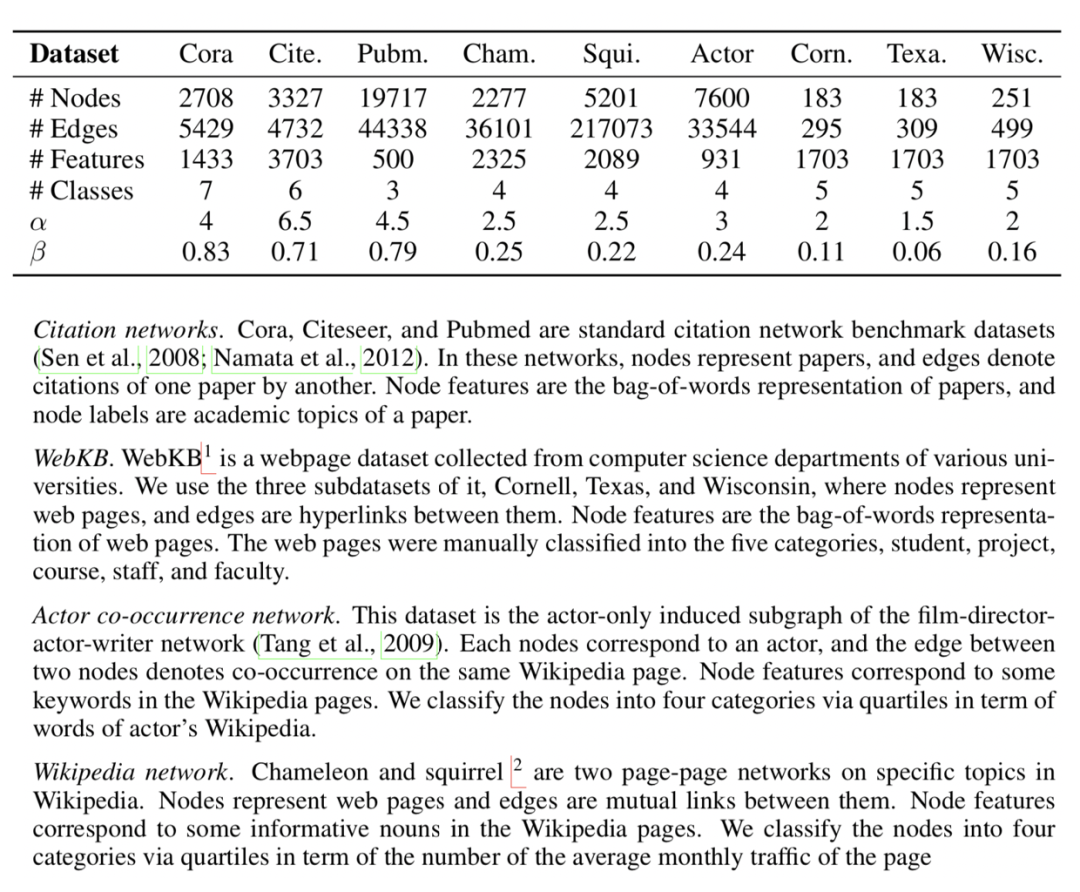

数据集准备

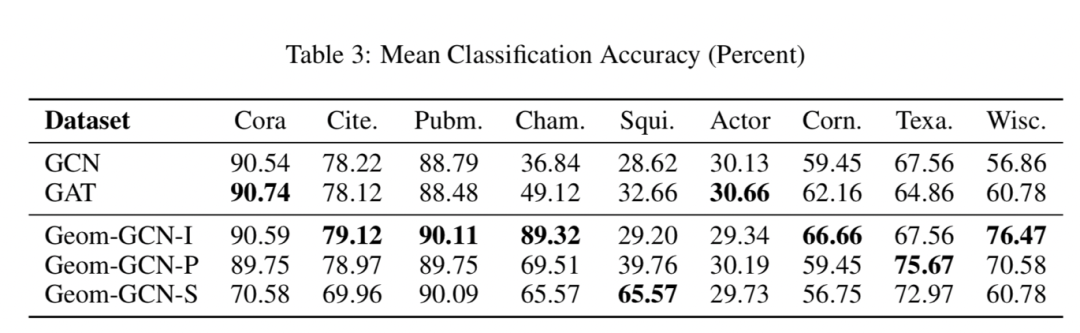

在实验的初始阶段,作者使用了Geom-GCN-I、Geom-GCN-P、Geom-GCN-S三种初始的node embedding方法,分别更关注于低维性、空间层次性、局部结构性三个特点。在数据集的准备方面,使用了四种类型一共九个数据集,不同数据集在图结构上有不同的层次性,同质性也不同。

实验结果及分析

实验结果中的数字表示平均分类准确性,以百分比表示。Geom-GCN实现了最先进的性能。从结果来看,仅保留图形连接模式的Isomap嵌入(Geom-GCN-I)已经说明设计聚合器是有用的,在大部分数据集上都提升了效果。其实可以指定一种嵌入方法,以为特定应用创建合适的潜在空间(例如分解图或层次图),从而显着提高性能(比如说Geom-GCN-S、Geom-GCN-P可能适用于这两种类型的图)。

实验结果

本文解决了图上现有的消息传递神经网络的两个主要缺点,即判别结构的丢失和长距离依赖关系无法捕捉。它通过图形嵌入将离散图形变换到到连续的几何空间。即利用卷积的原理:在有意义的空间上进行空间聚合,因此该方法从图形中提取或“恢复”了嵌入空间中丢失的信息(判别结构和远距离依存关系)。它提出了一种通用的几何聚合方案,并用几种特定的Geom-GCN实现实例化了该方案,最后实验证明了相对于现有技术的明显优势。

OpenKG

开放知识图谱(简称 OpenKG)旨在促进中文知识图谱数据的开放与互联,促进知识图谱和语义技术的普及和广泛应用。

点击阅读原文,进入 OpenKG 博客。