【泡泡一分钟】一种基于光场的快速有效深度图估计方法(3dv-43)

每天一分钟,带你读遍机器人顶级会议文章

标题:Fast and Efficient Depth Map Estimation from Light Fields

作者:Yuriy Anisimov,Didier Stricker

来源:3dv 2017 ( International Conference on 3D Vision)

播音员:zzq

编译:陈世浪 周平

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

本文提出了一种在光照时间较短的情况下,仅使用单线程的深度图估计算法。

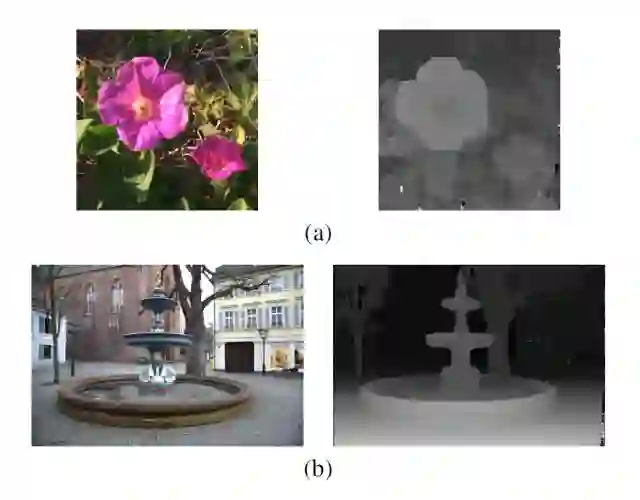

图1 算法效果图

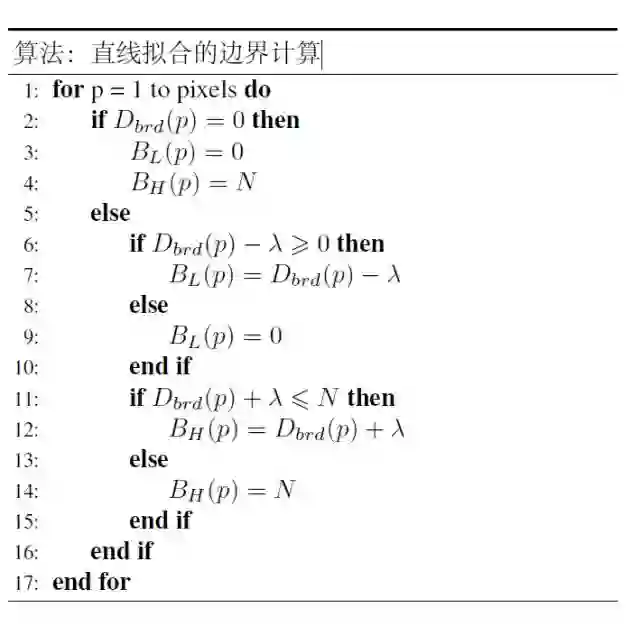

我们的方法改进了现有的四维光场空间线拟合(基于核密度估计的颜色值比较)原理。我们利用了半全局匹配的结果(SGM),并且将基于普查变换的匹配成本作为线拟合的边界初始值。我们的方法将寻找最佳深度匹配的计算量显著降低。

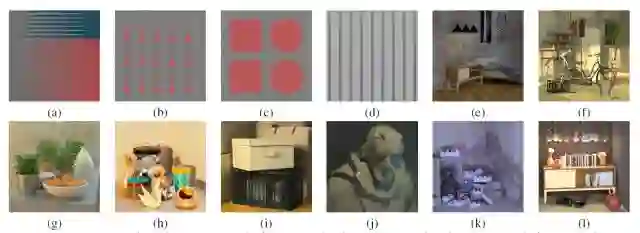

图2 数据集

图3 直线拟合的边界计算算法的伪代码

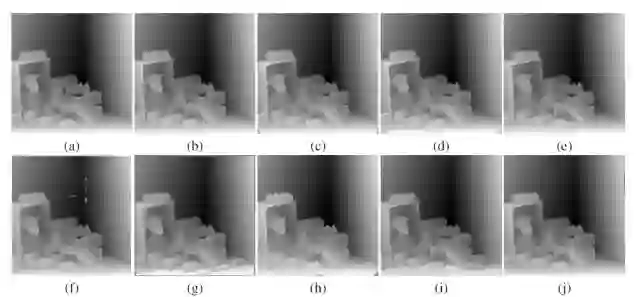

我们使用标准的评估指标表明本文方法对深度图估计是有效的,并可以将计算时间大大缩短。

图4 不同算法的处理结果

Abstract

The paper presents an algorithm for depth map estimationfrom the light field images in relatively small amountof time, using only single thread on CPU. The proposed method improves existing principle of line fitting in 4-dimensional light field space. Line fitting is based on color values comparison using kernel density estimation. Our method utilizes result of Semi-Global Matching (SGM) with Census transform-based matching cost as a border initialization for line fitting. It provides a significant reduction of computations needed to find the best depth match. With the suggested evaluation metric we show that proposed method is applicable for efficient depth map estimation while preserving low computational time compared to others.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

在【泡泡机器人SLAM】公众号(paopaorobot_slam)中回复关键字“3dv-43”,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com