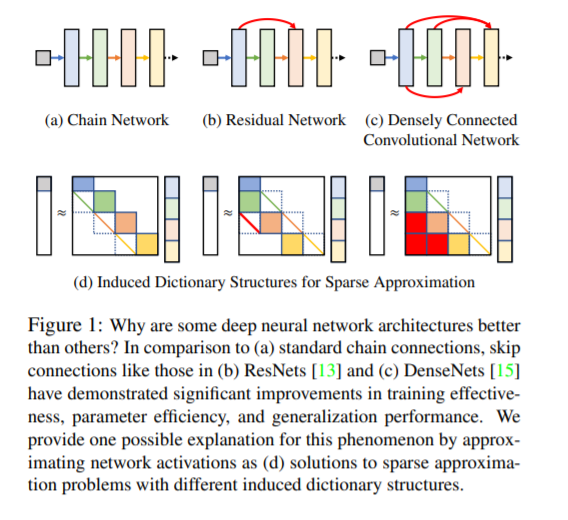

在需要平衡性能和参数效率的应用中,选择深度神经网络结构是一个基本问题。标准方法依赖于特定数据集上的特别工程或计算上昂贵的验证。相反,我们试图通过网络的内在能力来量化网络的独特性和健壮性,从而在不需要任何数据的情况下进行有效的架构比较。基于深度学习和稀疏逼近之间的理论联系,我们提出了深度框架潜力:一种与表征稳定性近似相关的相干性度量,但具有仅依赖于网络结构的最小值。这为联合量化架构超参数(如深度、宽度和跳过连接)的贡献提供了一个框架。我们验证了它作为模型选择标准的作用,并证明了它与各种通用残差和密集连接的网络架构上的泛化误差之间的相关性。

成为VIP会员查看完整内容

相关内容

Arxiv

3+阅读 · 2019年7月11日