谷歌又炫技:派个AI,帮科幻大师刘宇昆把小说写了

![]()

新智元报道

新智元报道

【新智元导读】近几年科技行业疯狂加注超大规模语言模型,一个最主要的成果就是「人工智能创造内容」(AIGC) 技术突飞猛进。

两年前 OpenAI 通过 GPT-3 模型展示了大语言模型的多样化实力。而最近各种 AI 基于文字提示生成图片的产品,更是数不胜数。

有趣的是,今年以来 AIGC 的风头基本都被 Stable Diffusion、Craiyon、Midjourney 等「小玩家」给抢了——像谷歌这样的 AI 巨头,反而没怎么见动静。

但其实谷歌并没有「躺平」。

临近年底,在11月2日早上,谷歌终于放出了大招。这家在 AI 研究上最久负盛名的硅谷巨头,居然一鼓作气发布了四项最新的 AIGC 技术成果,能够根据文本提示生成:

高分辨率长视频

3D模型

音乐

代码

以及可控文本生成技术。

「用 AI 赋能的生成式模型,具有释放创造力的潜能。通过这些技术,来自不同文化背景的人们都可以更方便地使用图像、视频和设计来表达自己,这在以前是无法做到的,」谷歌 AI 负责人 Jeff Dean 说道。

他表示,经过谷歌研究人员的不懈努力,现在公司不仅拥有在生成质量方面在行业领先的模型,还在这些模型基础上取得了进一步创新。

这些创新,包括「超分辨率的视频序列扩散模型」——也即将AI「文生图」扩展到「文生视频」,并且仍然确保超高清晰度。

以及 AudioLM,一个无需文字和音乐符号训练,仅通过聆听音频样本,就可以继续生成填补乐曲的音频模型。

从生成文字,到生成代码、音频、图片、视频和3D模型,谷歌似乎正在证明 AIGC 技术的能力还远未达到边界,并且大有用武之地。

接下来,一起好好看看谷歌这次都放了哪些大招。

AI 写作助手,深受刘宇昆喜爱?

说实话,看到谷歌做了一款 AI 写作工具的时候,硅星人是略微有点担心失业的……

但是了解了关于这款工具更多的情况之后,这种心情更多地转化成了欣慰。

我们一直在强调AI背后的「大语言模型」技术背景。而谷歌推出的 LaMDA Wordcraft,就是这样一款将语言模型核心功能发挥到极致的技术

LaMDA Wordcraft 是在 LaMDA 大语言模型的基础上开发了一个写作协助工具,是谷歌大脑团队、PAIR(People + AI Research)团队,以及 Magenta 音频生成项目组的合作结晶。

它的作用,是在创作者写作的过程当中,根据现有的文本产生新的想法,或者帮助重写已有文句,从而帮助创作者突破「创作瓶颈」 (writer's block)。

Wordcraft 用户界面

LaMDA 本身的设计功能很简单:给定一个单词,预测下一个最有可能的单词是什么,也可以理解成完形填空或者句子补完。

但是有趣的是,因为 LaMDA 的模型规模和训练数据量实在是太大了(来自于整个互联网的文本),以至于它获得了一种「潜意识」的能力,可以从语言中学习很多更高层次的概念——而正是这些高层次概念,对于创作者的工作流程能够带来非常大的帮助。

谷歌在 Wordcraft 用户界面中设计了多种不同的功能,能够让创作者自己调整生成文本的风格。「我们喜欢把 Wordcraft 比喻成『魔法文字编辑器』,它有着熟悉的网页编辑器的样子,背后却集成了一系列 LaMDA 驱动的强大功能,」谷歌网页如是写道。

你可以用 Wordcraft 重写语句,也可以让他把调节你的原始文本从而「更有趣」(to be funnier) 或者「更忧郁」 (to be more melancholy) 一点。

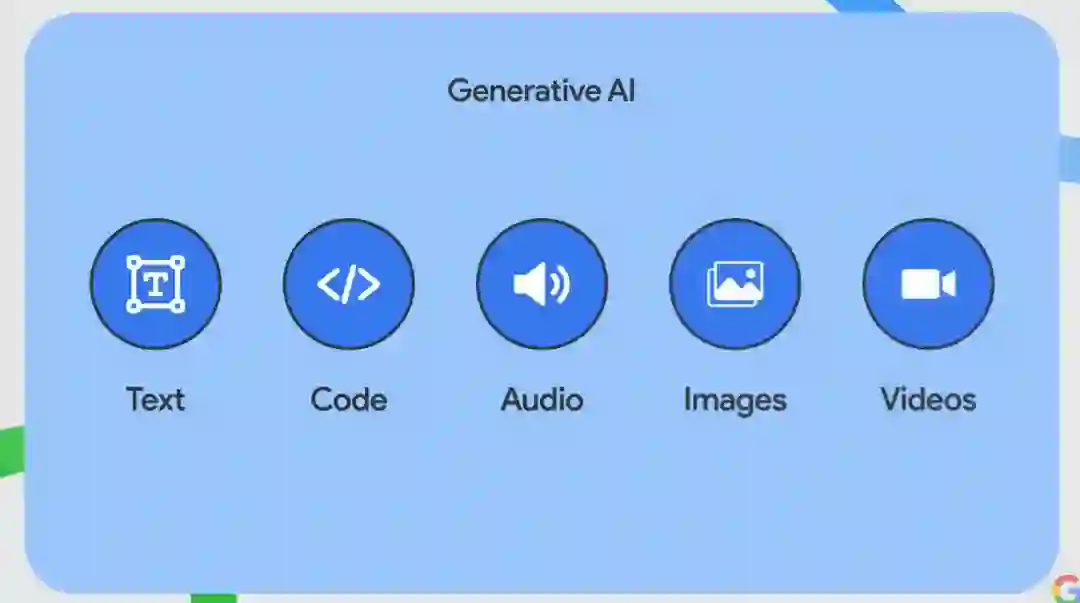

在过去一年时间里,谷歌举行了一个「Wordcraft 作家研讨会」的合作项目,找来了13位专业作家和文字创作者进行了长期深入的合作,让他们在自己的创作过程中借助 Wordcraft 编辑器来创作短篇小说。

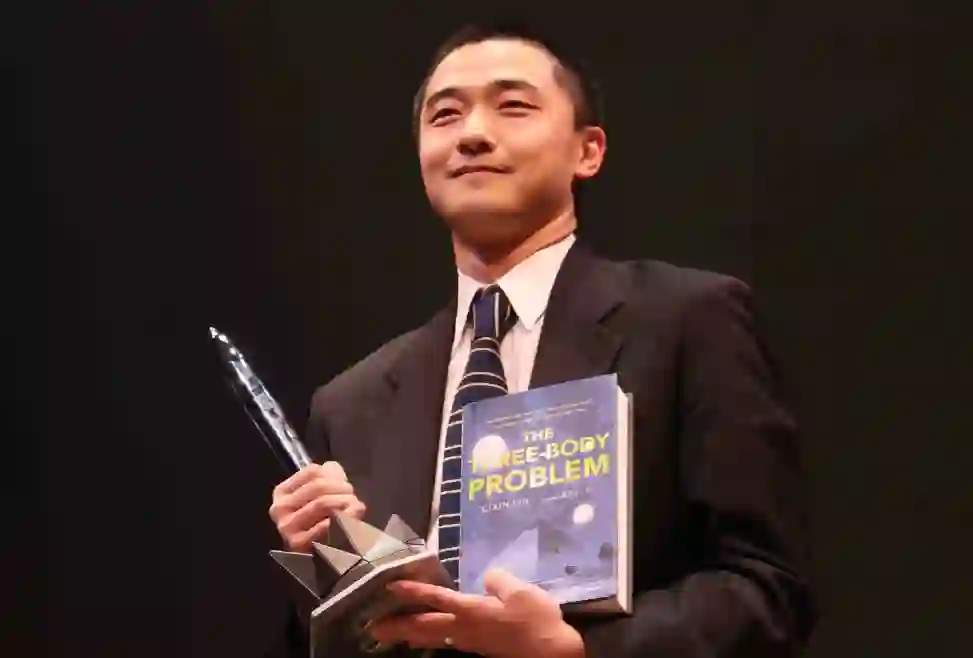

值得注意的是,知名科幻作家刘宇昆(热剧《万神殿》背后的小说作者、《三体》英文版译者)也参与了这一项目。

他在写作过程中遇到了一个场景,需要描述在商店里摆放的各种商品——过去此类写作细节比较容易打乱写作思路,但刘宇昆通过 Wordcraft 的帮助可以直接生成一个列表,节约了自己的脑容量,可以专心去写对故事更重要的东西。

而在另一个场景中,他发现自己的想象力被限制了,一直在重复熟悉的概念。于是他将「主动权」交给了 LaMDA,让它来开头,「这样就能够逼迫我探索一些从未想到过的可能性,发现新的写作灵感。」

你可以在 Wordcraft Writers Workshop 的官方页面(阅读原文按钮)中找到刘宇昆在 Wordcraft 帮助下撰写的短篇小说 Evaluative Soliloquies。顺便,他还借用 Imagen 为小说生成了几张插图:

超长、连贯性视频的生成,终于被攻破了?

大家对于 AI 文字生成图片应该都不算陌生了。最近一年里,有 DALL·E 2、Midjourney、Stable Diffusion、Craiyon(不分先后)等知名产品问世;而谷歌也有自己的AI 文字转图片模型,并且一做就是两个:Imagen(基于大预言模型和行业流行的扩散模型),和 Parti(基于谷歌自家的 Pathways 框架)。

尽管今年 AIGC 的热闹都被 Stable Diffusion 这些炸子鸡给抢光了,低调沉稳的谷歌并没有躺平。

当其他人都似乎「阶段性」满足于用文字提示做小图片时,谷歌其实已经在加速往前冲了:它比任何人都更早进入了「文字生成高分辨率视频」,这一从未被探索过的复杂技术领域。

「生成高分辨率,且在时间上连贯的视频,是非常困难的工作,」Google Research 高级研究总监 Douglas Eck 表示。

「不过好在,我们最近有两项研究,Imagen Video 和 Phenaki,可以解决视频生成的问题。」

你可以这样理解:文字转图片就是根据一段文字提示来生成一张(或者多张平行的图片),而 Imagen Video 和 Phenaki 是可以根据多条文字提示,来生成在时序上连贯的多张照片——也就是视频。

具体来说,Imagen Video 是通过文本生成图像的扩散模型,能够生成具有前所未有真实度的高清画面;同时由于建立在基于 Transformer 技术的大规模语言模型上,它也具备极强的语言理解能力。

而 Phenaki 则是完全通过大语言模型,在时序上不断生成 token 的方式来生成视频。它的优势在于能够生成极长(数分钟)的视频,且画面的逻辑和视觉连贯性更强。

两者结合,强强联手,就得到了这样一条清晰度高,视觉和逻辑上也更加连贯的视频:

原视频总长1分钟左右,此版本有所加快 视频来源:Google Research

附:采用的文字提示

一个蓝色的气球插在红杉树的树枝上 镜头从挂着蓝色气球的树上移到动物园门口 镜头快速移动到动物园内 第一人称视角:在一个美丽的花园内飞行 长颈鹿的头从旁边冒出来 长颈鹿走向一棵树 |

放大长颈鹿的嘴 长颈鹿靠近树枝,拿起一个蓝色的气球 一个带白线的蓝色气球向长颈鹿的头部飞去 长颈鹿在附近咀嚼蓝气球镜头 随着单个蓝气球的飞走而向上倾斜 |

「说句实在话,这个项目不是我做的,但我觉得它真的非常令人惊讶。」Eck 表示,这项技术最强大之处,就在于可以使用多条文字提示组成的序列,来生成超高清晰度的视频,带来一种全新的故事讲述的能力。

「当然,AI 视频生成技术还处在襁褓阶段,我们非常期待跟更多影视专业人士以及视觉内容创作者合作,看他们会如何使用这项技术。」

无参考音频生成

早年 OpenAI 发布 GPT 初代模型的论文标题很经典:「Language models are few-shot learners」,点出了大语言模型在极少量样本的基础上,就可以在多种自然语言处理类任务上展现出强大的能力——同时,这个标题预言了今后更强大的大语言模型,能够做到更多更厉害的事情。

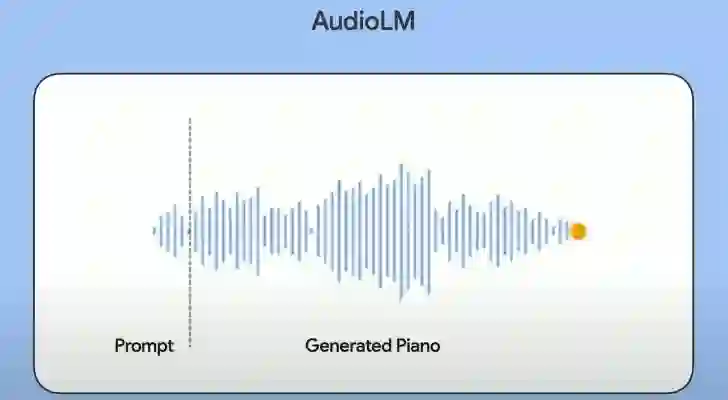

而今天,谷歌展示的 AudioLM 纯音频模型就验证了这一预言。

图片来源:Google Research

AudioLM 是一个具备「长期连贯性」的高质量音频生成框架,不需要任何文字或音乐符号表示的情况下,只在极短(三四秒即可)的音频样本基础上进行训练,即可生成自然、连贯、真实的音频结果,而且不限语音或者音乐。

用 AudioLM 生成的语句,在句法和语义上仍然保持了较高的可信度和连贯性,甚至能够延续样本中说话人的语气。

更厉害的是,这个模型最初没有用任何音乐数据进行训练,结果却十分惊人:能够从任何乐器或乐曲录音中进行自动「续写」——这一事实,再一次展现出了大语言模型的真正实力。

下面的音频是一段20秒左右的钢琴曲,先听听感受一下:

其他 AIGC 技术、产品