这种有序神经元,像你熟知的循环神经网络吗?

选自 openreview

机器之心编译

参与:张玺、王淑婷

本文基于以前的 RNN 模型研究,提出了一种有序神经元,该神经元能够强制执行隐藏状态神经元之间更新频率的顺序,并且将潜在树结构整合到循环模型中。此外,本文提出的一种新 RNN 单元在语言建模、无监督成分句法分析、有针对性的语法评估及逻辑推理四个任务上都表现优异。

引言

虽然自然语言通常以序列形式呈现,但语言的基本结构并不是严格序列化的。语言学家们一致认为,该结构由一套规则或语法控制(Sandra & Taft,2014),且规定了单词组成语句的逻辑。不管其表现形式如何,这种结构通常是树状的。虽然语言学家们已发现这一规律,但其潜在结构的真正起源却仍不得而知。某些理论认为,这可能与人类认知的内在机制相关(Chomsky & Lightfoot,2002)。由于人工神经网络的灵感来源于生物神经系统的信息处理及通讯模式,上述可能性让更多人对使用人工神经网络研究语言的潜在结构产生了兴趣。

从实用角度看,将树结构集成到语言模型中也很重要,原因如下:

能获得抽象化级别不断提升的分层表征,抽象化也是深度神经网络的关键特征(Bengio 等,2009; LeCun 等,2015; Schmidhuber,2015);

能捕获复杂语言现象,如长期依赖问题(Tai 等,2015)与组分效应(compositional effects)(Socher 等,2013);

能为梯度反向传播提供捷径(Chung 等,2016)。

近些年,很多人开始关注开发能够利用语法知识或至少一些树结构(Williams 等,2018;Shi 等,2018)来形成更好语义表征的深度神经网络(Shen 等,2017; Jacob 等,2018;Bowman 等,2016;Choi 等,2018;Yogatama 等,2016)。

获得树结构的一种简单方法是通过监督语法分析器。这些分析器生成的树结构被用来指导单词语义到句子语义的组合(Socher 等,2013;Bowman 等,2015),甚至在给定先前单词的情况下帮助预测下一个单词(Wu 等,2017)。然而,监督分析器也有一些局限性:1)很少有语言具有用于监督分析器训练的全面注释数据;2)在可用的语言数据中,语法规则往往被打破「如推特上的表达」;3)在实际运用过程中,语言始终在变化,因此语法规则可能会演变。

另一方面,以无监督方式从可用数据中学习树结构仍是一个未解决的问题。训练过程中的繁琐结构(如左分支树结构、右分支树结构(Williams 等,2018))或强化学习训练困境(Yogatama 等,2016),使许多研究无功而返。而且,一些方法的实现和训练相对复杂,如 Shen 等人提出的 PRPN(2017)。

循环神经网络(RNN)已被证明在语言建模任务中非常高效(Merity 等,2017;Melis 等,2017)。RNN 隐式地在数据上强加了链式结构。该链式结构似乎与语言的潜在非序列化结构不一致,并且给运用深度学习方法处理自然语言数据带来了一些困难,如捕获长期依赖(Bengio 等,2009)、获得良好泛化能力(Bowman 等,2015)及处理否定 (Socher 等,2013)等。同时,有证据表明,拥有充足能力的循环神经网络有潜力隐式地编码这种树结构(Kuncoro 等,2018)。但问题是,在模型架构上强加树结构归纳先验会导致更好的语言模型吗?

本文介绍了一种面向循环神经网络的新型归纳偏置:有序神经元。这种归纳偏置增强了神经元之间的依赖性,这种依赖性反映了每个神经元内所存储信息的生命周期。换言之,一些高级神经元储存长期信息,而低级神经元储存短期信息。为了避免高级和低级神经元之间的固定划分,本文进一步提出了一种新的激活函数 cumax()来主动分配神经元去存储长/短期信息。基于 cumax()和长短期记忆网络(LSTM)架构,本文设计了一种新模型──ON-LSTM,它使 RNN 模型能够能够在不破坏其序列形式的情况下执行树状合成。该模型在语言建模、无监督成分句法分析(unsupervised constituency parsing)、有针对性的语法评估(Marvin & Linzen, 2018)及逻辑推理(Bowman 等,2015)四个任务上表现优异。其在无监督成分句法分析任务上的结果表明,本文提出的归纳偏置与人类专家提出语法原则是一致的。我们的实验还表明,就长期依赖和较长序列泛化而言,ON-LSTM 比标准 LSTM 模型性能更佳,

论文:ORDERED NEURONS: INTEGRATING TREE STRUCTURES INTO RECURRENT NEURAL NETWORKS

论文链接:https://openreview.net/forum?id=B1l6qiR5F7

摘要:循环神经网络模型已被广泛用于处理由潜在树结构控制的序列数据。以前的研究表明,RNN 模型(尤其是基于 LSTM 的模型)能够学习利用潜在树结构。然而,它的性能却始终落后于基于树的模型。我们提出了一种新的归纳偏置──有序神经元(Ordered Neuron),它强制执行了隐藏状态神经元之间更新频率的顺序。本文表明,有序神经元能够将潜在树结构明确整合到循环模型中。为此,我们提出了一种新的 RNN 单元:ON-LSTM,其在语言建模、无监督成分句法分析、有针对性的语法评估及逻辑推理四个任务上表现优异。

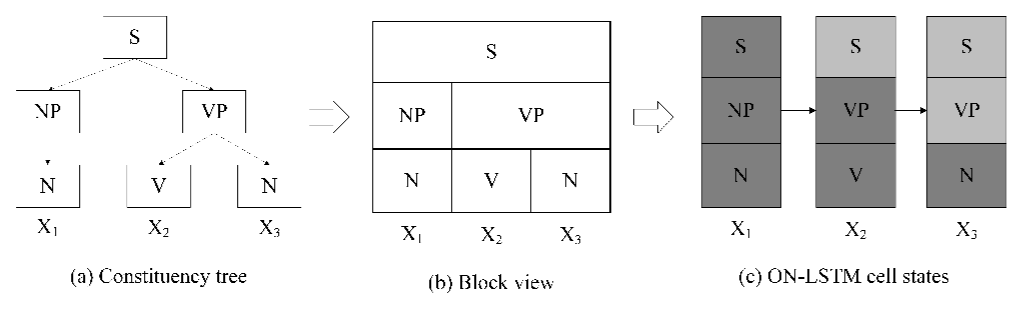

图 1:成分句法分析树与 ON-LSTM 的关系。给定 token 序列 (x1, x2, x3),其成分句法分析树如图(a)所示。图(b)展示了树结构的块状图,其中 S 与 VP 节点都跨越了不止一个时间步。高级节点的表征在跨越多个时间步时应保持相对一致。图(c)展示了每组神经元在每个时间步的更新神经元比例。在每个时间步,给定输入词,较深的灰色块代表完全更新,较浅的灰色块代表部分更新。三组神经元的更新频率不尽相同。较高级别的组更新频率较低,而较低级别的组更新频率较高。

ON-LSTM

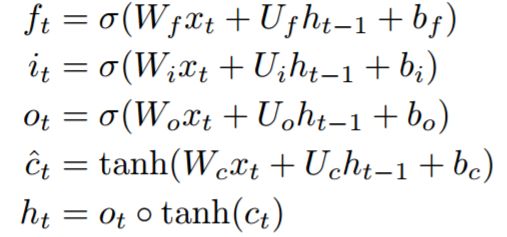

本文提出了一种新的 RNN 单元──ON-LSTM,作为有序神经元的实现。该新模型与标准 LSTM 模型的架构相似。

ON-LSTM 与标准 LSTM 模型的唯一区别在于,我们排除了单元状态 ct 的更新功能,并以新的更新规则替代,后续章节将会详细解释。与之前一样,运用遗忘门 ft 与输入门 it 控制单元状态 ct 上的清除和写入操作。一般来说,由于标准 LSTM 的门不会在其各个单元中强加拓扑结构,所以各个单元的行为不会反映出排序。

实验

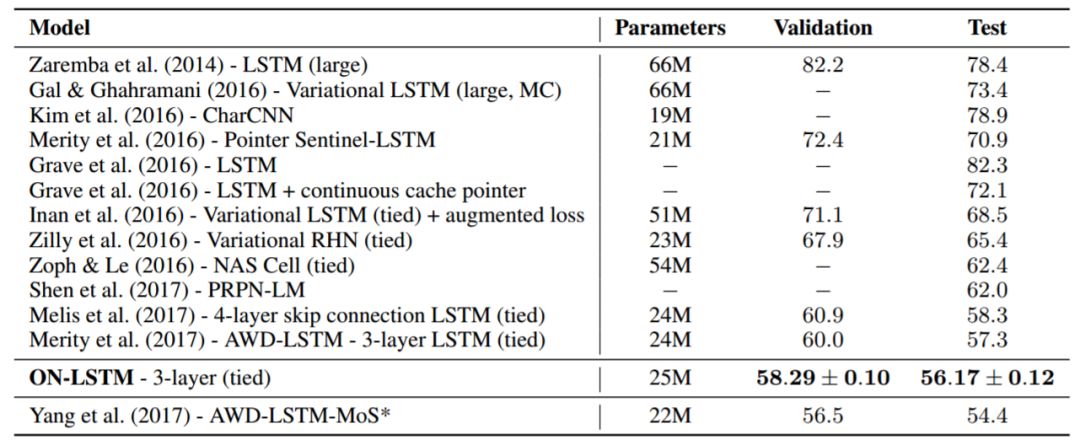

表 1:宾州树库语言建模任务中验证集和测试集上的单个模型困惑。标注「tied」的模型在嵌入和 softmax 权重上使用权重绑定。标注「*」的模型重点关注改进 RNN 语言模型的 softmax 部分。

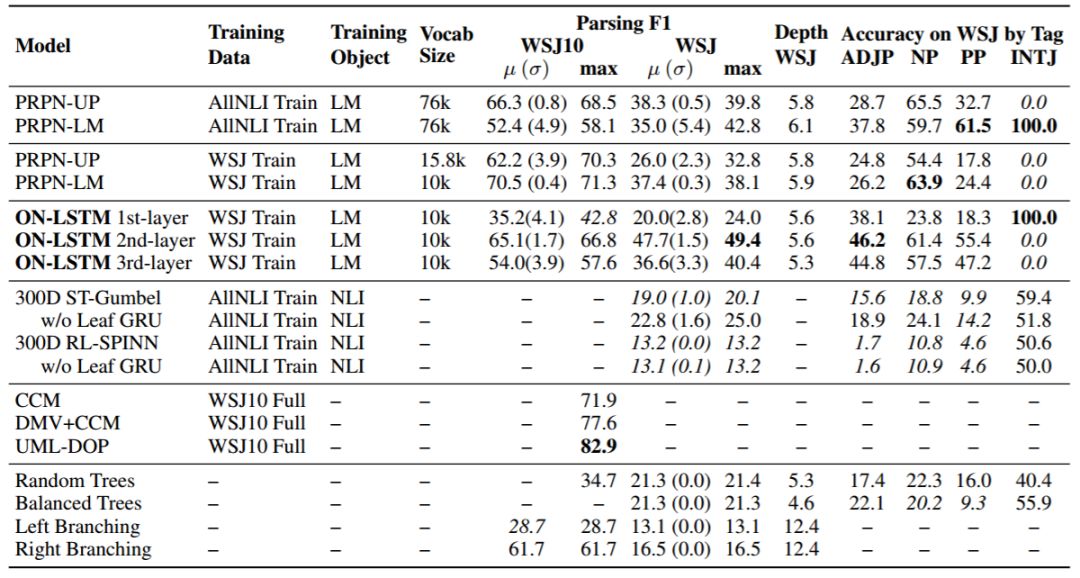

表 2:在完整的 WSJ10 和 WSJ 测试集上评估无标记「parsing F1」的结果。本文的语言模型分三层,每层都提供了ˆdt 序列。本文给出了所有层的分析性能。RL-SPINN 和 ST-Gumbel 的结果在完整的 WSJ(Williams 等,2017)上评估。PRPN 模型在 WSJ 测试集(Htut 等,2018)上评估。

表 3:ON-LSTM 和 LSTM 在每个测试案例上的整体准确率。「Long-term dependency」表示目标词对之间存在一个不相关的短语或从句,而「short-term dependency」意味着没有这猴子那个分散注意力的情况。

本文为机器之心编译,转载请联系本公众号获得授权。

✄------------------------------------------------

加入机器之心(全职记者 / 实习生):hr@jiqizhixin.com

投稿或寻求报道:content@jiqizhixin.com

广告 & 商务合作:bd@jiqizhixin.com