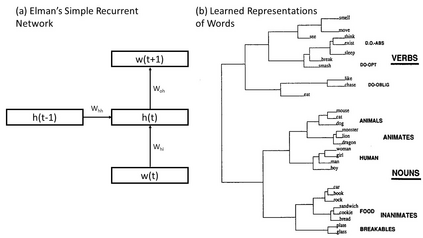

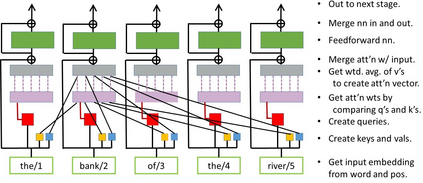

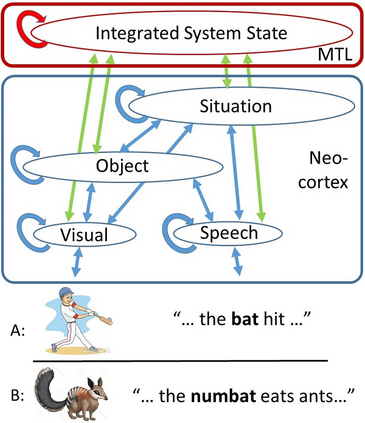

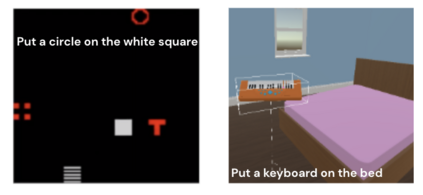

Language is central to human intelligence. We review recent breakthroughs in machine language processing and consider what remains to be achieved. Recent approaches rely on domain general principles of learning and representation captured in artificial neural networks. Most current models, however, focus too closely on language itself. In humans, language is part of a larger system for acquiring, representing, and communicating about objects and situations in the physical and social world, and future machine language models should emulate such a system. We describe existing machine models linking language to concrete situations, and point toward extensions to address more abstract cases. Human language processing exploits complementary learning systems, including a deep neural network-like learning system that learns gradually as machine systems do, as well as a fast-learning system that supports learning new information quickly. Adding such a system to machine language models will be an important further step toward truly human-like language understanding.

翻译:语言是人类智力的核心。 我们审视了最近在机器语言处理方面的突破,并思考了有待实现的目标。 最近的方法依赖于在人工神经网络中获取的学习和代表的通用领域原则。 但是,目前的大多数模式都过于关注语言本身。 在人类中,语言是获取、代表、交流物质和社会世界中的物体和情况的更大系统的一部分,未来的机器语言模式应当效仿这样的系统。 我们描述了将语言与具体情况联系起来的现有机器模式,并指明了扩展,以解决更为抽象的案例。 人类语言处理利用了互补学习系统,包括像机器系统一样逐步学习的深层神经网络式学习系统,以及支持快速学习新信息的快速学习系统。 将这种系统添加到机器语言模式中将是向真正像人类一样的语言理解迈出的重要一步。