新开源RadarSLAM: 不惧风雪雨雾夜的全天候大场景激光SLAM!

点击上方“计算机视觉life”,选择“星标”

快速获得最新干货

今天介绍的工作来自最近的这篇论文:

RadarSLAM: Radar based Large-Scale SLAM in ALL Weathers

项目主页:http://pro.hw.ac.uk/research/radarslam/

摘要

近年来,依靠各类传感器的slam已经得到了广泛使用。然而,slam算法在极端天气下的鲁棒性问题一直未得到解决。在本文中,作者提出了一种全天候,大场景下的雷达slam框架。通过全新的特征匹配和概率点云地图实现了包括位姿估计、局部建图、回环检测以及位姿图优化一系列功能。作者在公开数据集和自己收集的数据集中进行了广泛的实验,结果表明了在各种恶劣天气条件下,如黑夜、浓雾和大雪等天气条件下。算法拥有良好的可靠性已经定位精度。

原理及主要创新点

文章的主要贡献主要有四点:

(1). 高效、可靠的特征点提取和匹配。

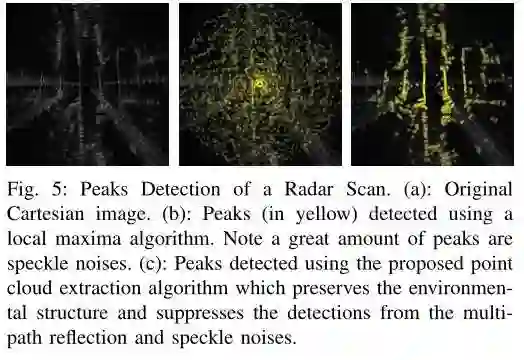

(2). 从雷达图像中生成概率点云可以显著降低斑点噪声。

(3). 可工作在恶劣天气条件下的图优化slam系统。

(4). 在大场景环境中进行了大量的实验,首次证明了算法可以工作在极端天气环境中(如浓雾和大雪)。

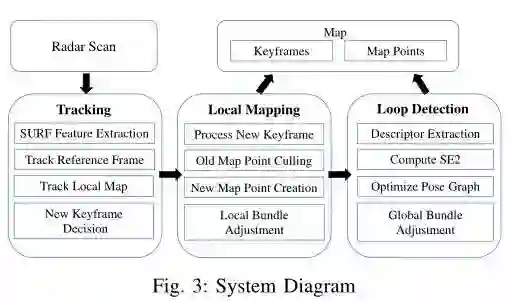

算法主体框架如下:

一. 特征点提取模块

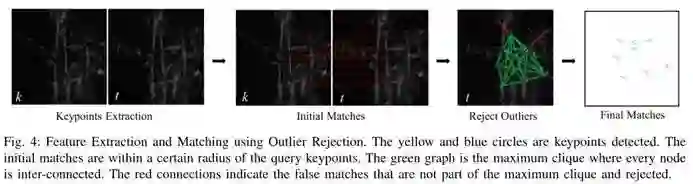

作者使用FMCW(调频连续波雷达)作为主传感器,可以同时测量距离与速度,并生成雷达图像。通过SURF特征点提取算法进行关键点的提取。利用描述子构建关键点的匹配,并利用深度信息提取了两个改进以减小不正确的匹配。

(1). 引入运动估计(例如最大速度)来约束关键点在雷达局部坐标系的搜索半径。减少不正确的匹配次数同时也避免了穷举特征匹配所需要的计算时间

(2). 关键点一致性约束,利用两个想匹配的关键点应遵循相同的运动趋势。进一步的降低了异常值的影响。

特征点提取与匹配

二.局部子图构建

作者通过加权的均方误差来优化完成当前帧与子图的匹配。优化方法使用LM算法。

三.回环检测

由于雷达图像本身的特点,使得视觉slam的磁带模型回环检测方法难以适用。作者通过将雷达图像转换成点云进而捕获到场景中的结构信息,利用局部极大抑制算法去除斑点噪声,结合点云的反射密度的空间特征来完成回环检测。

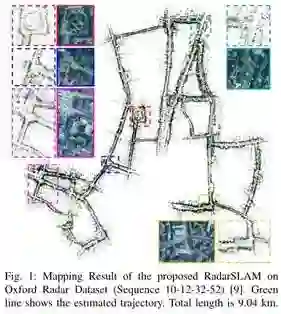

实验结果

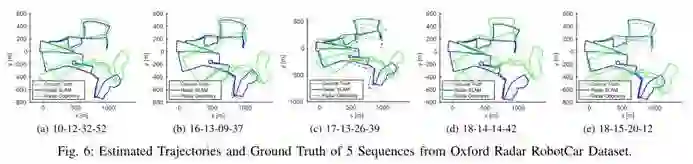

RadarSLAM 在Oxford Radar 数据集上的结果,绿线表示估计的位姿,总长度是9.04km.

在数据集Oxford Radar RobotCar 上估计的轨迹和groundtruth的对比如下图所示

鲁棒性

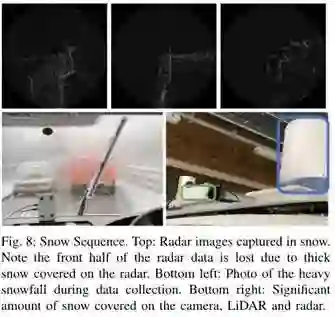

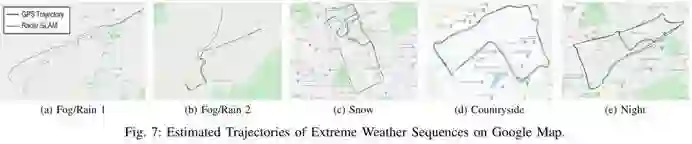

为了验证算法在极端天气的鲁棒性,本文作者采集了在雨、雪、大雾、夜间等非常有挑战的数据。数据采集车装备有GPS, IMU导航系统,一个Velodyne HDL-32 激光雷达,一个ZED双目相机,一个NavTech 雷达扫描仪。NavTech最大距离是100m,分辨率 0.1736 pixel/m, 和Oxford Radar Dataset中的有点不同。

极端天气下的位姿估计结果见下。从实验结果来看,在所有的传感器中,只有雷达系统可以在所有天气状况下可靠的定位。

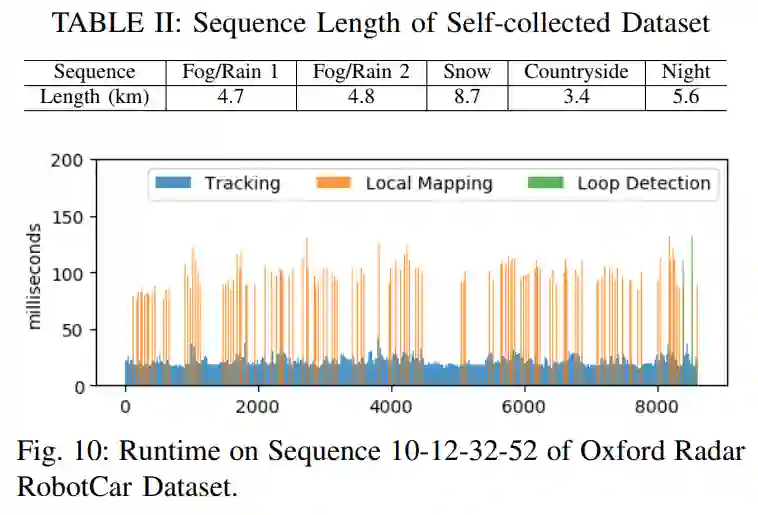

运算速度

RadarSLAM 是使用C++实现的,没有使用GPU的情况下,在Intel i7 2.60GHz CPU上,16GB RAM上的笔记本运行速度是6Hz。一个37分钟的序列(约9000幅图像)是实时的。

在深话AI 公众号后台回复:全天候,获得论文及中文翻译pdf

从0到1学习SLAM,戳↓

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

投稿、合作也欢迎联系:simiter@126.com

长按关注计算机视觉life