初学者系列:推荐系统Wide & Deep Learning详解

核心思想

01

动机

02

tips:”query“为当用户访问app store的时候生成的许多用户和文本特征。

tips:Memorization是从历史数据中学习特征的共性或者相关性;Generalization为相关性的传递,发现历史数据中很少或者没有出现的新的特征组合,来提高推荐物品的多样性。

原理

03

-

y是预测值; -

x = [x1,x2,...,xd]是d维特征的向量(包括两部分); -

w = [w1,w2,...,wd]是模型权重,b是偏差。

交叉积:相当于“逻辑与”运算AND,AND{A,B}当且仅当"A=1且B=1“时,交叉特征才为1。如果第i个特征是第k个变换φk的一部分,则c_{ki}为1,否则为0。

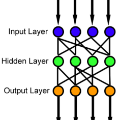

-

l是层数 -

f是激活函数,通常是ReLUs -

a^(l),b^(l)和W^(l)是第l层的激活,偏差和模型权重。

联合训练:两个模型是一起训练所有参数,两个模块只要互相补充对方不足。

-

Y是二进制类别标签 -

σ(·)为sigmod函数 -

φ(x)是原始特征x的交叉积转换特征 -

b是偏置。 -

w_wide是所有wide模型权重 -

w_deep是最终激活层a_(lf)的权重

实践

04

-

census_dataset.py主要处理数据以及生成特征列; -

wide_deep_run_loop.py主要定义训练以及评价; -

census_main.py为主函数,主要定义模型并且进行训练。

-

下载数据集,并对数据进行处理

-

构建特征列

-

tf.feature_column.numeric_column:全部由数值型构成的,默认值为float32。 -

tf.feature_column.categorical_column_with_hash_bucket:计算输入的哈希值,然后使用模运算符将其置于其中一个 hash_bucket_size 类别。 -

tf.feature_column.categorical_column_with_vocabulary_list:根据明确的词汇表将每个字符串映射到一个整数(one—hot类型)。 -

tf.feature_column.bucketized_column:据数值范围将其值分为不同的类别(如:年龄<20,经过处理可表示为[1,0,0,0,0]) -

tf.feature_column.crossed_column:将多个特征组合为一个特征,即论文中的交叉积特征转换(cross-product transformation)。 -

tf.feature_column.indicator_column:将每个类别视为one-hot矢量中的一个元素,其中匹配类别的值为 1,其余类别为 0 -

tf.feature_column.embedding_column:与indicator_column不同 ,经常为0-1之间的小数,而不是只有一个位置(例tf.feature_column.embedding_column(occupation, dimension=3),输出结果为[0.233,0.256,0.487])

-

定义Estimator的输入函数

-

参数设置

-

定义模型

丨tips:关于DNNLinearCombinedClassifier的详细信息,可以点击DNNLinearCombinedClassifier查看

-

开始训练

登录查看更多

相关内容

专知会员服务

28+阅读 · 2020年6月13日

专知会员服务

159+阅读 · 2020年4月2日

专知会员服务

97+阅读 · 2020年3月17日

Arxiv

3+阅读 · 2018年5月28日

Arxiv

5+阅读 · 2018年4月28日