微积分的本质 合集

遇见数学

微积分其实没那么可怕,如果你能找到它来时的路.

设计丨公理 动图丨李想

来自 3Blue1Brown 微积分系列不仅提供了可视化的方式来展示和理解概念, 更是可以有效地接触到微积分的核心思想, 让读者也可以做到"从 0 开始创造微积分".

这个系列章节安排如下: 绪论(1), 导数(2-6),极限(7),积分和微积分基本定理(8-9),泰勒级数(10).

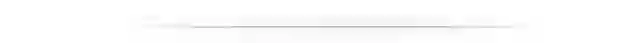

微积分绪论

以一个简单的几何问题开始: 求圆的面积,通过把圆的面积分成一系列的圆环, 最后推导出其公式, 以此来窥见微积分的三个中心思想: 积分, 微分以及两者互逆.

>>>全文链接

B.C.287 年: 阿基米德的"逼近法"

利用“逼近法”算出球表面积、球体积、抛物线、椭圆面积,后世的数学家依据这种方法加以发展成近代的“微积分”

2

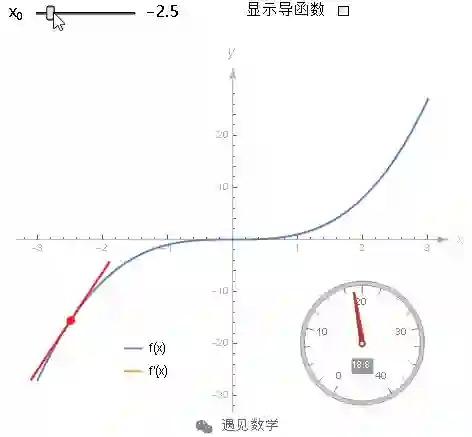

导数的悖论

"导数测量的是瞬时变化率"这样的表述其实是有问题的,因为总是需要拿出两个时间点来做比较才能求出变化量. 所以函数在某点的导数还是视为在该点附近变化率的最佳近似好了.

>>>全文链接

A.D.1629 年: 费马

费马引理给出了一个求出. 可微函数的最大值和最小值的方法。因此,利用费马引理,求函数的极值的问题便化为解方程的问题.

3

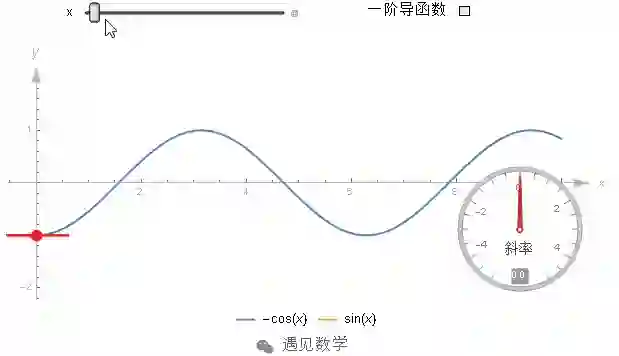

用几何来求导

通过几何问题来非常直观地推导出最核心的一些求导公式,例如幂函数求导和正弦函数求导.

>>>全文链接

A.D.1637 年: 笛卡尔

笛卡尔成功地将当时完全分开的代数和几何学联系到了一起, 为后人在微积分上的工作提供了坚实的基础.

4

直观理解链式法则和乘积法则

求导的加法法则, 乘积法则和链式法则形象的几何解释,一步一步将其推导出来.

>>>全文链接

A.D.约 1150 : 婆什迦罗

婆什迦罗, 印度古代和中世纪最伟大的数学家, 比牛顿和莱布尼茨早五个世纪就构想了微积分; 采用缩写文字和符号来表示未知数和运算;

5

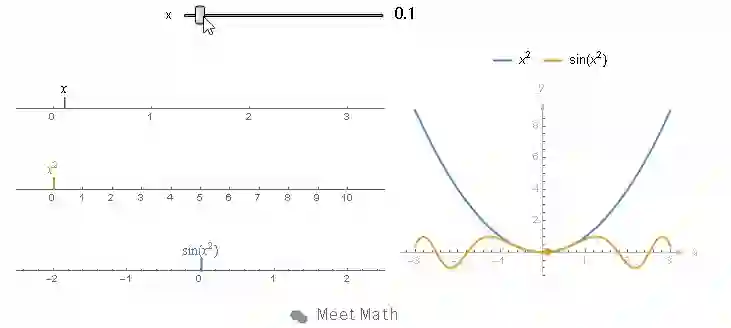

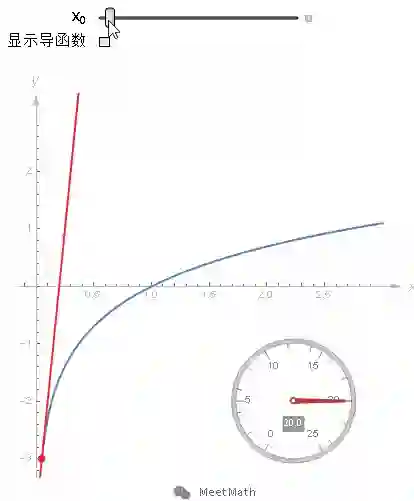

指数函数求导

e 是描述增长率的自然常量, 并且 e^x 还是唯一具有下面性质的函数: 这个函数曲线上的每一个点的 y 值, 在该点的斜率和曲线下面积三者都是相同值. (c为常数) 中 c 这个常数表示着变化率和数量本身这两者的比例系数.

>>>全文链接

A.D.1665 年: 牛顿与《广义二项式定义》

艾萨克·牛顿发表广义二项式定理,并开始发展一套新的数学理论,也就是后来为世人所熟知的微积分学, 牛顿称之为"流数术".

6

隐函数求导是怎么回事?

隐函数这种带多个变量的表达式求导,究竟是什么意思? 这些变量是如何联系在一起, 如何变化的. 为什么要处理如此微小变化量的dy 和dx.

>>>全文链接

A.D.1670 年: 伊萨克·巴罗《几何学讲义》

发布的《几何学讲义》包含了他对无穷小分析的卓越贡献,特别是其中“通过计算求切线的方法”,十分接近微积分基本定理.

7

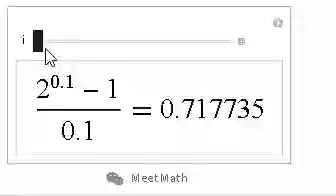

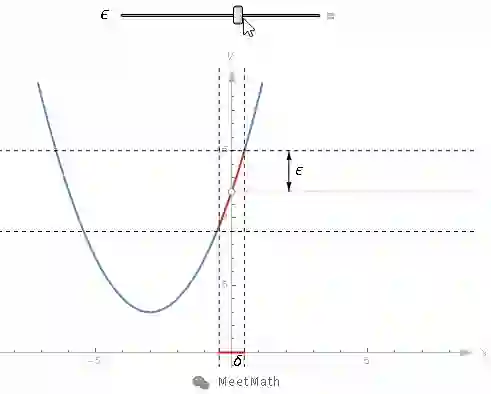

极限

导数正式的定义,极限严格的 ε-δ 定义,以及求解 0/0 型极限的洛必达法则是怎样的由来呢?

>>>全文链接

A.D.1684 年: 莱布尼茨关于微分学的第一篇微分学论文

在数学上,他从几何角度和牛顿先后独立发明了微积分, 但他所发明了微积分的数学符号 dx, dy 和 ∫ 被更广泛的使用.

8

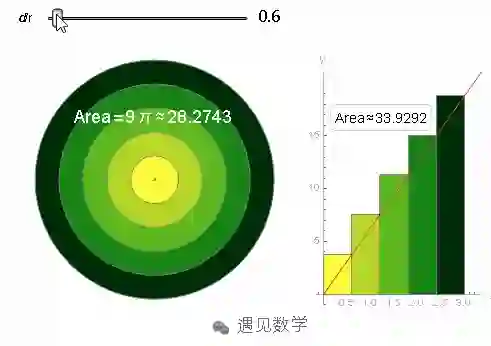

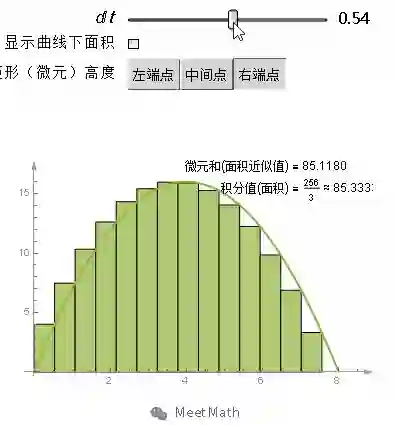

积分与微积分基本定理

描述了微积分的两个主要运算:微分和积分之间关系的微积分基本定理(牛顿-莱布尼兹公式).

>>>全文链接

A.D.1691 年: 约翰.伯努利著世界上第一本关于微积分的教科书

雅各布和弟弟约翰·伯努利是莱布尼茨的朋友,他们不但迅速掌握了莱布尼茨的微积分并加以发扬光大, 而且是最先应用微积分于各种问题的数学家.

9.1

面积和斜率有什么联系?

我们知道怎样求离散数的平均值, 但如何求一个连续变量的平均值呢?

>>>全文链接

A.D.1755 年: 欧拉著《微积分概论》

有史以来最伟大的数学家之一. 他是历史上最重要的求积专家之一, 被积函数越是奇特, 他做的越是得心应手; 他完善和扩展了微积分, 为无穷级数, 微分方程等分支的发展奠定了基础.

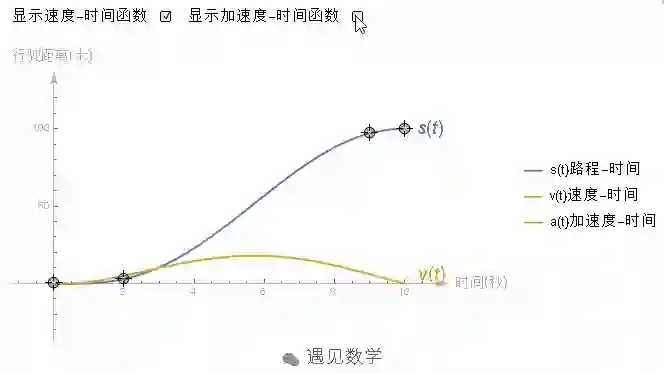

9.2

高阶导数

导数可以理解为 x 点处所对应的图像的斜率, 而二阶导数是导数的导数,它表示的斜率的变化情况......

>>>全文链接

A.D.1823 年: 柯西的《无穷小分析教程概论》

他认为全部微积分应当建立在极限思想的基础上:"当属于一个变量的相继的值无限地趋近某个固定值时, 如果最终同固定值之差可以随意地小, 那么这个固定值就称为所有这些值的极限. "

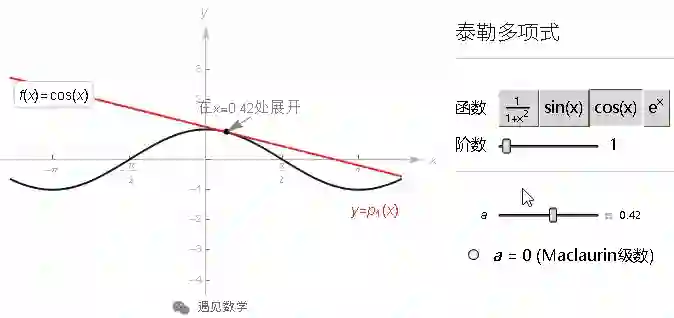

10

泰勒级数

泰勒多项式在数学中是一种极其强大的函数近似工具, 而泰勒级数可以给出处理函数较为方便多项式形式.

>>>全文链接

A.D.1815 年: 魏尔斯特拉斯与 ε-δ 定义

给函数的极限建立了教科书中一直沿用到今天严格的 ε-δ 定义, 来代替柯西的"无限趋近"描述, 使极限理论成为了微积分的坚定基础, 系统建立了实分析和复分析的基础.

ps:愿你的那段学习微积分的时光,终将变得有意义.

再ps:如果你觉得学习之路有些孤单,那么,从今天开始,请与我们同伴,一起前行.

注: 部分图片自网络

遇见数学

拨开知识的层层密林,探寻美妙数学中的趣味.

感谢有你,伴我前行

欢迎订阅 [遇见数学]

✬如果你喜欢这篇文章,欢迎分享到朋友圈✬

评论功能现已开启,灰常接受一切形式的吐槽和赞美☺