美国工程院院士MIT教授Dimitri2022新书《AlphaZero最优模型预测与自适应控制》,(附书稿PDF&讲义)

MIT科学家Dimitri P. Bertsekas今日发布了一份2022即将出版的《Lessons from AlphaZero for Optimal, Model Predictive, and Adaptive Control》书稿及讲义,该专著为强化学习进阶,目的在于通过从AlphaZero获取经验教训,涵盖最优模型预测与自适应控制。

作者Dimitri P. Bertsekas教授,1942年出生于希腊雅典,美国工程院院士,麻省理工大学电子工程及计算机科学教授。Bertsekas教授因其在算法优化与控制方面以及应用概率论方面编写了多达16本专著而闻名于世。他也是CiteSeer搜索引擎学术数据库中被引用率最高的100位计算机科学作者之一。Bertsekas教授还是Athena Scientific出版社的联合创始人。

http://web.mit.edu/dimitrib

Lessons from AlphaZero for Optimal, Model Predictive, and Adaptive Control

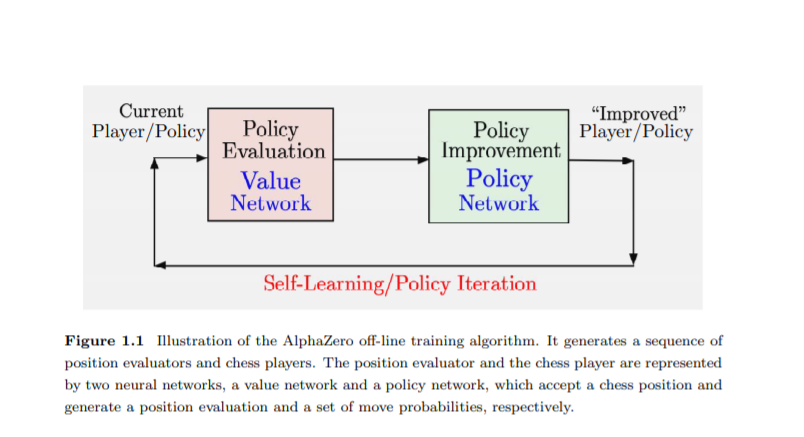

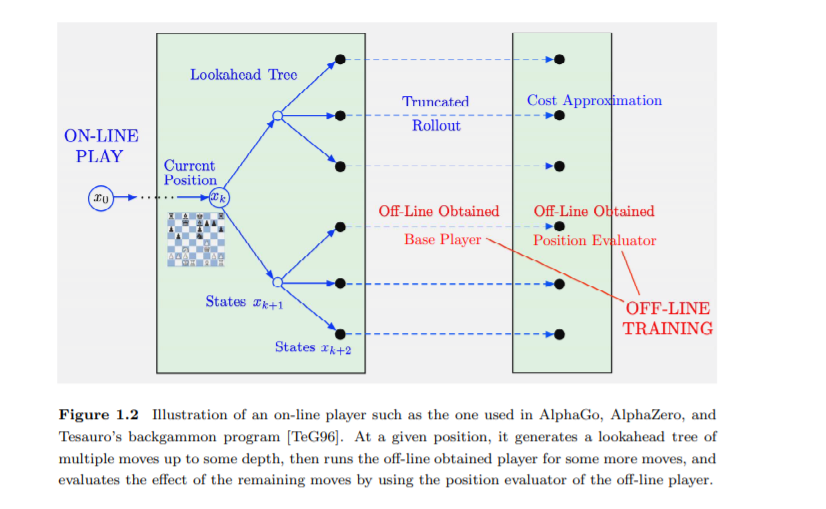

人工智能和强化学习领域中一些最令人兴奋的成功故事都发生在游戏领域。主要的例子是最近的AlphaZero程序(它下国际象棋),以及早期(1990年代)结构类似的TD-Gammon程序(它下西洋双陆棋)。这些程序经过离线的广泛训练,使用复杂的自演化/近似策略迭代算法和神经网络。然而,在离线情况下获得的AlphaZero玩家并不会在在线游戏中直接使用(由于离线神经网络训练固有的近似错误,它太不准确了)。取而代之的是一个单独的在线玩家,它是基于多步预测和一个经过离线训练的终端位置评估器,在线玩家执行一种形式的策略改进,这与离线玩家不同,它不会因神经网络近似而退化。因此,它大大提高了性能。

类似地,TD-Gammon使用没有被神经网络近似退化的前瞻最小化在线执行一个策略改进步骤。为此,它使用了一个经过离线神经网络训练的终端位置评估器,重要的是,它还通过rollout扩展了其在线前向(使用基于位置评估器的一步前向播放器进行仿真)。AlphaZero和TD-Gammon的一个重要教训是,离线训练的控制器的性能可以通过在线游戏、长时间的前瞻性(包括最小化或推出离线获得的策略,或两者都有)和离线获得的终端成本近似大大提高。这种性能的提高通常是戏剧性的,这是由于一个简单的事实,这是我们工作的中心:在线游戏相当于求解Bellman方程的牛顿方法的一个步骤,而牛顿步骤的起点是基于离线训练的结果,并可能通过更长的前瞻性和在线推出得到增强。这个过程可以用动态规划的抽象模型和简单的几何结构来理解。它在一定程度上体现在模型预测控制中,但它似乎还没有在决策和控制社区中得到充分的认识。

在这项工作中,我们的目标是提供洞察力(通常基于可视化),解释在线决策对离线训练的有益影响。虽然我们将不再强调数学证明,但有相当多的相关分析,支持我们的结论,可以在作者最近的RL书籍[Ber19a], [Ber20a]中找到。我们的主要目标之一是通过抽象DP的统一原则表明,AlphaZero/TD-Gammon逼近值空间和rollout的思想非常广泛地应用于确定性和随机最优控制问题,包括离散和连续搜索空间。此外,这些思想可以有效地与模型预测控制、自适应控制、分散控制、离散和贝叶斯优化、基于神经网络的值和策略逼近、启发式算法等其他重要方法相结合。

http://web.mit.edu/dimitrib/www/abstractdp_MIT.html

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“A151” 就可以获取《美国工程院院士MIT教授Dimitri《AlphaZero最优模型预测与自适应控制》2022新书,151页pdf》专知下载链接