历史总在当下与未来产生回响。本报告通过审视核能、金融服务等跨行业合规失败案例,揭示AI生态系统的潜在风险,提供定义框架与经验教训,助力AI构建者与使用者在复杂合规环境中稳健前行。

基于对AI关联行业11个案例的研究,识别出三类故障模式:制度性、流程性与性能性。制度性故障源于管理层缺乏建立合规文化、制定必要政策或通过组织结构赋能的承诺,导致可预见性故障;流程性故障表现为机构既定政策与内部执行流程、员工培训间的错位;性能性故障则由员工未遵循既定流程或自动化系统偏离预期功能引发。

跨行业失败案例研究提炼出风险评估、安全协议与监督机制等关键经验,为AI创新者提供指引。最显著风险在于企业往往优先追求创新速度与市场优势,忽视安全考量。案例表明亟需构建透明度机制、强健的第三方验证与评估体系及全面数据治理实践。此外,对AI部署企业的诉讼分析揭示:隐私合规、反歧视与透明度保障必须成为开发流程的根基,而非事后补救。

尽管当前AI监管框架仍呈碎片化,我们识别出五大治理支柱——法律法规、政策指引、行业规范、技术标准与组织内控,为AI安全可信开发指明方向。鉴于美国尚未出台综合性联邦AI立法,我们将AI生态系统的合规失败定义为:未能遵循既有法律、政府指引、全球共识规范、标准、自愿承诺及(公开或内部)组织政策中关于负责任AI治理的要求。

报告最终聚焦AI技术演进与复杂性衍生的独特合规挑战。模糊的安全定义与快速迭代特性加大治理难度,甚至影响受监管行业的AI应用采纳;可解释性不足阻碍合规机制建设,而AI代理技术则模糊自动化世界的责任边界。随着机构面临从轻微违规到跨行业灾难性故障的风险谱系,有效监管的紧迫性持续攀升。缺乏适当防护将侵蚀公众信任,催生"速度优先于安全"的行业惯例——其影响远超出AI领域,波及整体创新生态与社会福祉。历史警示我们:高度复杂系统易发多维度故障。构建日益强大的AI系统时,必须汲取历史教训,避免重蹈覆辙。

随着高度先进的人工智能(AI)系统日益融入医疗、金融、交通与国家安全等社会关键领域,政策制定者及社会各界正密切关注其开发部署的潜在风险。安全与技术研究所(IST)2023年12月发布的尖端AI基础模型风险与机遇报告,识别出六类风险并评估模型开放程度对各风险的影响。后续研究中,IST提出AI风险缓释的"生命周期方法",深入剖析六类风险之一的恶意使用风险,并提出具体技术政策应对策略。

基于此基础,本报告聚焦2023年12月报告识别的另一类风险——合规失败风险(定义为"无力或无意遵守既有安全规程、验证机制与法律要求")。这些必须遵守的要求与规程具体为何?制定主体是谁?答案并不明晰,因全球AI治理框架快速演变且迄今呈现碎片化格局。或许我们可从其他成熟领域汲取经验?

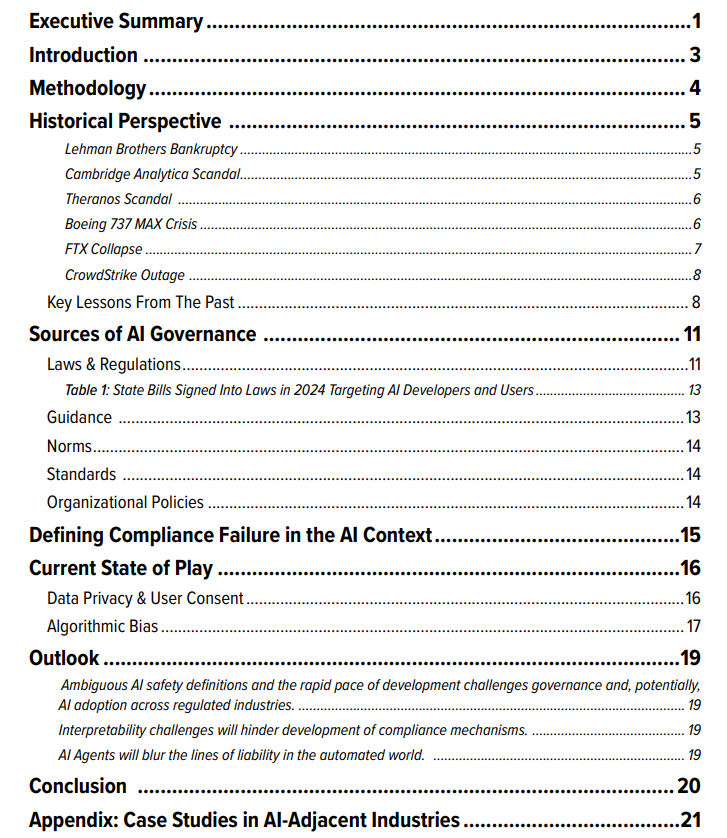

作为系列报告的首篇,本文旨在: » 提供关联行业的合规失败历史背景;

» 定义AI生态系统中的合规失败并阐释其语境;

» 分析AI合规失败趋势现状及AI系统特有的合规挑战;

» 探讨AI生态合规失败的潜在影响。

计划于2025年初发布的第二篇报告将提出可操作风险缓释策略,并建议AI生态多方参与者实施广泛干预措施。

通过本系列报告及配套研讨活动,我们致力于推动AI治理对话,为政策制定者、行业领袖与研究机构提供洞见,助力AI技术优化开发与部署。理解合规失败的历史与当下模式,有助于构建预测模型以预判AI生态风险管理的薄弱环节及其潜在后果。尽管我们谨慎避免做出明确未来预测,但本报告强调:技术迅猛发展与人因决策的复杂交互,要求建立有效AI治理与强健安全框架——这些因素正给任何长期预测带来重大不确定性。