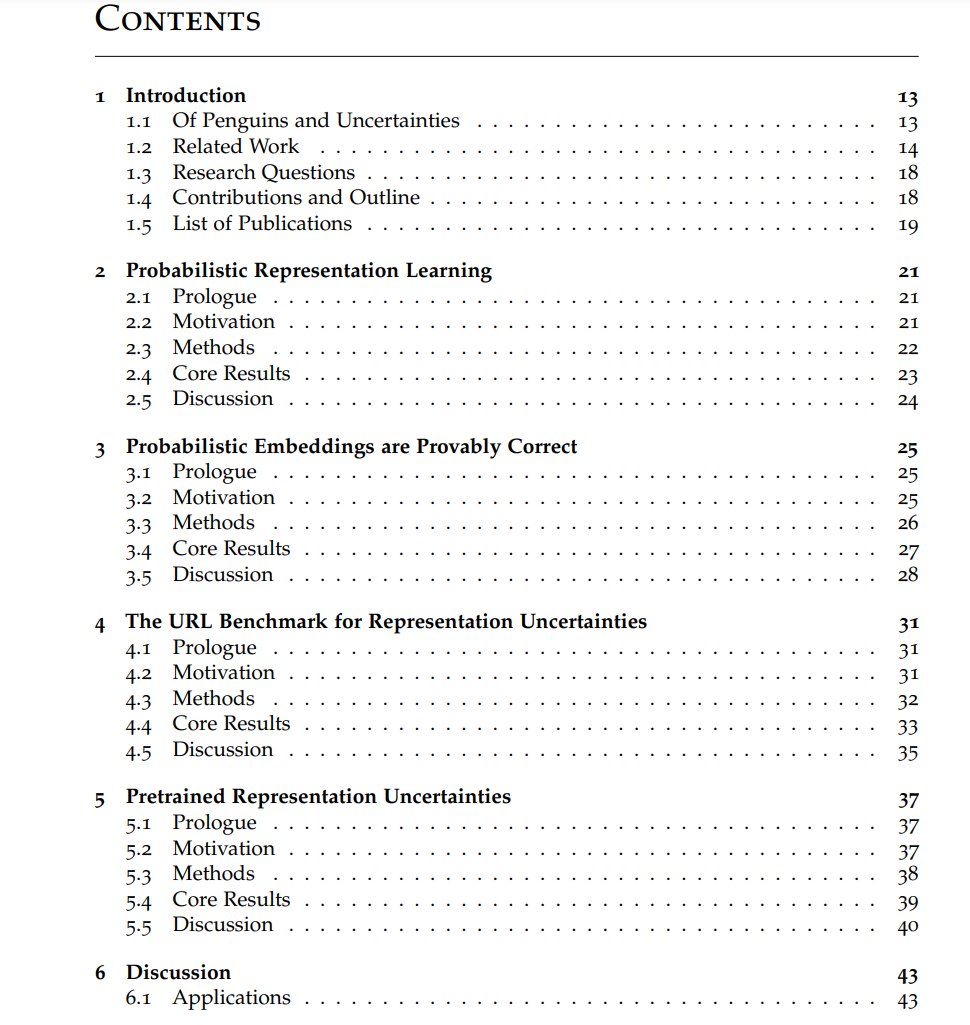

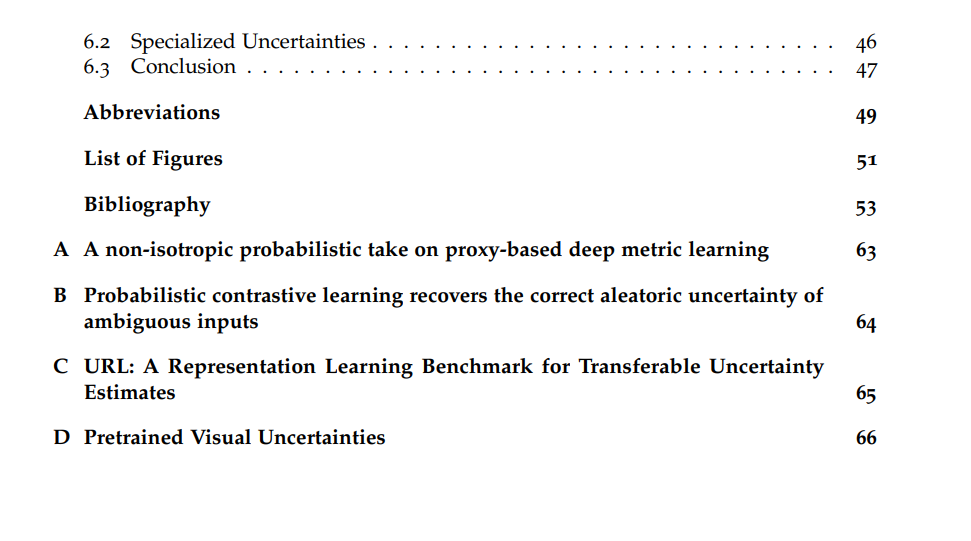

不确定性量化是可信机器学习的重要支柱之一。它能够在输入不安全的情况下做出安全反应,例如仅在机器学习模型检测到足够证据时进行预测,舍弃异常数据,或在可能出现错误时发出警告。这在医疗图像分类或自动驾驶汽车等安全关键领域尤为重要。尽管提出了许多不确定性量化方法,并在性能基准测试中取得了越来越高的分数,但在实际应用中,不确定性估计往往被忽视。许多机器学习项目从预训练的潜在表示开始,而这些表示通常不包含不确定性估计。实践者需要自行训练这些不确定性,这既困难又资源密集。本论文通过将不确定性添加到预训练计算机视觉模型的潜在表示向量中,使不确定性估计变得易于获取。除了提出基于概率论和决策理论的方法,如蒙特卡罗信息对比损失(MCInfoNCE)和损失预测外,我们还探讨了理论和实证问题。我们证明了这些关于不可观察的潜在表示的不确定性确实是可以证明其正确性的。我们还提供了一个不确定性感知表示学习(URL)基准,以将这些不可观察的量与可观察的真实值进行比较。最后,我们将研究成果编译为在大规模计算机视觉模型上预训练的轻量级表示不确定性,这些不确定性可以以零样本的方式转移到未见过的数据集上。我们的研究成果不仅推进了当前对潜在变量不确定性理论的理解,还为未来领域内外的研究人员提供了不确定性量化的便利。作为可下载的起点,我们的预训练表示不确定性使得一系列新颖的实际任务得以实现,从而促进了简单但可信的机器学习的开展。

成为VIP会员查看完整内容

相关内容

Arxiv

224+阅读 · 2023年4月7日