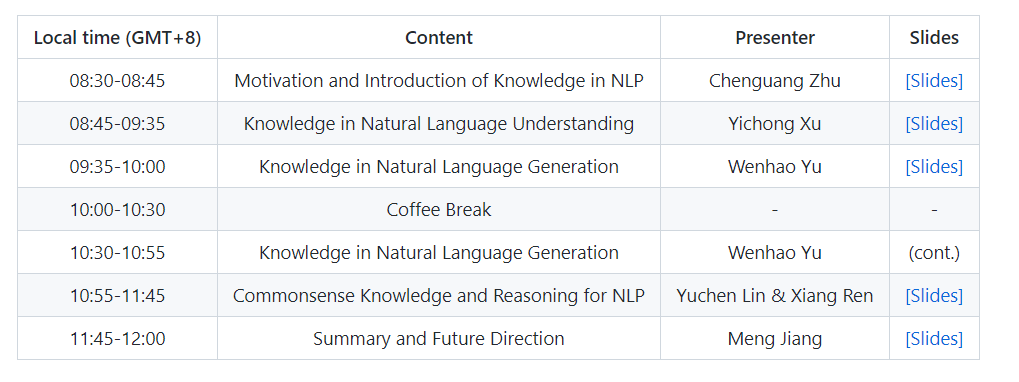

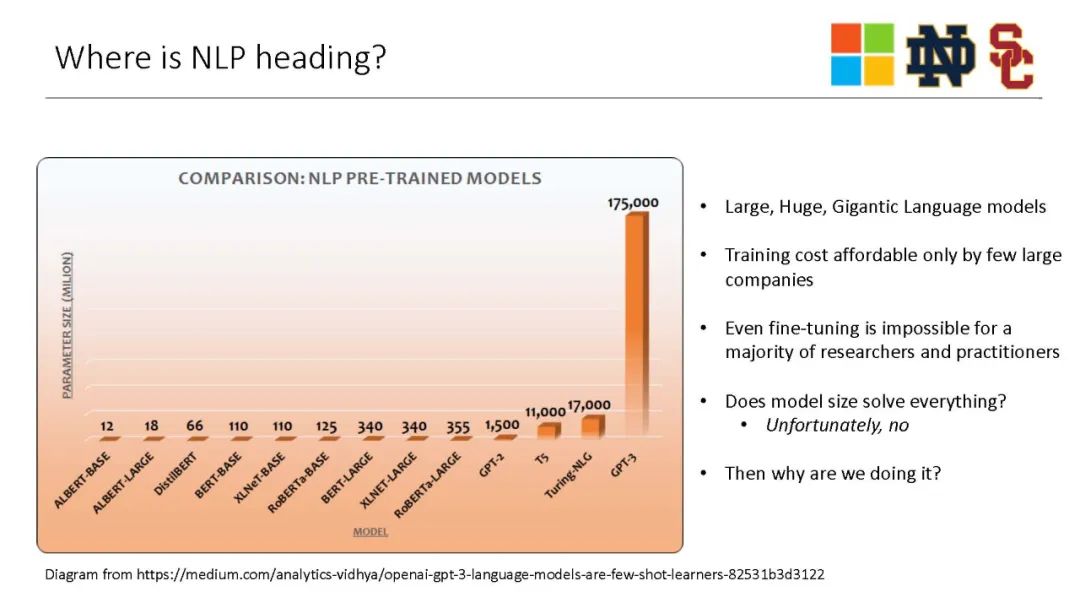

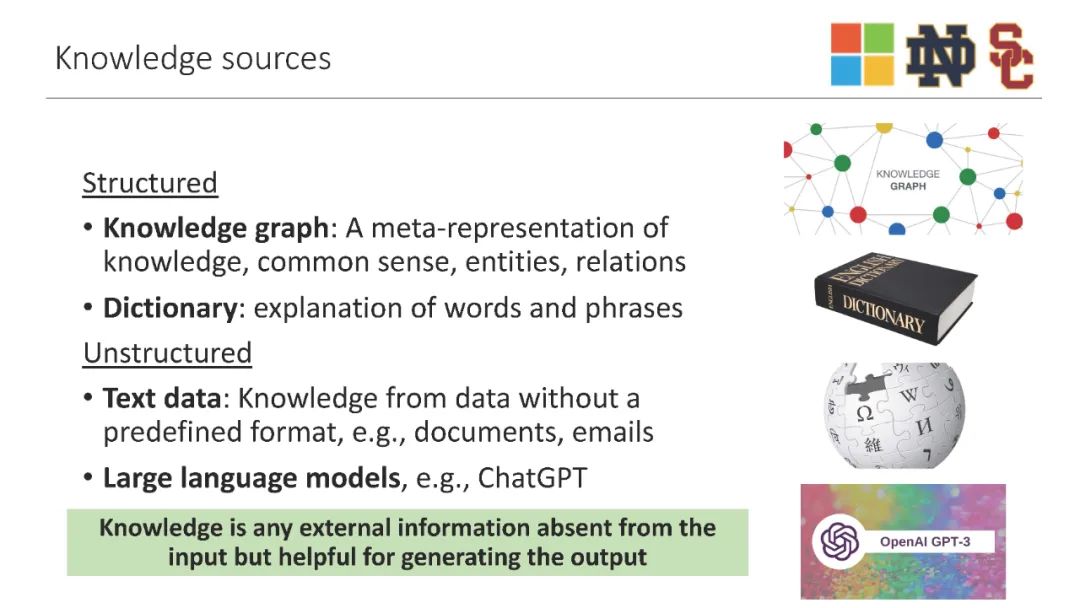

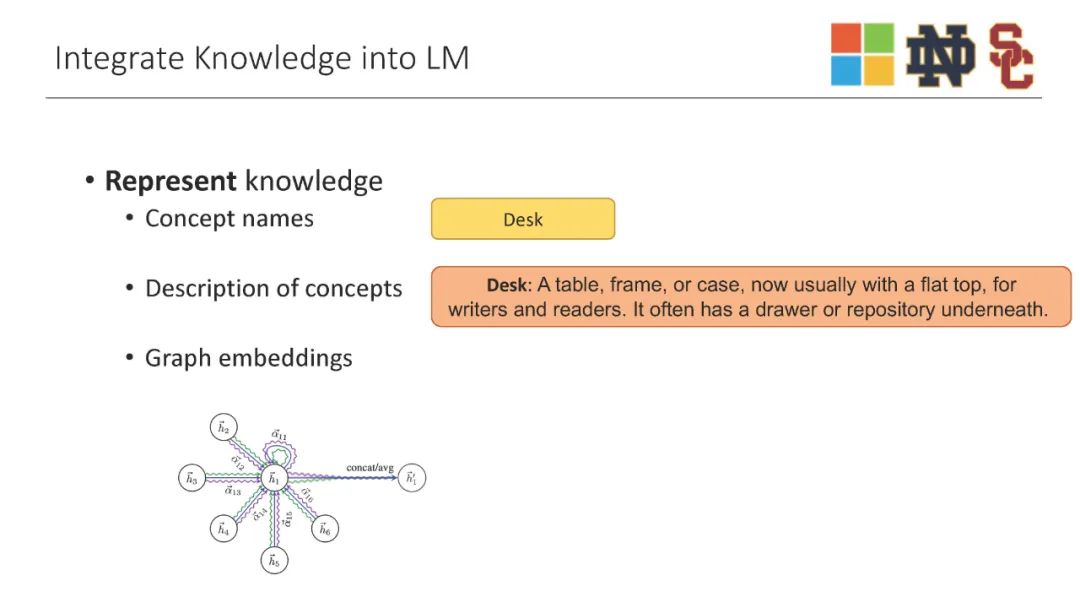

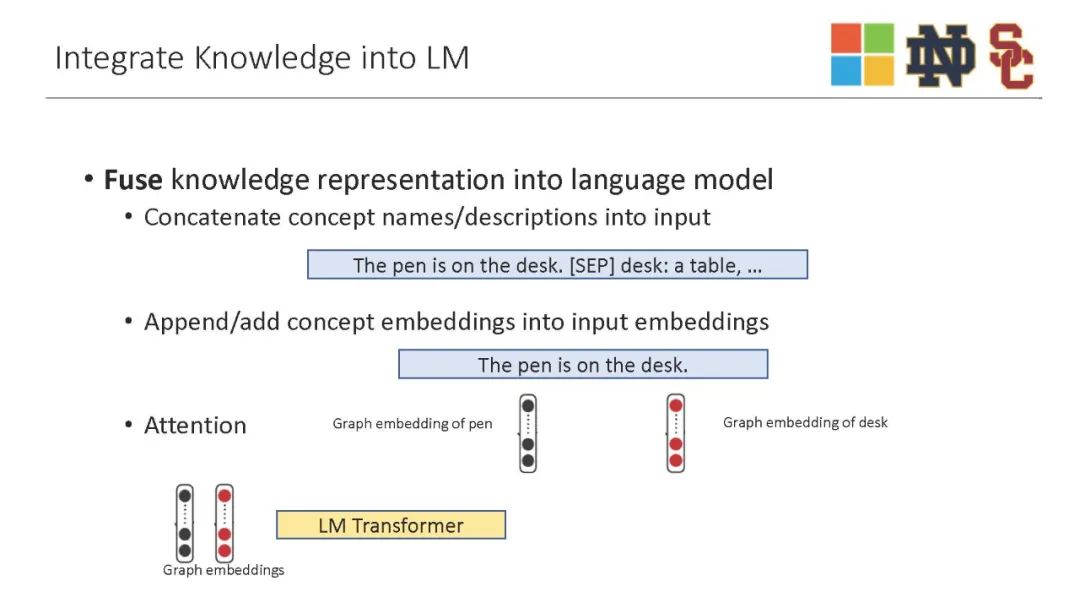

特别是在大规模预训练模型出现后,NLP中的知识一直呈上升趋势。注意力知识的NLP模型可以i)访问无限数量的外部信息;Ii)将参数空间中的知识存储任务委托给知识源;Iii)获取最新信息;Iv)通过选择知识,使预测结果更具可解释性。在本教程中,我们将介绍将知识集成到NLP中的关键步骤,包括来自文本的知识基础,知识表示和融合。本文还将介绍最近在将知识融合到语言理解、语言生成和常识推理方面的最先进应用。

https://github.com/zcgzcgzcg1/WSDM2023_Knowledge_NLP_Tutorial

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2023年4月17日

Arxiv

0+阅读 · 2023年4月14日