题目: Neural Abstractive Summarization with Structural Attention

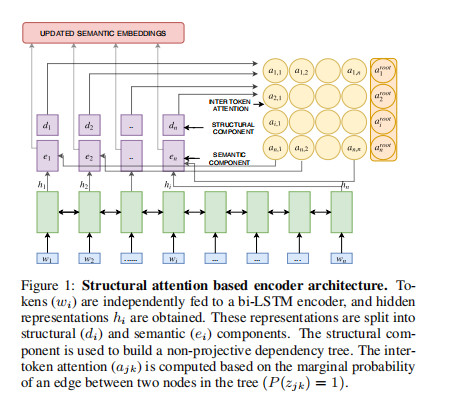

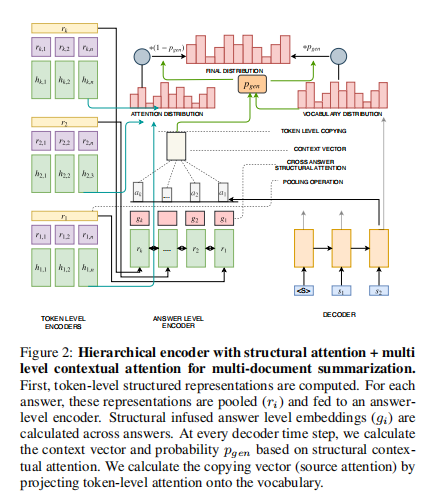

简介: 基于RNN的注意力编码器-解码器体系结构在新闻文章的抽象摘要方面实现了令人印象深刻的性能。但是,这些方法无法解决文档句子中的长期依赖性。在多文档摘要任务中,例如在诸如Yahoo等社区问题解答(CQA)网站中出现的主题中总结流行观点时,此问题会更加严重。这些线索包含的答案通常相互重叠或矛盾。在这项工作中,我们提出了一种基于结构注意力的分层编码器,以对诸如句子间和文档间的依存关系进行建模。我们将流行的指针生成器体系结构和从中衍生的某些体系结构设置为基线,并表明它们无法在多文档设置中生成良好的摘要。我们进一步说明,我们提出的模型在单文档和多文档摘要设置中均比基线有了显着改进–在以前的设置中,它在CNN和CQA数据集上分别比最佳基线低1.31和7.8 ROUGE-1点;在后一种设置中,CQA数据集的性能进一步提高了1.6 ROUGE-1点

成为VIP会员查看完整内容

相关内容

专知会员服务

95+阅读 · 2019年11月8日

Arxiv

17+阅读 · 2020年6月2日

Arxiv

3+阅读 · 2019年7月8日