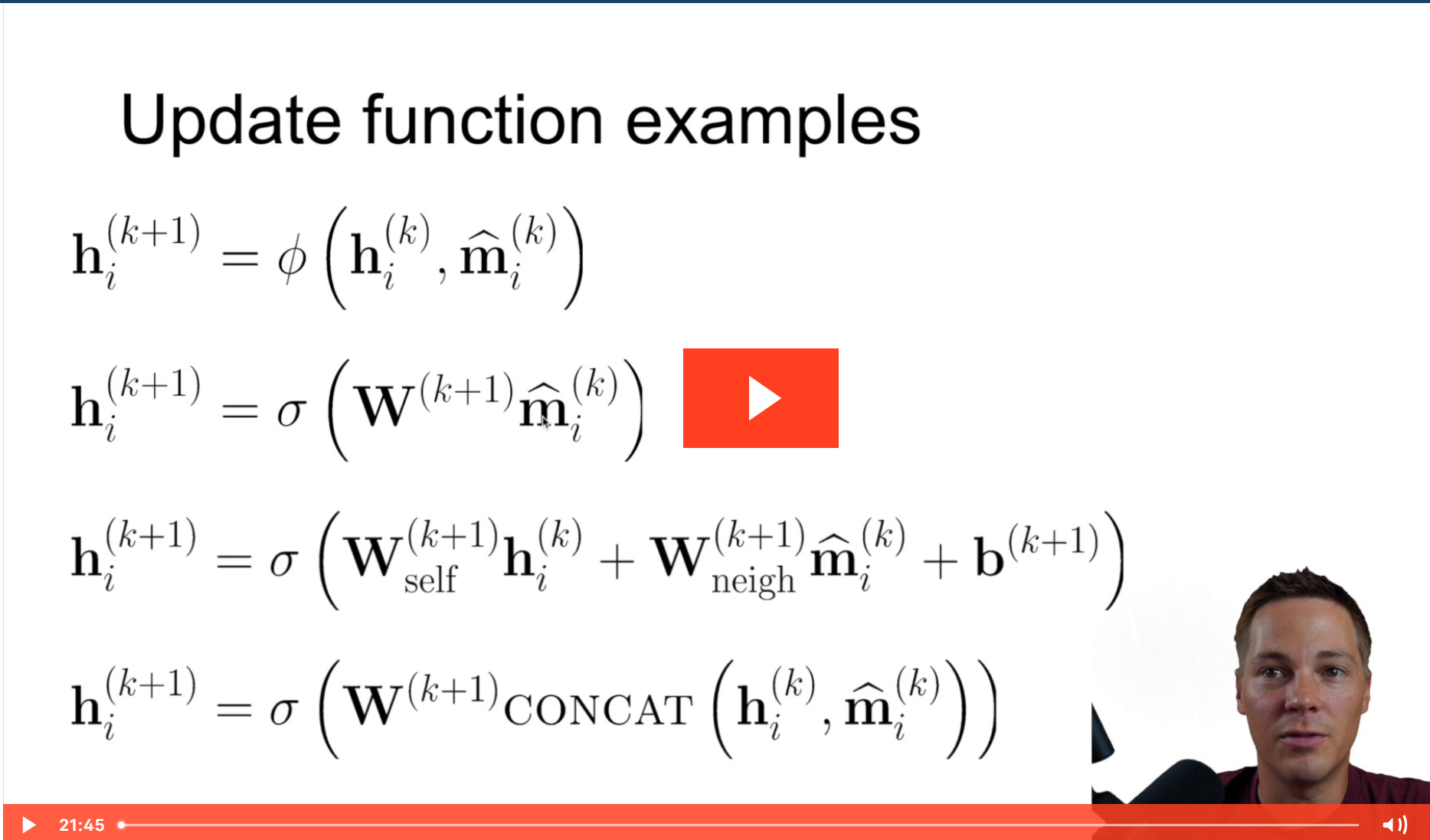

以常见的消息传播网络(Message Passing Neural Network, MPNN)为例, 其核心思想是迭代更新节点的嵌入向量(embedding vector)。更新的方式是,首先每个节点会收到来自于它邻居节点传来的消息(message),再对所收到的信息做聚合(aggregation),以此来更新自身的嵌入向量。神经网络既参与第一步生成消息的过程,又参与之后更新节点的嵌入向量的过程。当使用不同的神经网络模型作为消息生成函数和节点更新函数时,便可得到不同种类的MPNN模型。

https://www.graphneuralnets.com/courses/foundational-theory-of-gnns/lectures/36125373

成为VIP会员查看完整内容