深度学习已经成为自然语言处理领域的主流技术。然而,这些技术需要许多标记数据,而且跨领域的通用性较差。元学习是机器学习中的一个新兴领域,研究如何学习出更好的学习算法。方法旨在提高算法的各个方面,包括数据效率和通用性。方法的有效性已经在许多自然语言处理任务中得到了证明,但目前对这些方法在自然语言处理中的应用还没有系统的综述,这阻碍了更多的研究者进入该领域。本文的目的是为研究人员提供相关的NLP元学习工作的指针,并吸引更多的关注,以推动未来的创新。本文首先介绍了元学习的一般概念和常用方法。在此基础上,总结了任务构建设置和元学习在各种自然语言处理问题中的应用,并回顾了元学习在自然语言处理社区中的发展。

引言

近年来,基于深度学习(DL)的自然语言处理(NLP)已成为研究的主流之一,在许多自然语言处理问题上取得了显著的性能改善。然而,DL模型需要大量数据。缺点限制了这些模型在不同领域、语言、国家或风格中的应用,因为为模型训练收集不同类型的数据是昂贵的。为了应对这些挑战,元学习技术正受到关注。元学习,或学会学习,旨在学习更好的学习算法,包括更好的参数初始化(Finn et al., 2017),优化策略(Andrychowicz et al., 2016; Ravi and Larochelle, 2017),网络架构(Zoph and Le, 2017; Zoph et al., 2018; Pham et al., 2018a),距离度量(Vinyals et al., 2016; Gao et al., 2019a; Sung et al., 2018),以及其他(Mishra et al,2018年)。元学习允许更快的微调,收敛到更好的性能,产生更通用的模型,它在少样本图像分类方面取得了出色的结果(Triantafillou et al,2020)。这些优点减轻了学习算法对标签的依赖,并使模型开发更具可扩展性。

图像处理是具有丰富应用的机器学习领域之一,并且在之前关于元学习的综述论文中建立了大多数例子(Hospedales et al., 2021; Huisman et al., 2021)。另一方面,通过将元学习应用于自然语言处理问题,已有研究显示了元学习技术在性能和数据效率方面的优势。请参阅附录中的表3和表4,了解通过元学习改进的自然语言处理应用。ACL2021年会组织教程(Lee et al., 2021b)和研讨会(Lee et al., 2021a),以鼓励对这些技术感兴趣的NLP研究人员之间的交流和合作。在NLP中有一篇关于元学习的综述论文(Yin, 2020)。虽然Yin(2020)对元学习方法进行了概述,但本文侧重于将元学习成功应用于自然语言处理,并对有关自然语言处理元学习的论文进行了更广泛的综述。由于篇幅的限制,在这篇调查论文中,我们将不会对一般的元学习技术进行过多的详细描述。关于元学习的一般概念,我们鼓励读者阅读之前的综述论文(Yin, 2020; Hospedales et al., 2021; Huisman et al., 2021)。

为了让更多的NLP研究者和实践者受益于元学习的发展并参与到这一领域,本文对元学习在NLP问题中的应用进行了系统的综述。综述论文的组织方式如下。

- 第2节简要介绍元学习背景、一般概念和算法。

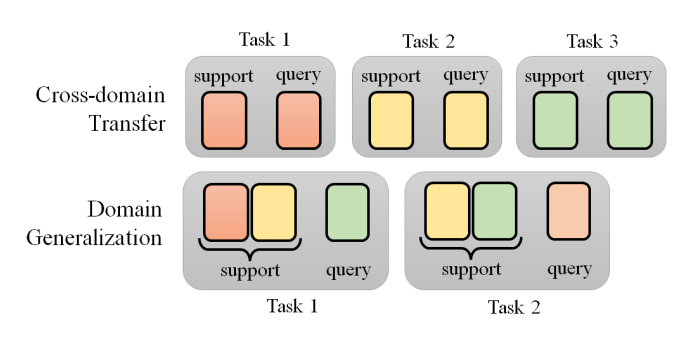

- 第3节中构建元学习任务的常见设置。

- 第4节中一般元学习方法对NLP问题的适应性。

- 特殊主题的元学习方法,包括第五节NLP应用的知识提炼和终身学习。

- 本综述报告旨在为研究人员提供参考,帮助他们理解在自然语言处理领域的元学习技术,并激发更多的创新

元学习知识